feat: 更新鱼皮的 AI指南 + 行业资讯

This commit is contained in:

@@ -24,8 +24,13 @@ function generateContent(directory, dirName) {

|

||||

let content = `# ${dirName}\n\n`;

|

||||

content += `> 你全面的 AI 知识库,一网打尽最新 AI 资讯,都在 [https://ai.codefather.cn](https://ai.codefather.cn)\n\n`;

|

||||

|

||||

// 获取所有一级子目录

|

||||

const subDirs = getSubDirectories(directory);

|

||||

// 获取所有一级子目录并按创建时间排序,最新的放在前面

|

||||

const subDirs = getSubDirectories(directory).sort((a, b) => {

|

||||

const statA = fs.statSync(a);

|

||||

const statB = fs.statSync(b);

|

||||

return statB.birthtime.getTime() - statA.birthtime.getTime();

|

||||

});

|

||||

|

||||

if (subDirs.length > 0) {

|

||||

// 循环处理每个一级子目录

|

||||

for (const subDir of subDirs) {

|

||||

|

||||

@@ -59,7 +59,22 @@ function generateSidebarConfig(dirPath) {

|

||||

});

|

||||

}

|

||||

if (directories.length > 0) {

|

||||

directories.forEach((dir) => {

|

||||

// 创建包含目录信息和创建时间的对象数组

|

||||

const dirInfos = directories.map((dir) => {

|

||||

const subDirectoryPath = path.join(currentPath, dir.name);

|

||||

const stats = fs.statSync(subDirectoryPath);

|

||||

return {

|

||||

dir: dir,

|

||||

birthtime: stats.birthtime,

|

||||

};

|

||||

});

|

||||

|

||||

// 按创建时间降序排序,最新的目录排在前面

|

||||

dirInfos.sort((a, b) => b.birthtime.getTime() - a.birthtime.getTime());

|

||||

|

||||

// 处理排序后的目录

|

||||

dirInfos.forEach((dirInfo) => {

|

||||

const dir = dirInfo.dir;

|

||||

const subDirectoryPath = path.join(currentPath, dir.name);

|

||||

const newRelativePath = relativePath ? `${relativePath}/${dir.name}` : dir.name;

|

||||

|

||||

|

||||

+174

-132

@@ -1,6 +1,17 @@

|

||||

|

||||

export default [

|

||||

"",

|

||||

{

|

||||

"title": "鱼皮的 AI 指南",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"鱼皮的 AI 指南/鱼皮的 AI 指南 - 0、开篇",

|

||||

"鱼皮的 AI 指南/鱼皮的 AI 指南 - 1、AI 核心概念",

|

||||

"鱼皮的 AI 指南/鱼皮的 AI 指南 - 2、AI 实用工具",

|

||||

"鱼皮的 AI 指南/鱼皮的 AI 指南 - 3、AI 编程技巧",

|

||||

"鱼皮的 AI 指南/鱼皮的 AI 指南 - 4、AI 编程技术"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "AI项目教程",

|

||||

"collapsable": true,

|

||||

@@ -12,128 +23,12 @@ export default [

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek使用指南",

|

||||

"title": "关于DeepSeek",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek使用指南/🔥DeepSeek 小白快速上手指南",

|

||||

"DeepSeek使用指南/几个技巧,教你去除文章的 AI 味!",

|

||||

"DeepSeek使用指南/DeepSeek 发布新模型 V3-0324,附使用教程",

|

||||

"DeepSeek使用指南/最新清华大学DeepSeek使用手册第1-5版,官方完整版PDF免费下载",

|

||||

"DeepSeek使用指南/2分钟学会 DeepSeek API,竟然比官方更好用!",

|

||||

"DeepSeek使用指南/完整攻略:如何用好DeepSeek,一文汇总!",

|

||||

"DeepSeek使用指南/【汇总】满血版 DeepSeek 第三方使用渠道",

|

||||

"DeepSeek使用指南/DeepSeek 本地部署教程",

|

||||

"DeepSeek使用指南/如何在iPhone上用语音调用Deepseek",

|

||||

"DeepSeek使用指南/普通人能用DeepSeek做什么?20个实用建议",

|

||||

{

|

||||

"title": "DeepSeek 提问技巧",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/50个常用的DeepSeek模仿风格提示词,去AI味的大杀器",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/我发现了 DeepSeek 去 AI 味的捷径,太香了",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/DeepSeek 提示词基本法则",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/DeepSeek不好用?那是你还不知道这些指令!",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/吐血整理!DeepSeek神级指令,好用到爆!",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/普通人也能轻松掌握的 20 个 DeepSeek 高频提示词(2025版)"

|

||||

]

|

||||

}

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek应用场景",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

{

|

||||

"title": "DeepSeek + 内容创作",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/3秒让DeepSeek写出爆款小红书",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/人有多大胆,地有多大产:如何用DeepSeek写长篇小说",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/如何利用DeepSeek进行高效内容创作",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/用DeepSeek做小红书真的太牛了!轻轻松松打造爆款笔记",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/用DeepSeek写文章?这4个骚操作让你躺平也能出爆款!(含提示词)",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/DeepSeek使用指南:提升公文、新闻与广告文案写作效率的三大技巧 ",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/AI写小说怎么写?deepseek帮你写小说教程"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 创意设计",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/和 Deepseek 联手,做个哪吒的乾坤圈视频",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/5 个不得不收藏的 Deepseek 王炸组合!",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/DeepSeek一句话搞定修图难题",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/deepseek+数字人王炸组合使用方法",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/用 deepseek 做 AI 视频,绝了,和抄作业一样简单!",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/绝绝子!用deepseek做AI视频,涨粉10W+(附保姆级教程)",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/这怕是全网最强的 DeepSeek 图片教程吧,赶紧收藏了!"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 办公效率",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/如何用DeepSeek更高效地工作:10个实用技巧",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/手把手教你在word中接入deepseek,秒生文档材料",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/法律人保姆级deepseek使用指南(附指令版)",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek R1 + 个人知识库,直接起飞!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek嵌入到Excel,提升10倍工作效率,太牛了!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek配合KIMI,自动生成PPT,感觉自己要失业了!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/WPS里装上deepseek,简直就是办公神器",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/利用deepseek建立专属销售知识库",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/教师必备DeepSeek使用指南来了!5大教学应用场景+实操案例+隐藏用法"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 理财",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 理财/DeepSeek告诉我:30岁到40岁,一般会拥有这么多的存款",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/用DeepSeek搞钱,日赚百万",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/普通人如何通过炒股买基金赚到100万?",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/用Deepseek回答:如果有100万闲钱,几年内不用,该怎么理财?"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 编程开发",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/3 小时做游戏,10 天狂赚 28 万!程序员用 AI 躺赚?",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/💗用 DeepSeek 给对象做个网站,她一定感动坏了",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/DeepSeek装进VSCode,编程非常丝滑!",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/教你用DeepSeek+Clien,从0到1开发一个APP",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/DeepSeek接入Python,一般电脑也能飞速跑,确实可以封神了!"

|

||||

]

|

||||

}

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek技术解析",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

{

|

||||

"title": "DeepSeek 技术分析",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek最强专业拆解:清交复教授超硬核解读",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek的优势与不足",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/一文详解 DeepSeek 技术架构",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek vs. ChatGPT:谁才是真正的王者?",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek 爆火逻辑、行业影响及对未来AI发展的启示",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek-R1 技术全景解析:从原理到实践的“炼金术配方”",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek技术解读:从V3到R1的MoE架构创新"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek 模型训练",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-R1的四个训练阶段",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-R1的训练流程强化学习(RL)阶段采用了GRPO算法",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-V3 高效训练关键技术分析",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek华丽文风从何而来?业内人士:训练数据、训练策略和迭代优化缺一不可"

|

||||

]

|

||||

}

|

||||

"关于DeepSeek/DeepSeek 创始团队介绍",

|

||||

"关于DeepSeek/DeepSeek 发展历程",

|

||||

"关于DeepSeek/什么是 DeepSeek"

|

||||

]

|

||||

},

|

||||

{

|

||||

@@ -150,6 +45,49 @@ export default [

|

||||

"title": "Deepseek行业资讯",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

{

|

||||

"title": "2025-04",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"Deepseek行业资讯/2025-04/阿里秘密研发新模型将发布,影响力指标成最重要考核",

|

||||

"Deepseek行业资讯/2025-04/有史以来最大力度!苹果进军医疗,计划明年推出AI医生 - 华尔街见闻",

|

||||

"Deepseek行业资讯/2025-04/一张照片生成连贯全片!Runway Gen-4 深夜发布,终于捅破 AI 视频多年的天花板",

|

||||

"Deepseek行业资讯/2025-04/智谱发布 AutoGLM 沉思:首个免费、具备深度研究和操作能力的 AI Agent",

|

||||

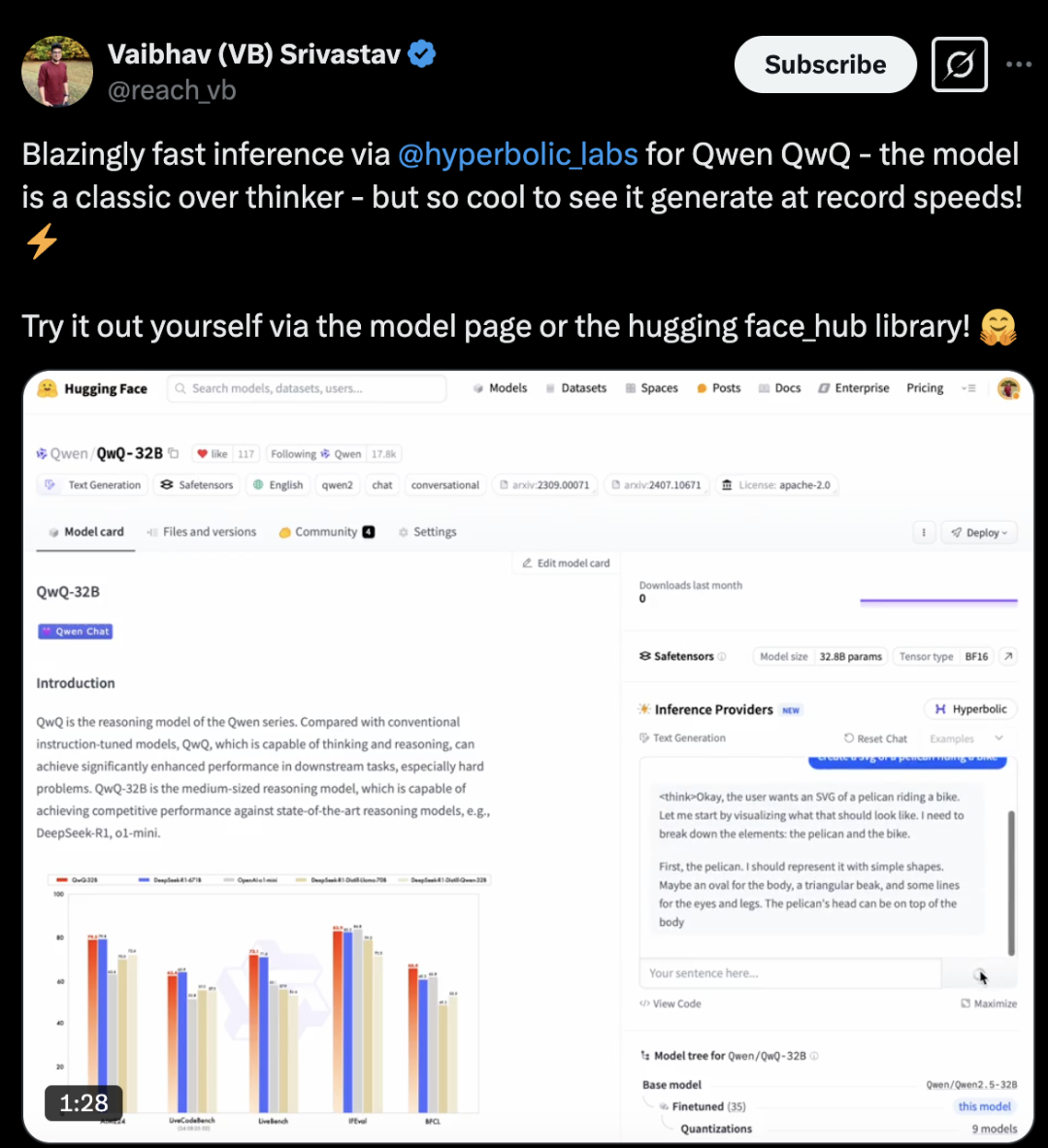

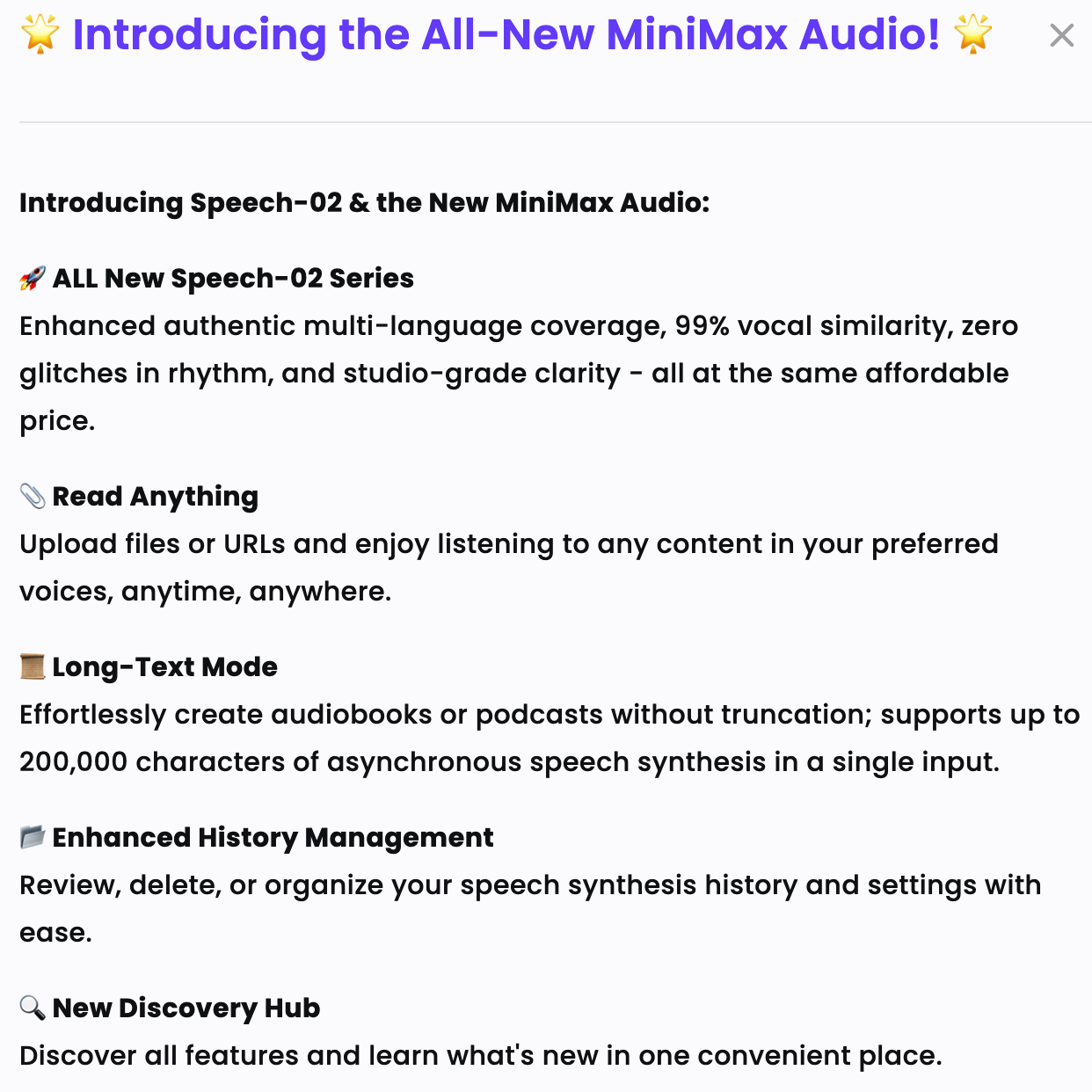

"Deepseek行业资讯/2025-04/MiniMax Audio 发布 Speech-02 模型,单次输入支持 20 万字符",

|

||||

"Deepseek行业资讯/2025-04/亚马逊推出 Nova Act:可操控网页浏览器的 AI 智能体",

|

||||

"Deepseek行业资讯/2025-04/腾讯元宝识图放大招!一次传 10 张图,朋友圈文案、电子书金句全搞定!",

|

||||

"Deepseek行业资讯/2025-04/售价超 7000 元,Meta 想用眼镜取代 iPhone",

|

||||

"Deepseek行业资讯/2025-04/百度飞桨框架 3.0 正式版发布",

|

||||

"Deepseek行业资讯/2025-04/OpenAI 上线“OpenAI 学院”,已提供数十小时免费 AI 学习资源",

|

||||

"Deepseek行业资讯/2025-04/xAI 再更新,各项能力卓越"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "2025-03",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

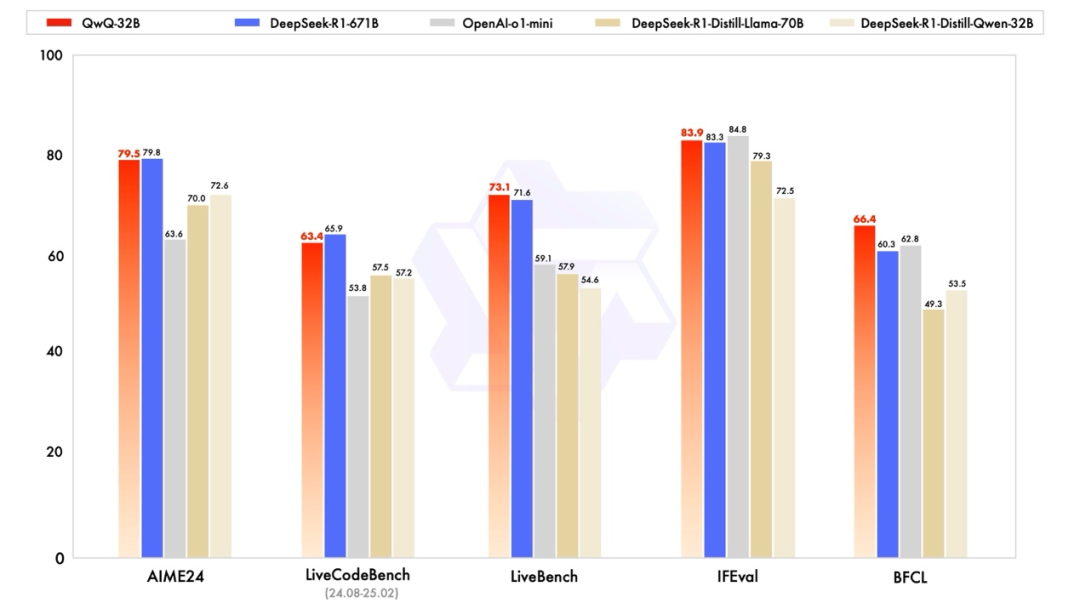

"Deepseek行业资讯/2025-03/阿里开源全新推理模型 QwQ-32B,一台 Mac 就能实现顶级推理能力",

|

||||

"Deepseek行业资讯/2025-03/实测 Manus:首个真干活 AI,中国造(附 50 个用例 + 拆解)",

|

||||

"Deepseek行业资讯/2025-03/用于临床工作流程的新 AI 助手,微软推出 Microsoft Dragon Copilot",

|

||||

"Deepseek行业资讯/2025-03/Model Context Protocol,看这一篇就够了",

|

||||

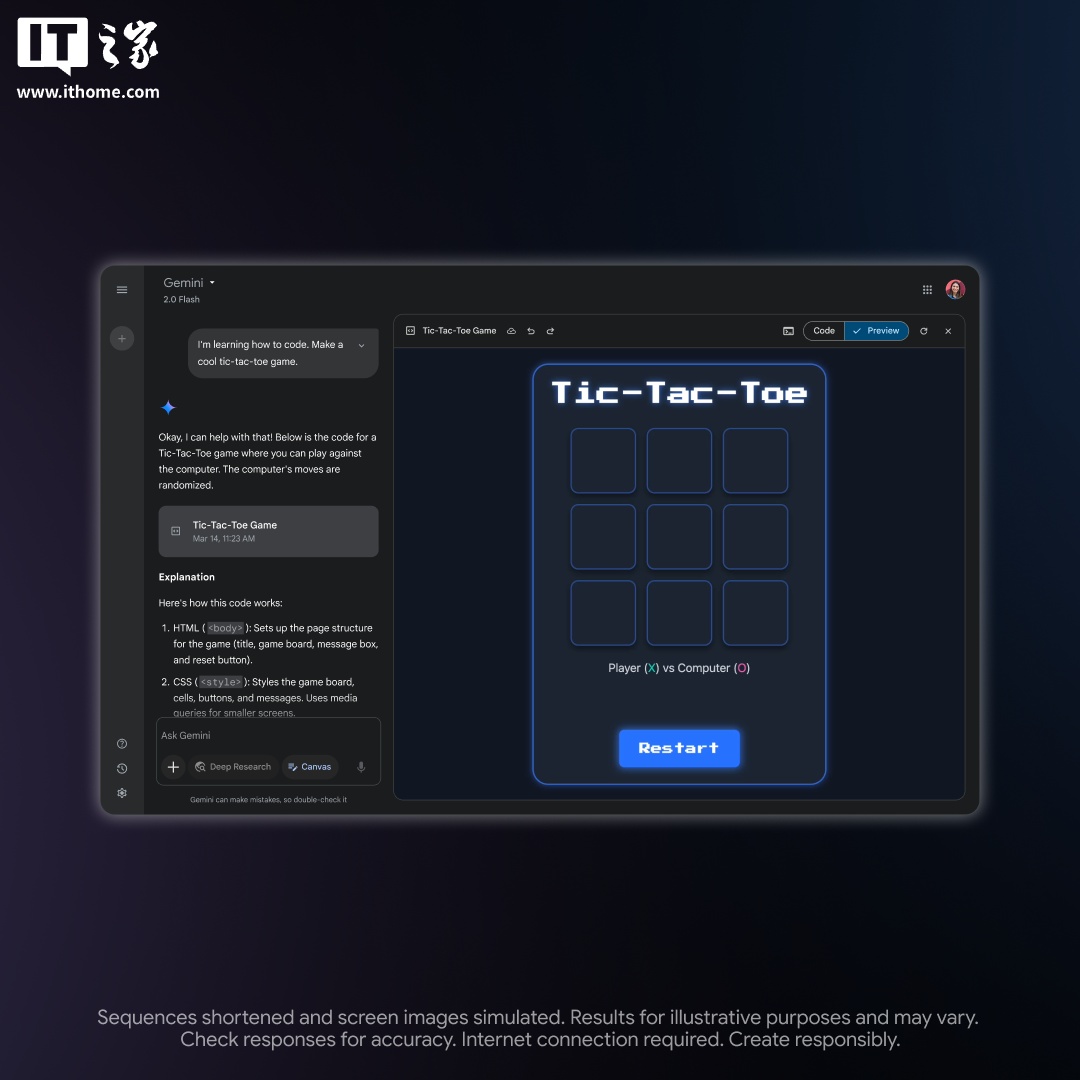

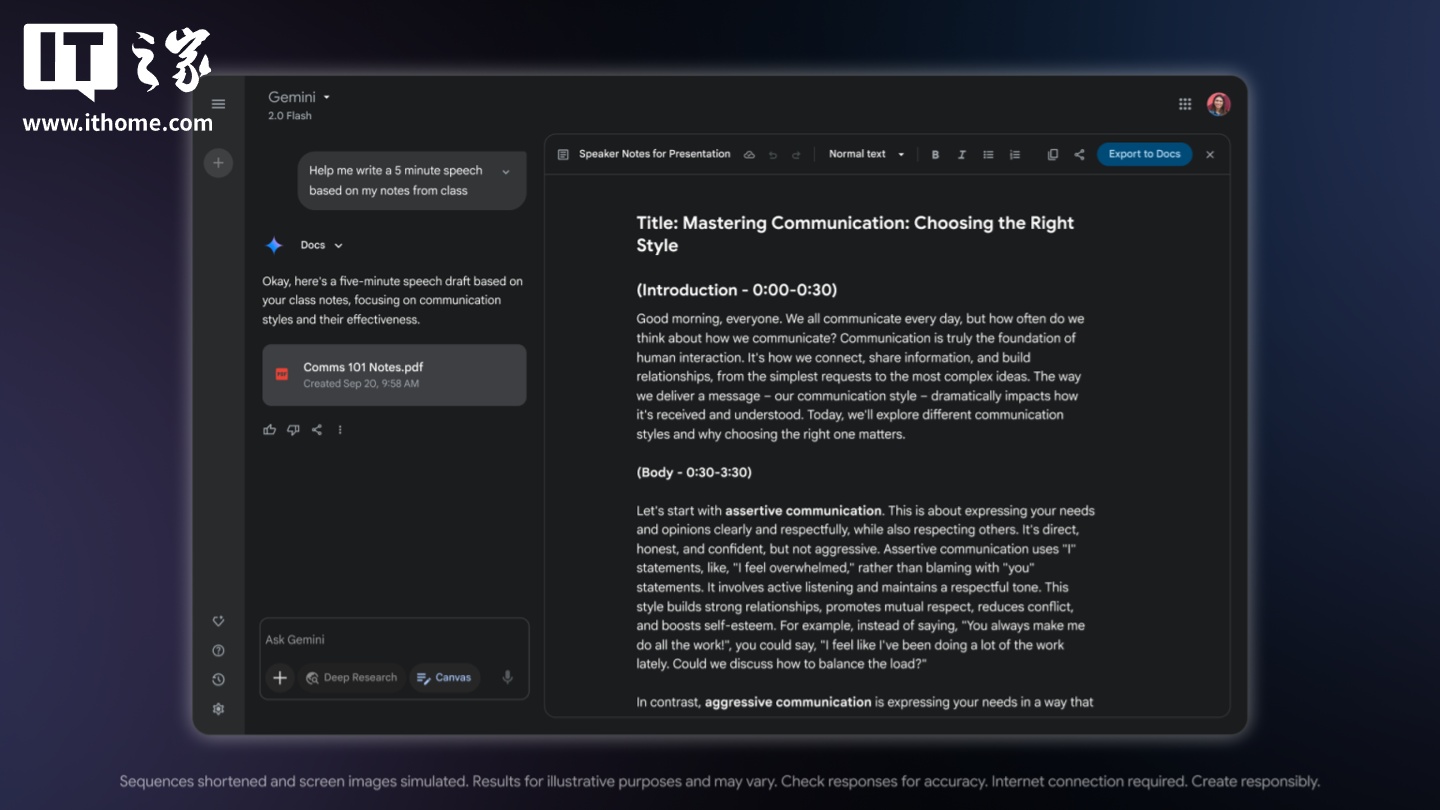

"Deepseek行业资讯/2025-03/谷歌 Gemini 新增 Canvas 与音频概览功能,提升用户生产力",

|

||||

"Deepseek行业资讯/2025-03/马斯克进军 AI 视频,收购视频生成初创公司,4 人 13 个月打造类 Sora 模型",

|

||||

"Deepseek行业资讯/2025-03/百度推出两款 AI 大模型",

|

||||

"Deepseek行业资讯/2025-03/Claude 现已支持网络搜索功能",

|

||||

"Deepseek行业资讯/2025-03/DeepSeek-V3 模型更新,各项能力全面进阶",

|

||||

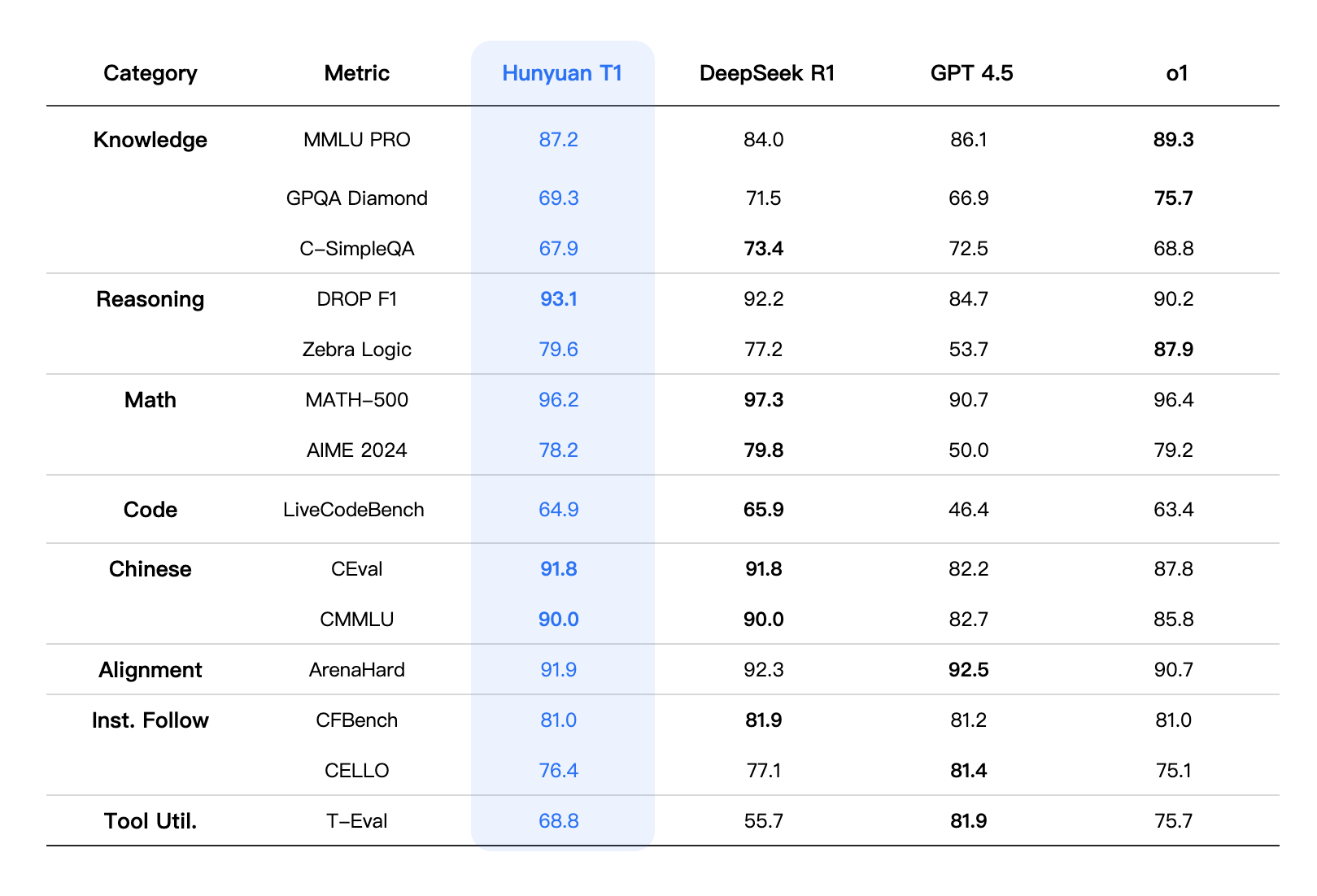

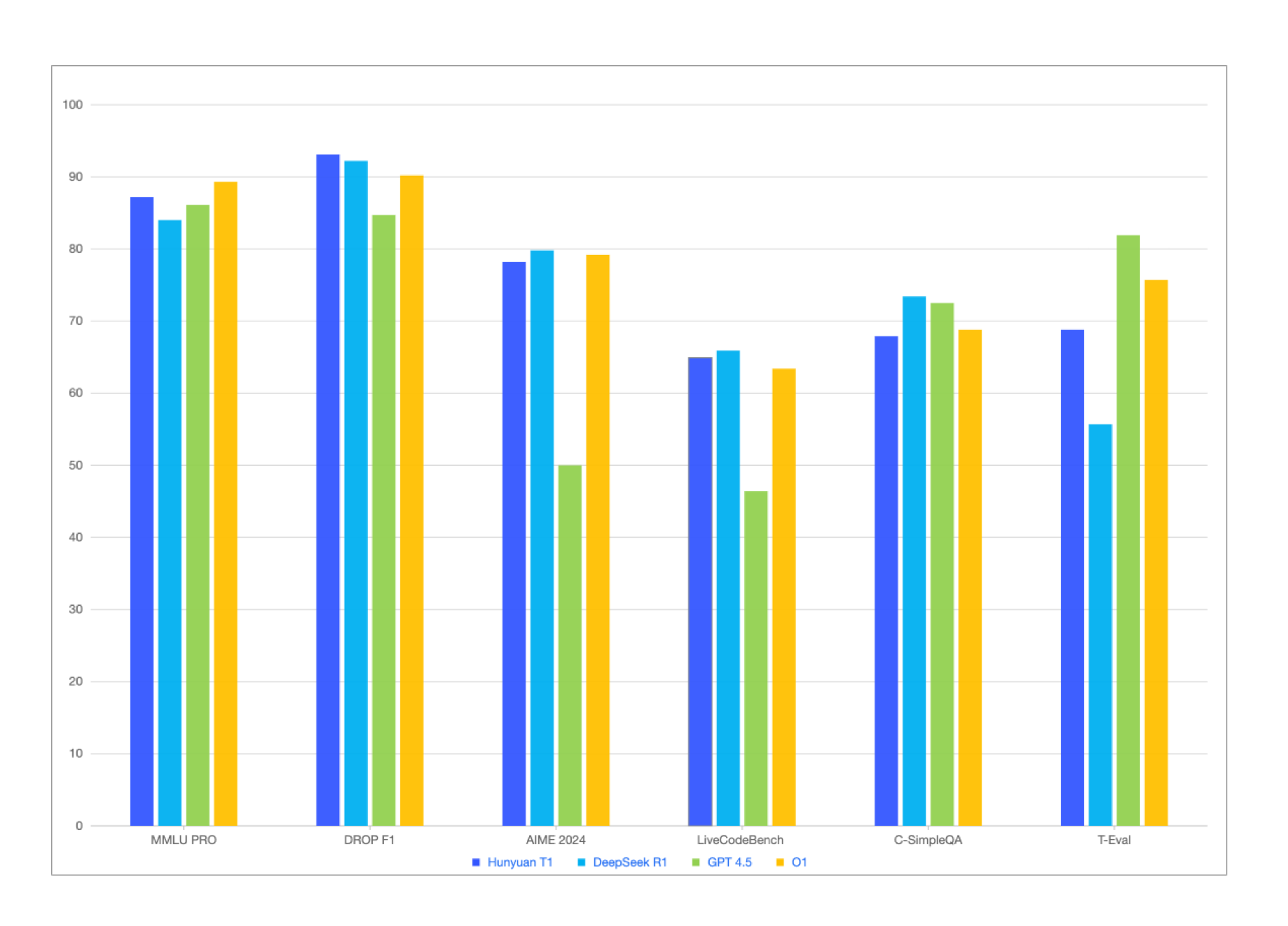

"Deepseek行业资讯/2025-03/腾讯混元 T1 正式版发布",

|

||||

"Deepseek行业资讯/2025-03/Ideogram 正式发布 3.0 版本模型:真实感与创意表现再突破",

|

||||

"Deepseek行业资讯/2025-03/新推理模型来了!阿里 Qwen Chat 平台已上线“深度思考”功能,支持联网搜索",

|

||||

"Deepseek行业资讯/2025-03/刚刚,GPT-4o 原生图像生成上线,P 图、生图也就一嘴的事",

|

||||

"Deepseek行业资讯/2025-03/谷歌发布 Gemini 2.5 人工智能模型,实现复杂思维",

|

||||

"Deepseek行业资讯/2025-03/谷歌终于登顶一次了!最强推理模型Gemini 2.5 Pro实测体验,真的有点东西",

|

||||

"Deepseek行业资讯/2025-03/DeepSeek回答现在能不能入手黄金 将维持高位震荡",

|

||||

"Deepseek行业资讯/2025-03/DeepSeek官方辟谣:R2发布为假消息",

|

||||

"Deepseek行业资讯/2025-03/高校,为何最快拥抱DeepSeek?",

|

||||

"Deepseek行业资讯/2025-03/跨境电商试练AI,DeepSeek取代了ChatGPT",

|

||||

"Deepseek行业资讯/2025-03/不装了!OpenAI力促特朗普对中国AI下死手,出台“AI出口管制”"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "2025-02",

|

||||

"collapsable": true,

|

||||

@@ -183,28 +121,132 @@ export default [

|

||||

"Deepseek行业资讯/2025-02/DeepSeek宣布涨价!",

|

||||

"Deepseek行业资讯/2025-02/DeepSeek带飞科大讯飞?"

|

||||

]

|

||||

},

|

||||

}

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek技术解析",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

{

|

||||

"title": "2025-03",

|

||||

"title": "DeepSeek 模型训练",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"Deepseek行业资讯/2025-03/谷歌终于登顶一次了!最强推理模型Gemini 2.5 Pro实测体验,真的有点东西",

|

||||

"Deepseek行业资讯/2025-03/DeepSeek回答现在能不能入手黄金 将维持高位震荡",

|

||||

"Deepseek行业资讯/2025-03/DeepSeek官方辟谣:R2发布为假消息",

|

||||

"Deepseek行业资讯/2025-03/高校,为何最快拥抱DeepSeek?",

|

||||

"Deepseek行业资讯/2025-03/跨境电商试练AI,DeepSeek取代了ChatGPT",

|

||||

"Deepseek行业资讯/2025-03/不装了!OpenAI力促特朗普对中国AI下死手,出台“AI出口管制”"

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-R1的四个训练阶段",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-R1的训练流程强化学习(RL)阶段采用了GRPO算法",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek-V3 高效训练关键技术分析",

|

||||

"DeepSeek技术解析/DeepSeek 模型训练/DeepSeek华丽文风从何而来?业内人士:训练数据、训练策略和迭代优化缺一不可"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek 技术分析",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek最强专业拆解:清交复教授超硬核解读",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek的优势与不足",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/一文详解 DeepSeek 技术架构",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek vs. ChatGPT:谁才是真正的王者?",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek 爆火逻辑、行业影响及对未来AI发展的启示",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek-R1 技术全景解析:从原理到实践的“炼金术配方”",

|

||||

"DeepSeek技术解析/DeepSeek 技术分析/DeepSeek技术解读:从V3到R1的MoE架构创新"

|

||||

]

|

||||

}

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "关于DeepSeek",

|

||||

"title": "DeepSeek应用场景",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"关于DeepSeek/DeepSeek 创始团队介绍",

|

||||

"关于DeepSeek/DeepSeek 发展历程",

|

||||

"关于DeepSeek/什么是 DeepSeek"

|

||||

{

|

||||

"title": "DeepSeek + 理财",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 理财/DeepSeek告诉我:30岁到40岁,一般会拥有这么多的存款",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/用DeepSeek搞钱,日赚百万",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/普通人如何通过炒股买基金赚到100万?",

|

||||

"DeepSeek应用场景/DeepSeek + 理财/用Deepseek回答:如果有100万闲钱,几年内不用,该怎么理财?"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 编程开发",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/3 小时做游戏,10 天狂赚 28 万!程序员用 AI 躺赚?",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/💗用 DeepSeek 给对象做个网站,她一定感动坏了",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/DeepSeek装进VSCode,编程非常丝滑!",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/教你用DeepSeek+Clien,从0到1开发一个APP",

|

||||

"DeepSeek应用场景/DeepSeek + 编程开发/DeepSeek接入Python,一般电脑也能飞速跑,确实可以封神了!"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 创意设计",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/和 Deepseek 联手,做个哪吒的乾坤圈视频",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/5 个不得不收藏的 Deepseek 王炸组合!",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/DeepSeek一句话搞定修图难题",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/deepseek+数字人王炸组合使用方法",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/用 deepseek 做 AI 视频,绝了,和抄作业一样简单!",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/绝绝子!用deepseek做AI视频,涨粉10W+(附保姆级教程)",

|

||||

"DeepSeek应用场景/DeepSeek + 创意设计/这怕是全网最强的 DeepSeek 图片教程吧,赶紧收藏了!"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 办公效率",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/如何用DeepSeek更高效地工作:10个实用技巧",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/手把手教你在word中接入deepseek,秒生文档材料",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/法律人保姆级deepseek使用指南(附指令版)",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek R1 + 个人知识库,直接起飞!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek嵌入到Excel,提升10倍工作效率,太牛了!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/DeepSeek配合KIMI,自动生成PPT,感觉自己要失业了!",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/WPS里装上deepseek,简直就是办公神器",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/利用deepseek建立专属销售知识库",

|

||||

"DeepSeek应用场景/DeepSeek + 办公效率/教师必备DeepSeek使用指南来了!5大教学应用场景+实操案例+隐藏用法"

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek + 内容创作",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/3秒让DeepSeek写出爆款小红书",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/人有多大胆,地有多大产:如何用DeepSeek写长篇小说",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/如何利用DeepSeek进行高效内容创作",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/用DeepSeek做小红书真的太牛了!轻轻松松打造爆款笔记",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/用DeepSeek写文章?这4个骚操作让你躺平也能出爆款!(含提示词)",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/DeepSeek使用指南:提升公文、新闻与广告文案写作效率的三大技巧 ",

|

||||

"DeepSeek应用场景/DeepSeek + 内容创作/AI写小说怎么写?deepseek帮你写小说教程"

|

||||

]

|

||||

}

|

||||

]

|

||||

},

|

||||

{

|

||||

"title": "DeepSeek使用指南",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek使用指南/🔥DeepSeek 小白快速上手指南",

|

||||

"DeepSeek使用指南/几个技巧,教你去除文章的 AI 味!",

|

||||

"DeepSeek使用指南/DeepSeek 发布新模型 V3-0324,附使用教程",

|

||||

"DeepSeek使用指南/最新清华大学DeepSeek使用手册第1-5版,官方完整版PDF免费下载",

|

||||

"DeepSeek使用指南/2分钟学会 DeepSeek API,竟然比官方更好用!",

|

||||

"DeepSeek使用指南/完整攻略:如何用好DeepSeek,一文汇总!",

|

||||

"DeepSeek使用指南/【汇总】满血版 DeepSeek 第三方使用渠道",

|

||||

"DeepSeek使用指南/DeepSeek 本地部署教程",

|

||||

"DeepSeek使用指南/如何在iPhone上用语音调用Deepseek",

|

||||

"DeepSeek使用指南/普通人能用DeepSeek做什么?20个实用建议",

|

||||

{

|

||||

"title": "DeepSeek 提问技巧",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/50个常用的DeepSeek模仿风格提示词,去AI味的大杀器",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/我发现了 DeepSeek 去 AI 味的捷径,太香了",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/DeepSeek 提示词基本法则",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/DeepSeek不好用?那是你还不知道这些指令!",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/吐血整理!DeepSeek神级指令,好用到爆!",

|

||||

"DeepSeek使用指南/DeepSeek 提问技巧/普通人也能轻松掌握的 20 个 DeepSeek 高频提示词(2025版)"

|

||||

]

|

||||

}

|

||||

]

|

||||

}

|

||||

]

|

||||

|

||||

@@ -0,0 +1,22 @@

|

||||

# Claude 现已支持网络搜索功能

|

||||

|

||||

2025 年 3 月 20 日

|

||||

|

||||

|

||||

|

||||

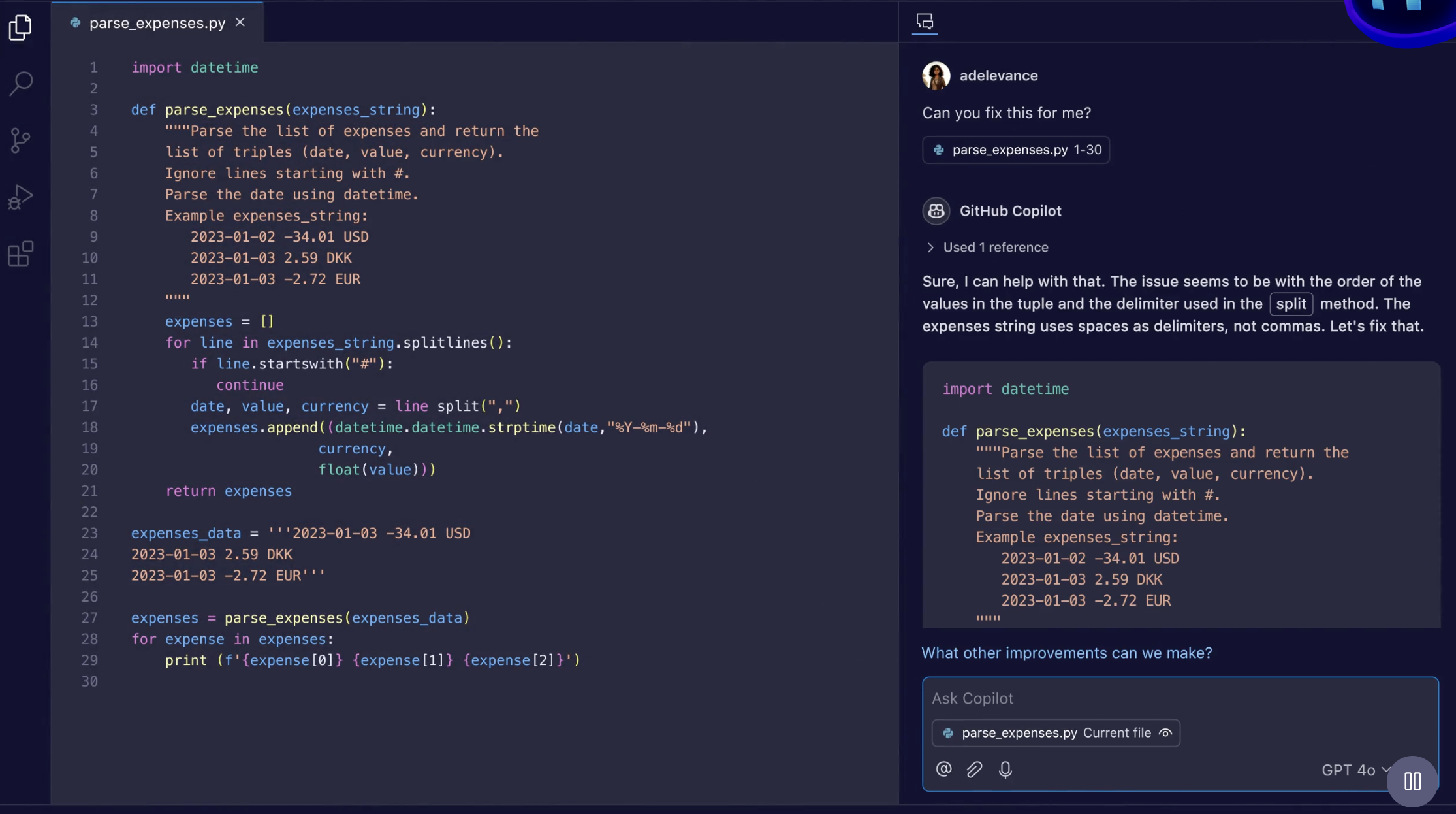

您现在可以使用 Claude 进行互联网搜索,以提供更及时和相关的回答。借助网络搜索功能,Claude 能够获取最新的事件和信息,从而在需要最新数据的任务中提高准确性。

|

||||

|

||||

当 Claude 将网络信息整合到回答中时,它会提供直接引用来源,方便您核实事实。无需自行查找搜索结果,Claude 会以对话形式处理和呈现相关来源。这一功能通过实时洞察扩展了 Claude 的广泛知识库,使其能够基于更当前的信息提供答案。

|

||||

|

||||

使用 Claude 网络搜索的常见场景:

|

||||

|

||||

- **销售团队** 可以通过分析行业趋势,了解关键举措和痛点,从而优化客户规划并提高成交率。

|

||||

- **金融分析师** 可以评估当前市场数据、财报和行业趋势,以做出更好的投资决策并为财务模型假设提供依据。

|

||||

- **研究人员** 可以通过搜索网络上的主要来源,发现新兴趋势并识别当前文献中的空白,从而撰写更有力的资助提案和文献综述。

|

||||

- **购物者** 可以比较不同来源的产品功能、价格和评价,以做出更明智的购买决策。

|

||||

|

||||

## 开始使用

|

||||

|

||||

网络搜索功能现已作为预览功能向美国的所有付费 Claude 用户开放。免费计划用户和其他国家/地区的支持将很快推出。要开始使用,请在您的[个人资料设置](https://claude.ai/settings/profile#feature-preview)中启用网络搜索功能,并与 Claude 3.7 Sonnet 开始对话。在适用的情况下,Claude 会搜索网络以完善其回答。

|

||||

|

||||

> 来源:claude 官方博客

|

||||

@@ -0,0 +1,57 @@

|

||||

# DeepSeek-V3 模型更新,各项能力全面进阶

|

||||

|

||||

DeepSeek V3 模型已完成小版本升级,目前版本号 DeepSeek-V3-0324,用户登录官方网页、APP、小程序进入对话界面后, **关闭深度思考** 即可体验。API 接口和使用方式保持不变。

|

||||

|

||||

如非复杂推理任务,建议使用新版本 V3 模型,即刻享受速度更加流畅、效果全面提升的对话体验。

|

||||

|

||||

---

|

||||

|

||||

## 模型能力提升一览

|

||||

|

||||

### 推理任务表现提高

|

||||

|

||||

新版 V3 模型借鉴 DeepSeek-R1 模型训练过程中所使用的强化学习技术,大幅提高了在推理类任务上的表现水平,在数学、代码类相关评测集上取得了超过 GPT-4.5 的得分成绩。

|

||||

|

||||

|

||||

|

||||

### 前端开发能力增强

|

||||

|

||||

在 HTML 等代码前端任务上,新版 V3 模型生成的代码可用性更高,视觉效果也更加美观、富有设计感。

|

||||

|

||||

|

||||

|

||||

### 中文写作升级

|

||||

|

||||

在中文写作任务方面,新版 V3 模型基于 R1 的写作水平进行了进一步优化,同时特别提升了中长篇文本创作的内容质量。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

### 中文搜索能力优化

|

||||

|

||||

新版 V3 模型可以在联网搜索场景下,对于报告生成类指令输出内容更为详实准确、排版更加清晰美观的结果。

|

||||

|

||||

|

||||

|

||||

此外,新版 V3 模型在 **工具调用、角色扮演、问答闲聊** 等方面也得到了一定幅度的能力提升。

|

||||

|

||||

---

|

||||

|

||||

## 模型开源

|

||||

|

||||

DeepSeek-V3-0324 与之前的 DeepSeek-V3 使用同样的 base 模型,仅改进了后训练方法。私有化部署时只需要更新 checkpoint 和 tokenizer_config.json(tool calls 相关变动)。模型参数约 660B,开源版本上下文长度为 128K(网页端、App 和 API 提供 64K 上下文)。V3-0324 模型权重下载请参考:

|

||||

|

||||

- Model Scope: [https://modelscope.cn/models/deepseek-ai/DeepSeek-V3-0324](https://modelscope.cn/models/deepseek-ai/DeepSeek-V3-0324)

|

||||

- Huggingface: [https://huggingface.co/deepseek-ai/DeepSeek-V3-0324](https://huggingface.co/deepseek-ai/DeepSeek-V3-0324)

|

||||

|

||||

与 DeepSeek-R1 保持一致,此次我们的开源仓库(包括模型权重)统一采用 MIT License,并允许用户利用模型输出、通过模型蒸馏等方式训练其他模型。

|

||||

|

||||

- [模型能力提升一览](https://api-docs.deepseek.com/zh-cn/news/news250325#%E6%A8%A1%E5%9E%8B%E8%83%BD%E5%8A%9B%E6%8F%90%E5%8D%87%E4%B8%80%E8%A7%88)

|

||||

- [推理任务表现提高](https://api-docs.deepseek.com/zh-cn/news/news250325#%E6%8E%A8%E7%90%86%E4%BB%BB%E5%8A%A1%E8%A1%A8%E7%8E%B0%E6%8F%90%E9%AB%98)

|

||||

- [前端开发能力增强](https://api-docs.deepseek.com/zh-cn/news/news250325#%E5%89%8D%E7%AB%AF%E5%BC%80%E5%8F%91%E8%83%BD%E5%8A%9B%E5%A2%9E%E5%BC%BA)

|

||||

- [中文写作升级](https://api-docs.deepseek.com/zh-cn/news/news250325#%E4%B8%AD%E6%96%87%E5%86%99%E4%BD%9C%E5%8D%87%E7%BA%A7)

|

||||

- [中文搜索能力优化](https://api-docs.deepseek.com/zh-cn/news/news250325#%E4%B8%AD%E6%96%87%E6%90%9C%E7%B4%A2%E8%83%BD%E5%8A%9B%E4%BC%98%E5%8C%96)

|

||||

- [模型开源](https://api-docs.deepseek.com/zh-cn/news/news250325#%E6%A8%A1%E5%9E%8B%E5%BC%80%E6%BA%90)

|

||||

|

||||

> 来源:deepseek 官方

|

||||

@@ -0,0 +1,13 @@

|

||||

# Ideogram 正式发布 3.0 版本模型:真实感与创意表现再突破

|

||||

|

||||

Ideogram 官方宣布推出其最新图像生成模型——Ideogram3.0。这一版本在真实感、创意表现力和风格一致性上实现了显著突破,被认为是图像生成领域的一次重要里程碑。新模型不仅对标 GPT-4o 等顶级 AI 系统,还以其高效性能和创新功能吸引了广泛关注。

|

||||

|

||||

Ideogram3. 0 在文本渲染能力上取得了质的飞跃。相较于市场上大多数图像生成模型,该版本能够生成清晰可读、风格统一的艺术化文本,支持复杂排版设计,包括海报标题、宣传标语、品牌口号及多行文字组合。其支持多字体、多语言和多层次设计的功能,使其在平面设计和创意应用场景中尤为突出。此外,新模型新增了“Style Reference”和“Random Style”功能,用户可通过指定风格或随机探索,快速生成多样化且高质量的图像内容。

|

||||

|

||||

在图像质量方面,Ideogram3. 0 的照片真实感、细节处理能力以及对用户提示的理解深度均达到新高度。专业测试显示,其在图文对齐、渲染精度和创意输出上表现优异,甚至超越了 Imagen3 等同类竞品。得益于优化的算法架构,新模型生成速度大幅提升,为用户提供了更高效的创作体验。

|

||||

|

||||

Ideogram3. 0 的发布标志着图像生成技术在实用性与艺术性结合上的又一次进步。目前,该模型已向全球用户免费开放,其强大的功能和易用性预计将为设计师、艺术家及内容创作者带来深远影响,助推 AI 驱动的创意产业迈向新阶段。

|

||||

|

||||

[Ideogram3.0](https://www.aibase.com/zh/search/Ideogram3.0&type=0) [图像生成模型](https://www.aibase.com/zh/search/%E5%9B%BE%E5%83%8F%E7%94%9F%E6%88%90%E6%A8%A1%E5%9E%8B&type=0) [AI](https://www.aibase.com/zh/search/AI&type=0) [GPT-4o](https://www.aibase.com/zh/search/GPT-4o&type=0)

|

||||

|

||||

> 本文来自 AIbase 日报

|

||||

@@ -0,0 +1,532 @@

|

||||

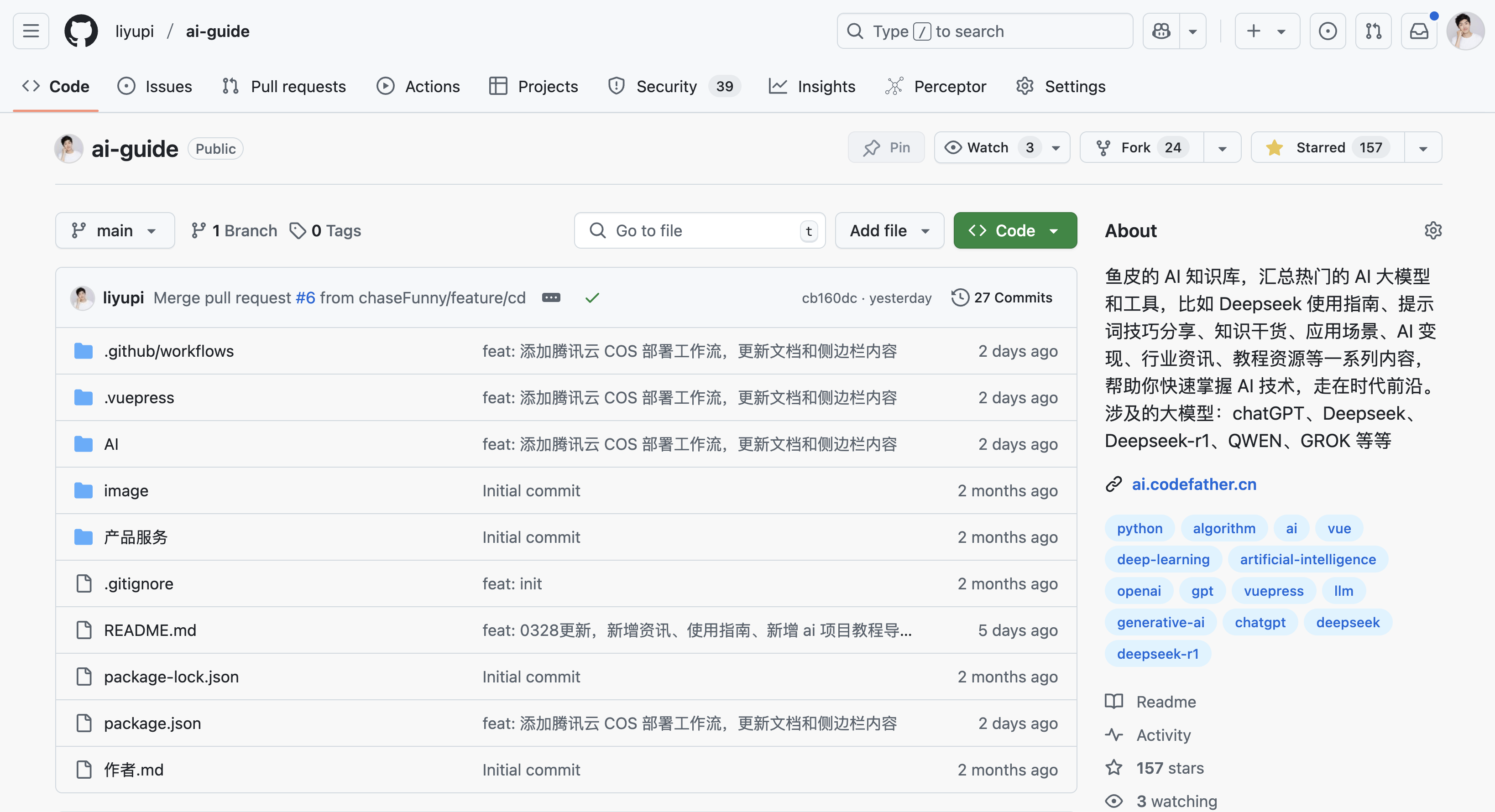

# Model Context Protocol,看这一篇就够了

|

||||

|

||||

|

||||

|

||||

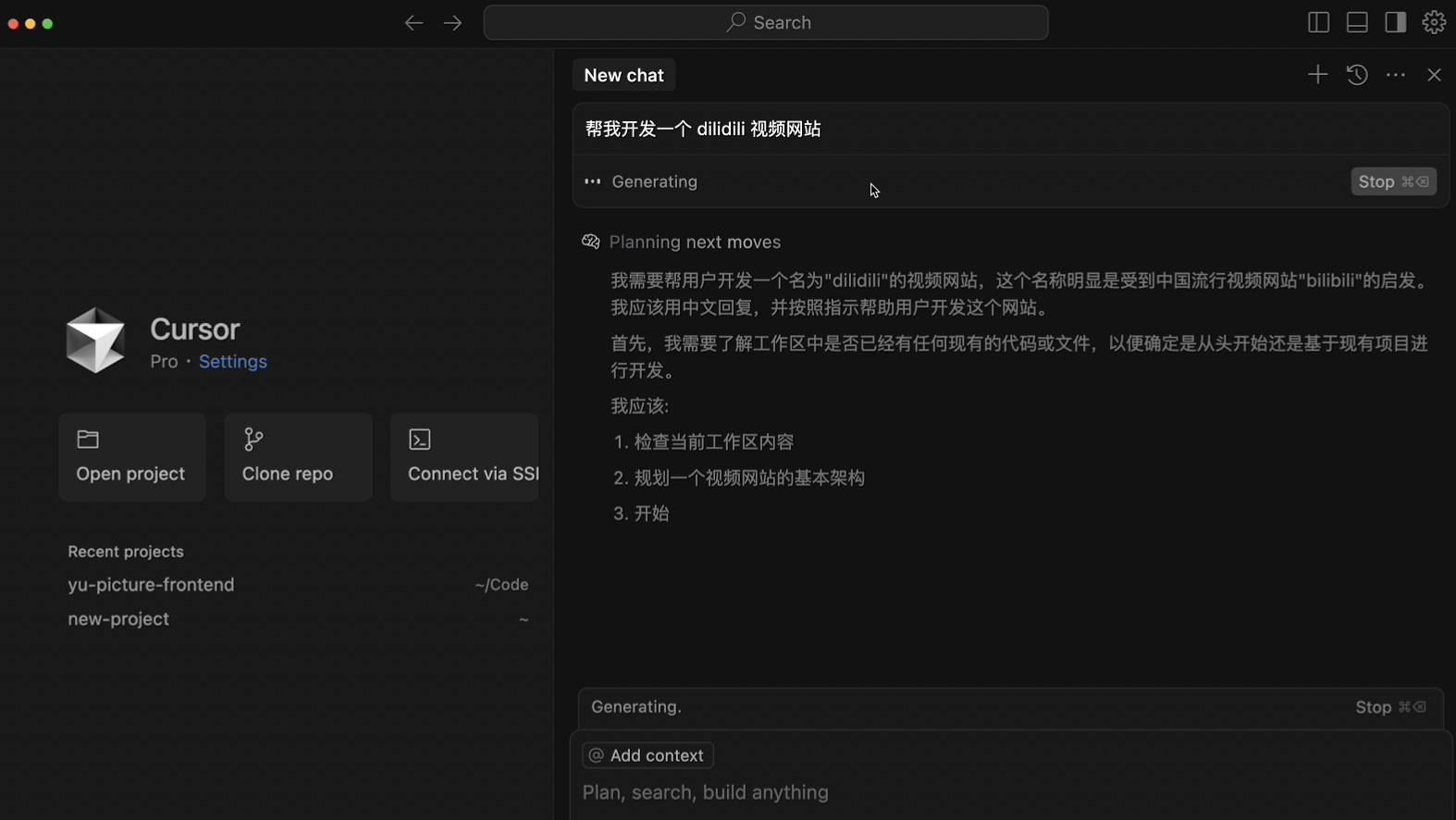

最近 MCP 这个关键词逐渐活跃在我所浏览的一些文章及评论区中。突然发现我对它仅有粗糙的理解,我决定深入学习并记录一下。

|

||||

|

||||

在阅读这篇文章前,我也简单地浏览了现有介绍 MCP 的文章。我发现大部分文章停留在“翻译” [https://modelcontextprotocol.io/](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/) 网站中的内容,或者花时间在绝大部分用户不关心的技术细节上(还有一些纯 AI 文)。

|

||||

|

||||

因此,我将从使用者的角度出发,分享实用内容,并以一个示例展示 MCP 的开发过程与实际应用作为结尾。本篇旨在回答以下三个问题:

|

||||

|

||||

- 什么是 MCP?

|

||||

- 为什么需要 MCP?

|

||||

- 作为用户,我们如何 **使用**/开发 MCP?

|

||||

|

||||

当然,一篇文章远远不足以讲透 MCP 的所有概念,只能尽力萃取最重要的内容供大家阅读,欢迎讨论。

|

||||

|

||||

Update 2025/03/15 进一步补充了关于第五节原理的解释。

|

||||

|

||||

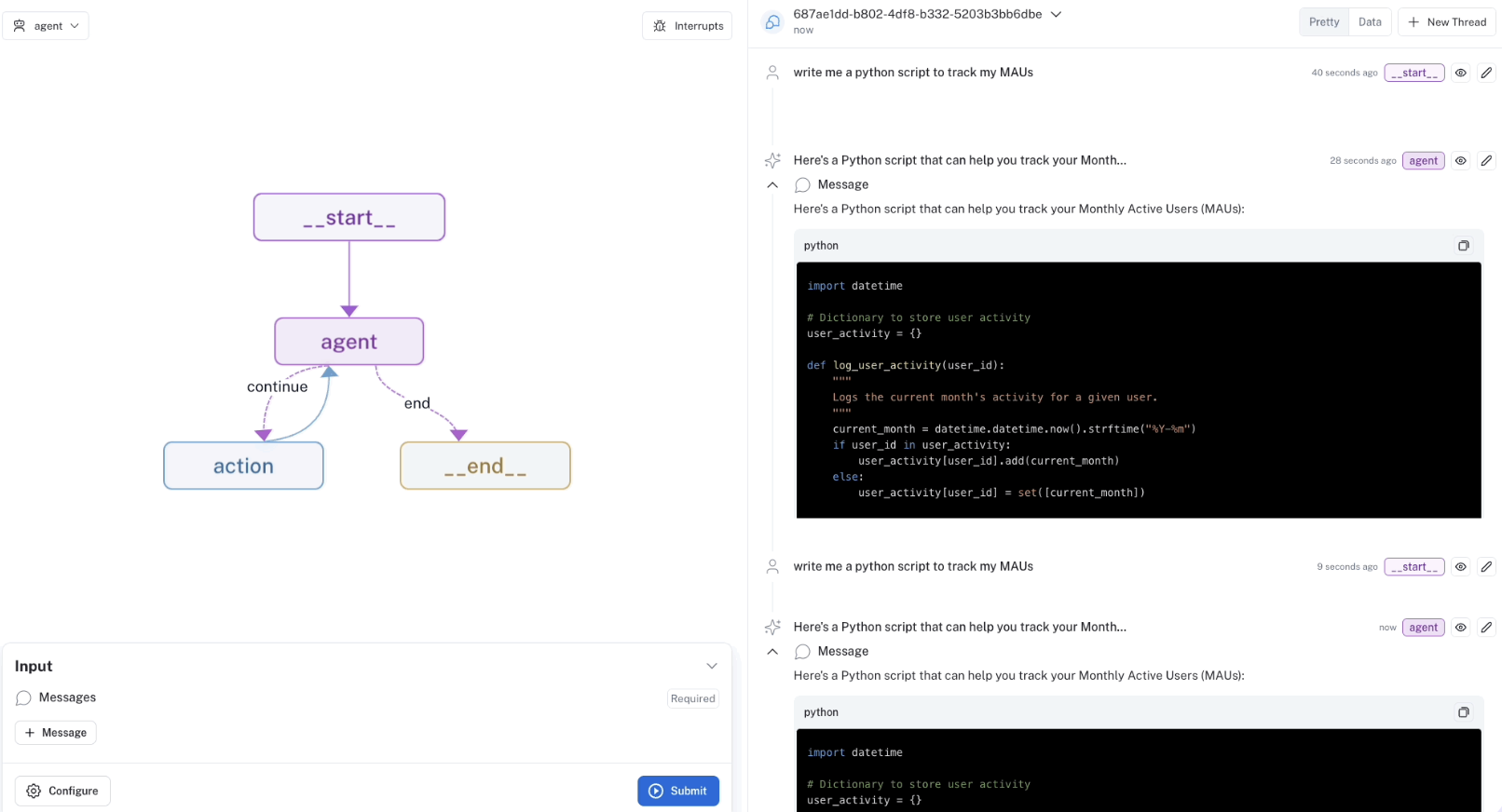

## 1\. What is MCP?

|

||||

|

||||

MCP 起源于 2024 年 11 月 25 日 [Anthropic](https://zhida.zhihu.com/search?content_id=254822599&content_type=Article&match_order=1&q=Anthropic&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDM4MzQwMDIsInEiOiJBbnRocm9waWMiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTQ4MjI1OTksImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.4EBFlFdfKyjVmM6AYwpAoEesLEZB2f3RIT-e-QtOfUs&zhida_source=entity) 发布的文章: [Introducing the Model Context Protocol](https://link.zhihu.com/?target=https%3A//www.anthropic.com/news/model-context-protocol)。

|

||||

|

||||

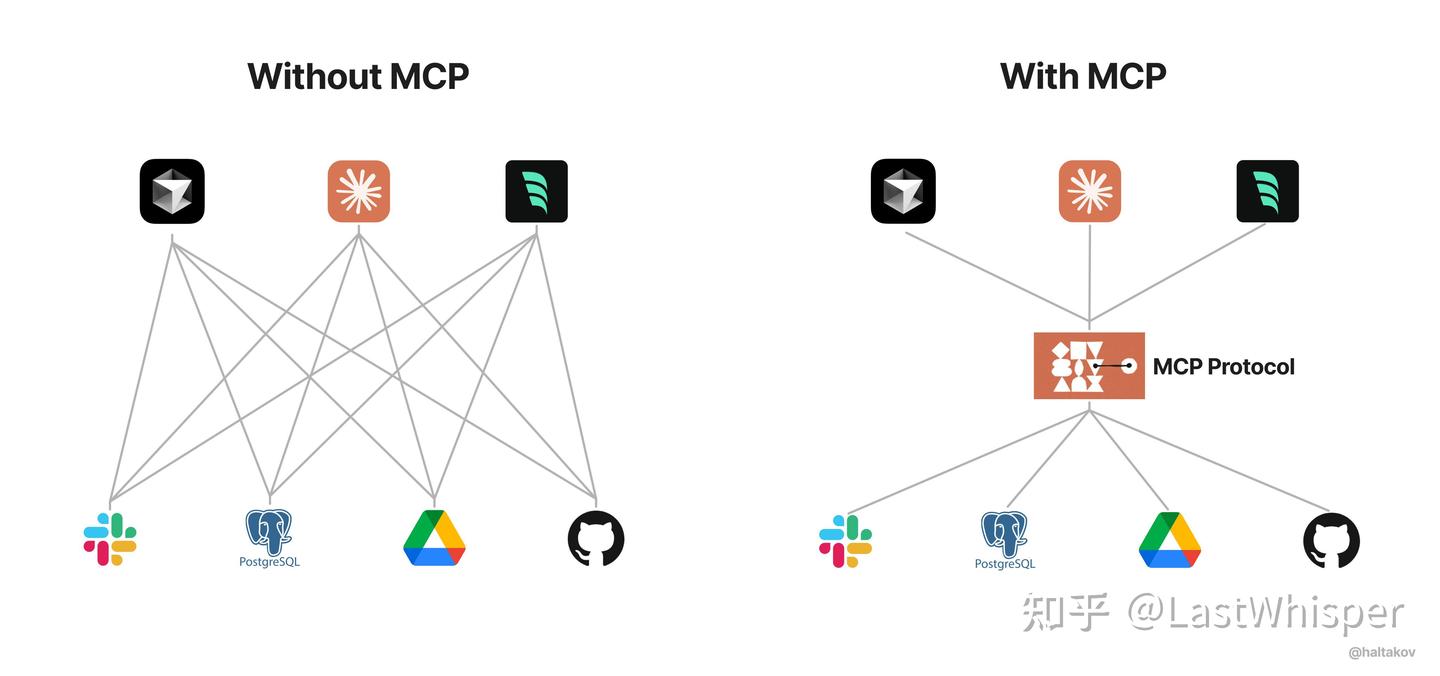

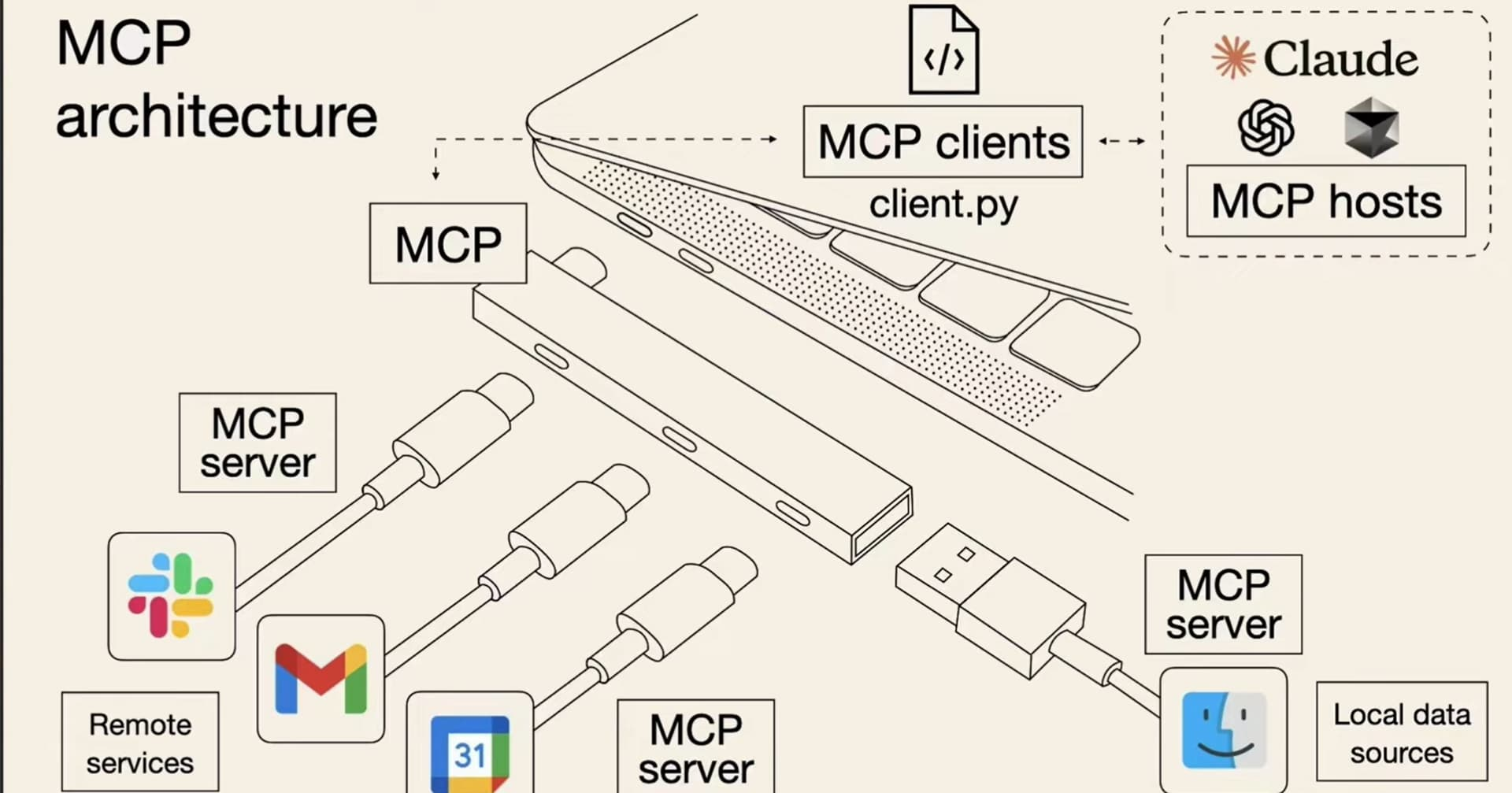

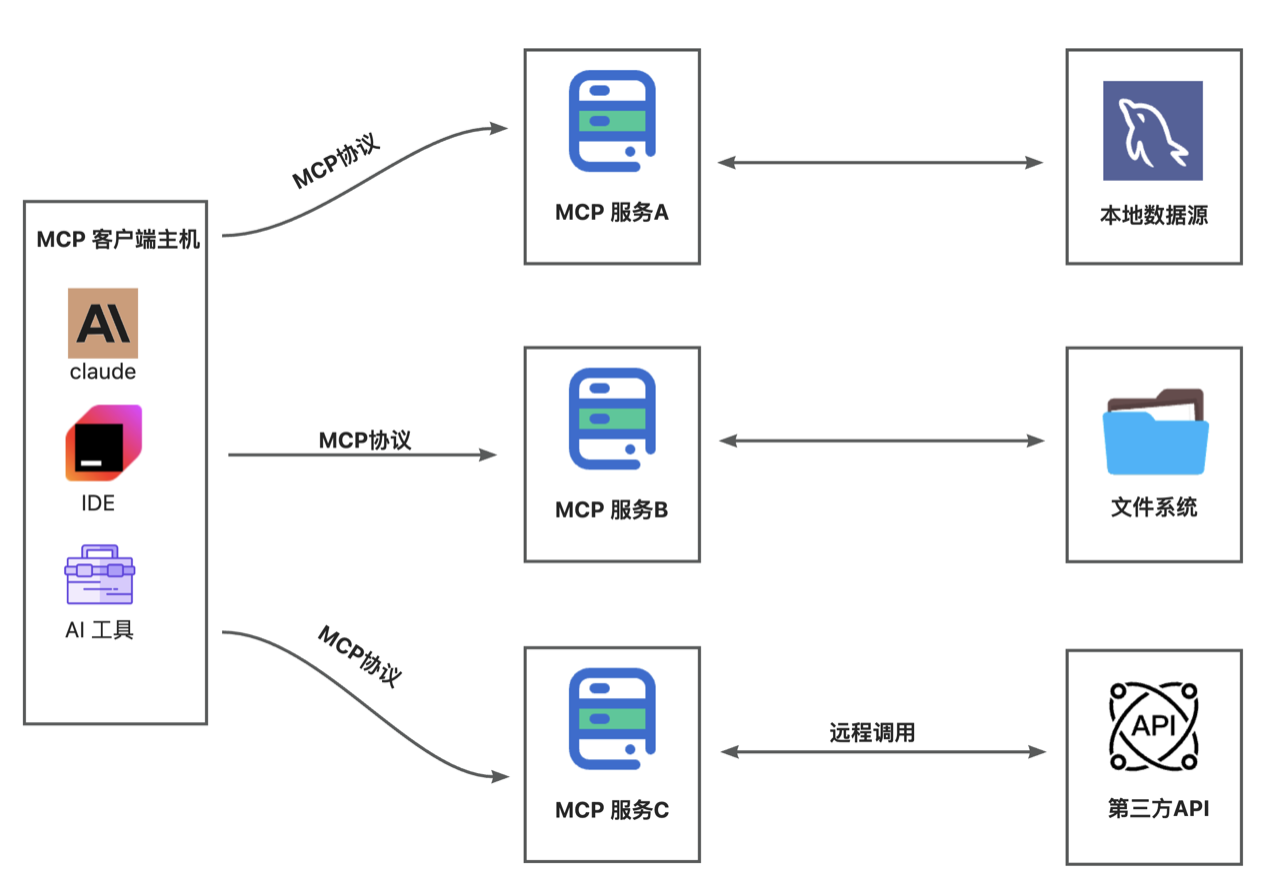

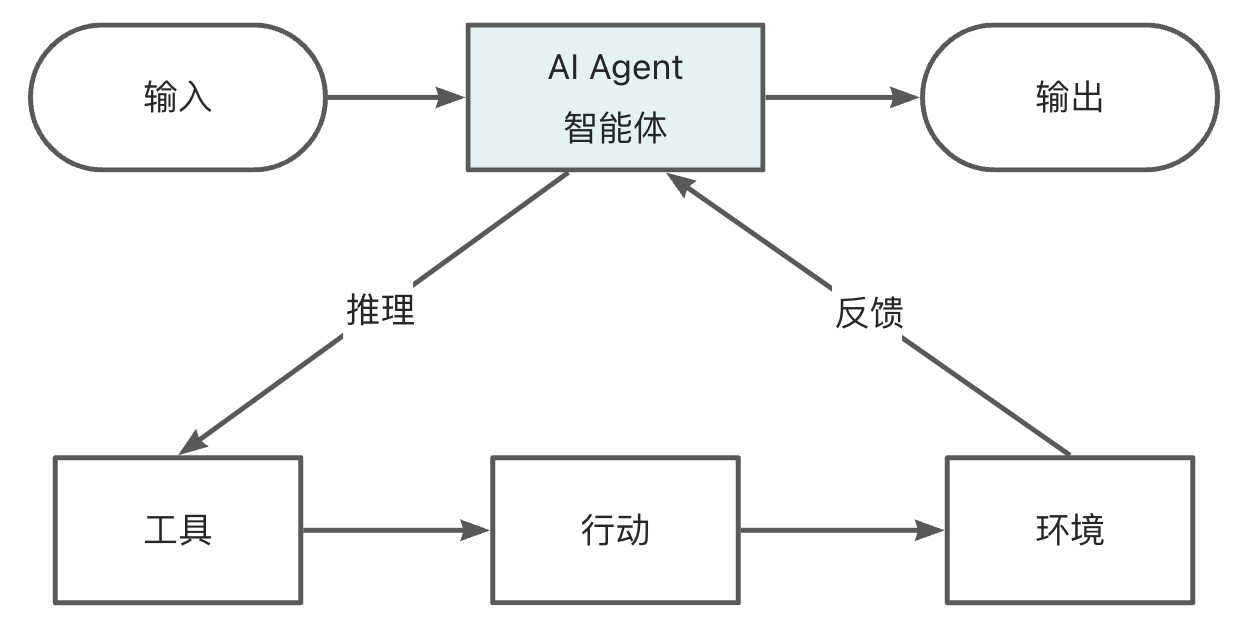

MCP(Model Context Protocol,模型上下文协议)定义了应用程序和 AI 模型之间交换上下文信息的方式。这使得开发者能够 **以一致的方式将各种数据源、工具和功能连接到 AI 模型**(一个中间协议层),就像 USB-C 让不同设备能够通过相同的接口连接一样。MCP 的目标是创建一个通用标准,使 AI 应用程序的开发和集成变得更加简单和统一。

|

||||

|

||||

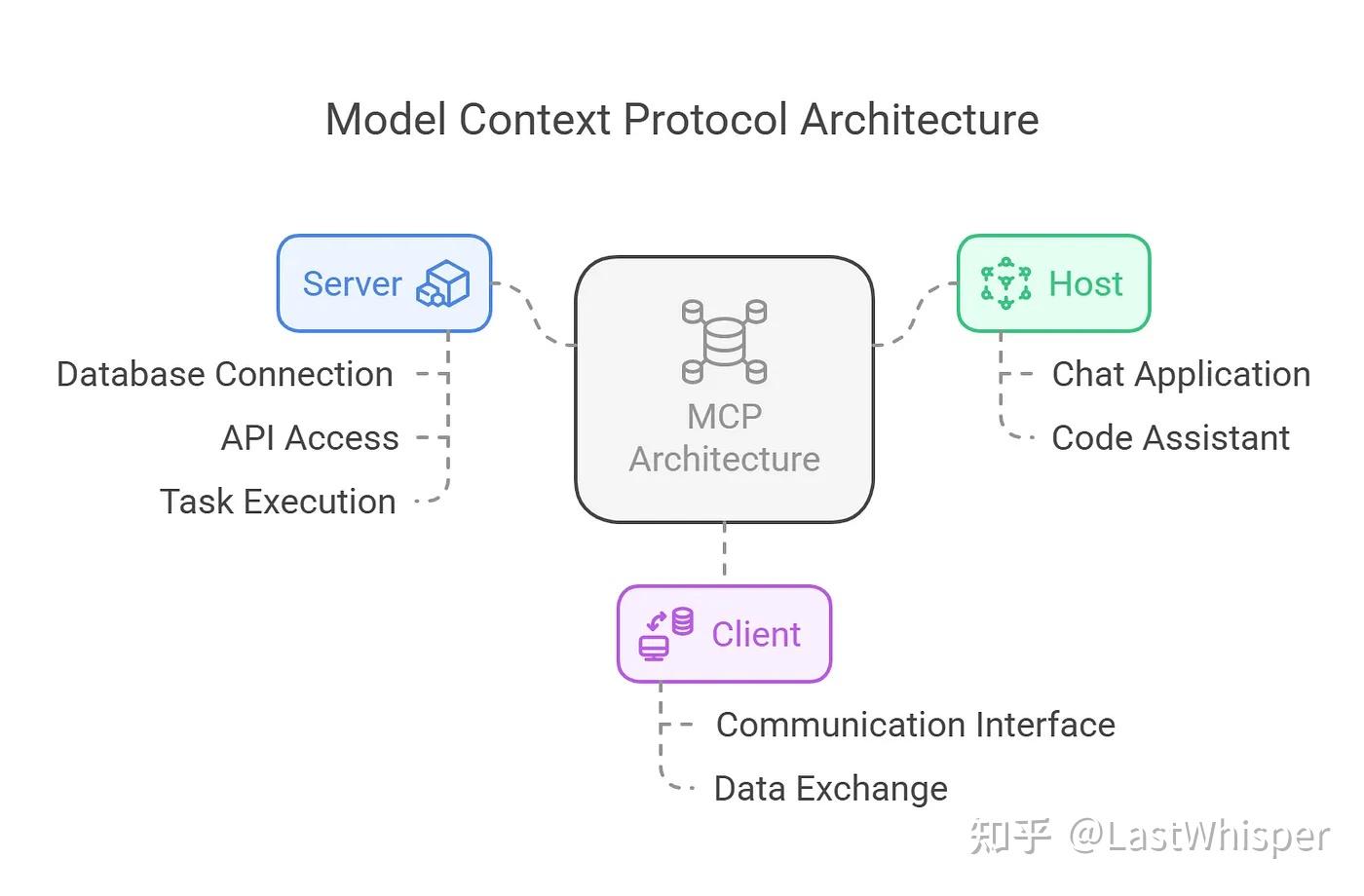

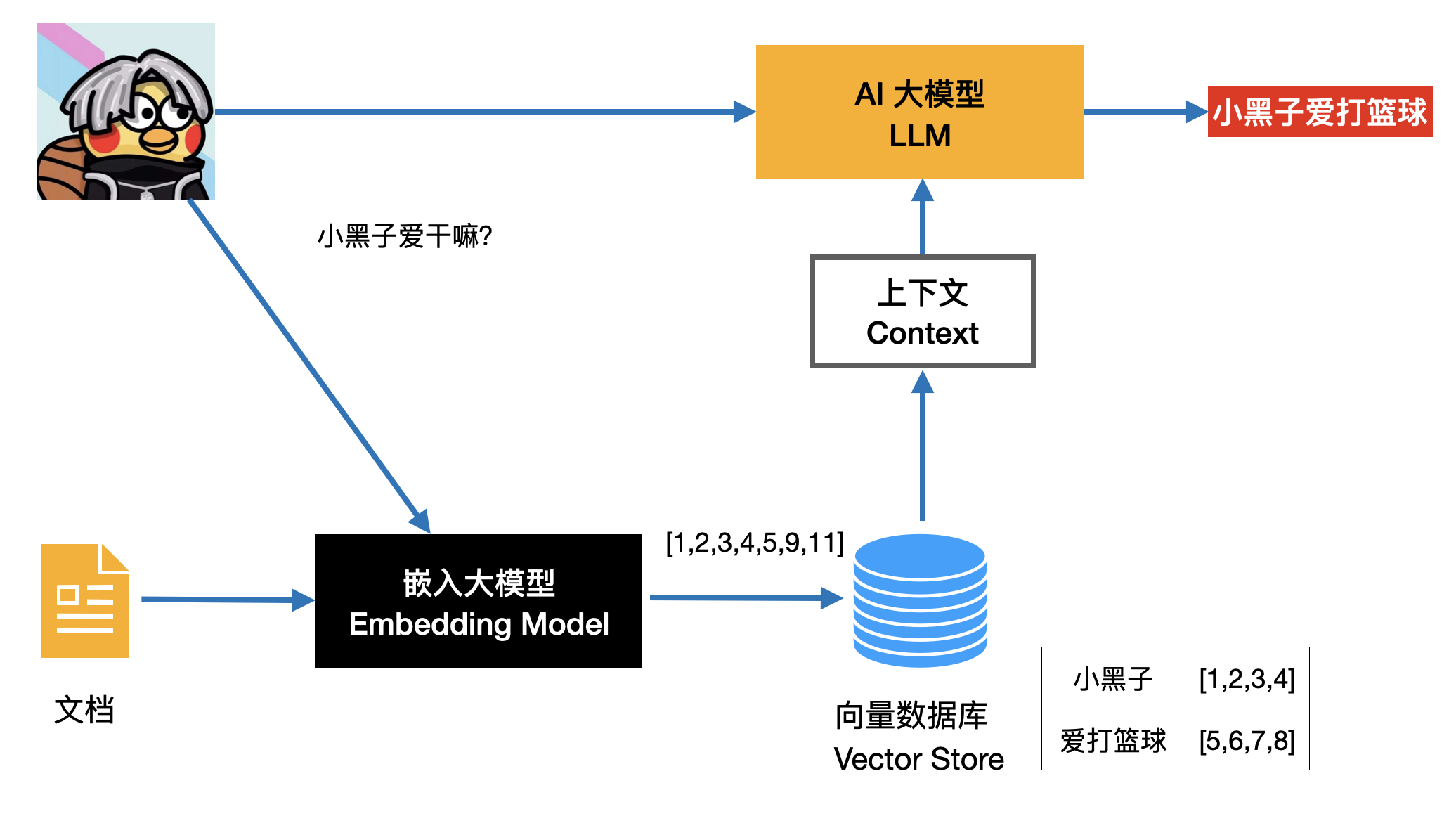

所谓一图胜千言,我这里引用一些制作的非常精良的图片来帮助理解:

|

||||

|

||||

|

||||

|

||||

可以看出,MCP 就是以更标准的方式让 LLM Chat 使用不同工具,更简单的可视化如下图所示,这样你应该更容易理解“中间协议层”的概念了。Anthropic 旨在实现 LLM Tool Call 的标准。

|

||||

|

||||

|

||||

|

||||

mcp 简单理解

|

||||

|

||||

> 为保证阅读的流畅性,本文将 MCP Host / Client / Server 的定义后置。初学者/用户可暂不关注这些概念,不影响对 MCP 的使用。

|

||||

|

||||

## 2\. Why MCP?

|

||||

|

||||

我认为 MCP 的出现是 prompt engineering 发展的产物。更结构化的上下文信息对模型的 performance 提升是显著的。我们在构造 prompt 时,希望能提供一些更 specific 的信息(比如本地文件,数据库,一些网络实时信息等)给模型,这样模型更容易理解真实场景中的问题。

|

||||

|

||||

**想象一下没有 MCP 之前我们会怎么做**?我们可能会人工从数据库中筛选或者使用工具检索可能需要的信息,手动的粘贴到 prompt 中。随着我们要解决的问题越来越复杂, **手工** 把信息引入到 prompt 中会变得越来越困难。

|

||||

|

||||

为了克服手工 prompt 的局限性,许多 LLM 平台(如 OpenAI、Google)引入了 `function call` 功能。这一机制允许模型在需要时调用预定义的函数来获取数据或执行操作,显著提升了自动化水平。

|

||||

|

||||

但是 function call 也有其局限性(我对于 function call vs MCP 的理解不一定成熟,欢迎大家补充),我认为重点在于 **function call 平台依赖性强**,不同 LLM 平台的 function call API 实现差异较大。例如,OpenAI 的函数调用方式与 Google 的不兼容,开发者在切换模型时需要重写代码,增加了适配成本。除此之外,还有安全性,交互性等问题。

|

||||

|

||||

**数据与工具本身是客观存在的**,只不过我们希望将数据连接到模型的这个环节可以更智能更统一。Anthropic 基于这样的痛点设计了 MCP,充当 AI 模型的"万能转接头",让 LLM 能轻松的获取数据或者调用工具。更具体的说 MCP 的优势在于:

|

||||

|

||||

- **生态** \- MCP 提供很多现成的插件,你的 AI 可以直接使用。

|

||||

- **统一性** \- 不限制于特定的 AI 模型,任何支持 MCP 的模型都可以灵活切换。

|

||||

- **数据安全** \- 你的敏感数据留在自己的电脑上,不必全部上传。(因为我们可以自行设计接口确定传输哪些数据)

|

||||

|

||||

## 3\. 用户如何使用 MCP?

|

||||

|

||||

对于用户来说,我们并不关心 MCP 是如何实现的,通常我们只考虑如何更简单的用上这一特性。

|

||||

|

||||

具体的使用方式参考官方文档: [For Claude Desktop Users](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/quickstart/user)。这里不再赘述,配置成功后可以在 Claude 中测试: `Can you write a poem and save it to my desktop?` Claude 会请求你的权限后在本地新建一个文件。

|

||||

|

||||

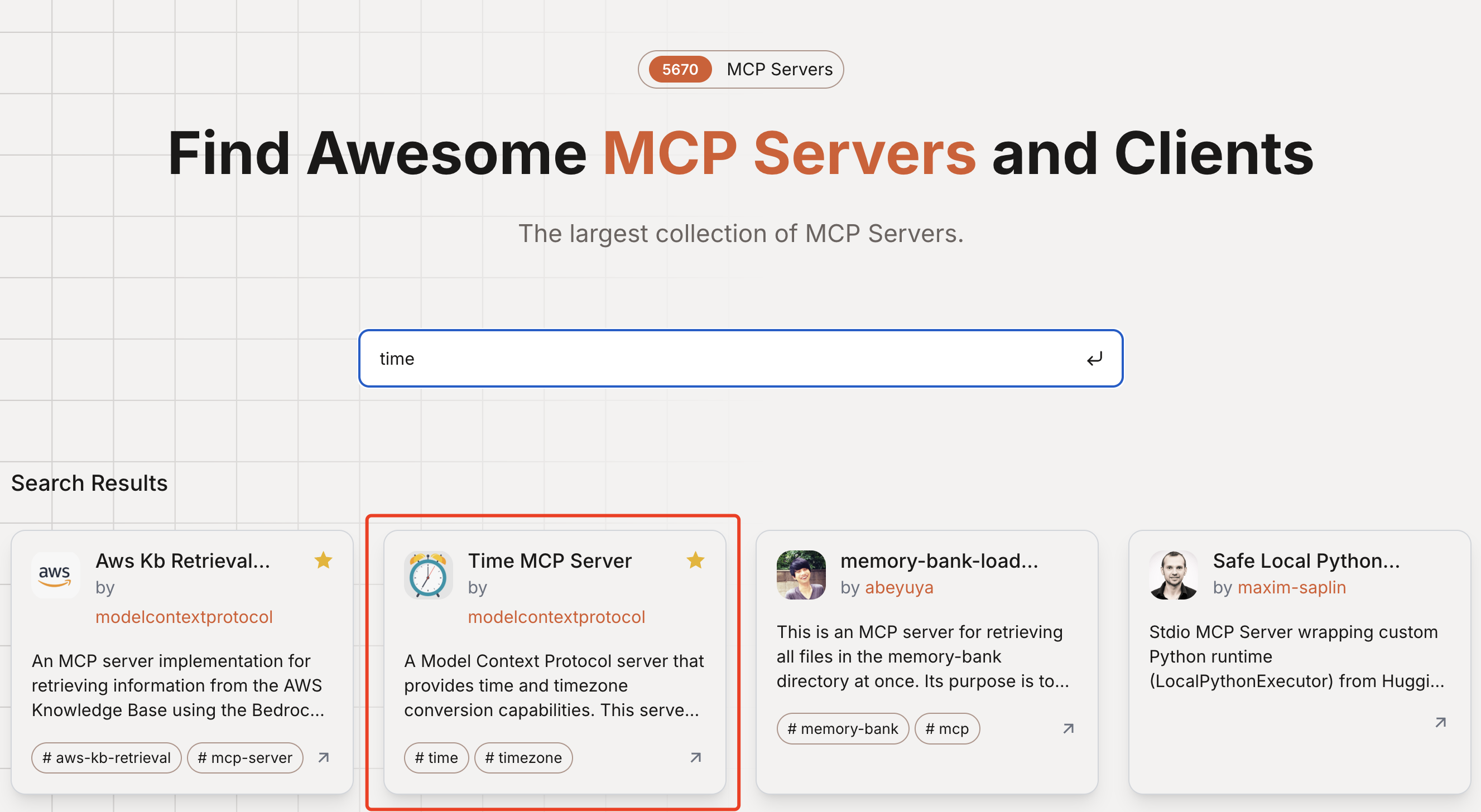

并且官方也提供了非常多现成的 MCP Servers,你只需要选择你希望接入的工具,然后接入即可。

|

||||

|

||||

- [Awesome MCP Servers](https://link.zhihu.com/?target=https%3A//github.com/punkpeye/awesome-mcp-servers)

|

||||

- [MCP Servers Website](https://link.zhihu.com/?target=https%3A//mcpservers.org/)

|

||||

- [Official MCP Servers](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/servers)

|

||||

|

||||

比如官方介绍的 `filesystem` 工具,它允许 Claude 读取和写入文件,就像在本地文件系统中一样。

|

||||

|

||||

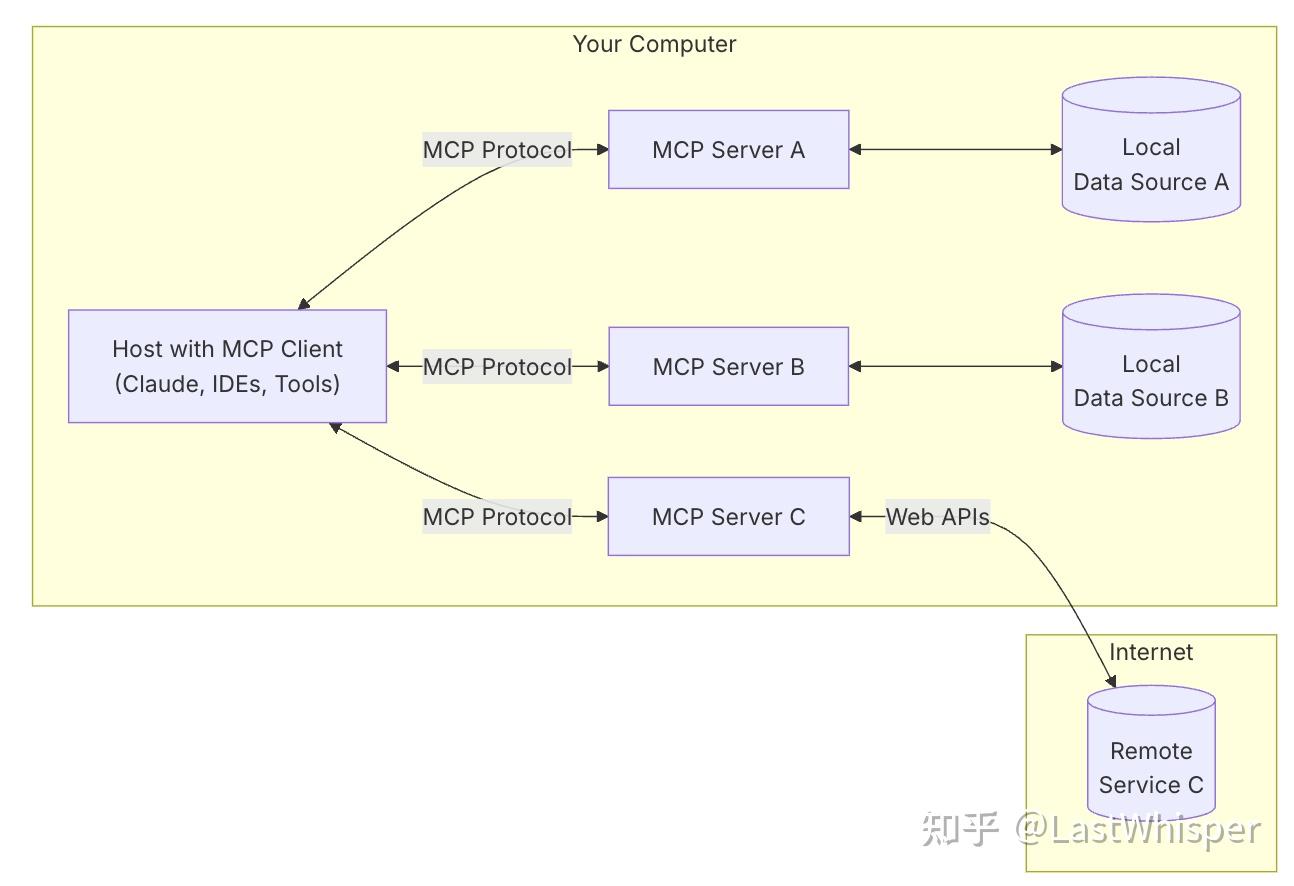

## 4\. MCP Architecture 解构

|

||||

|

||||

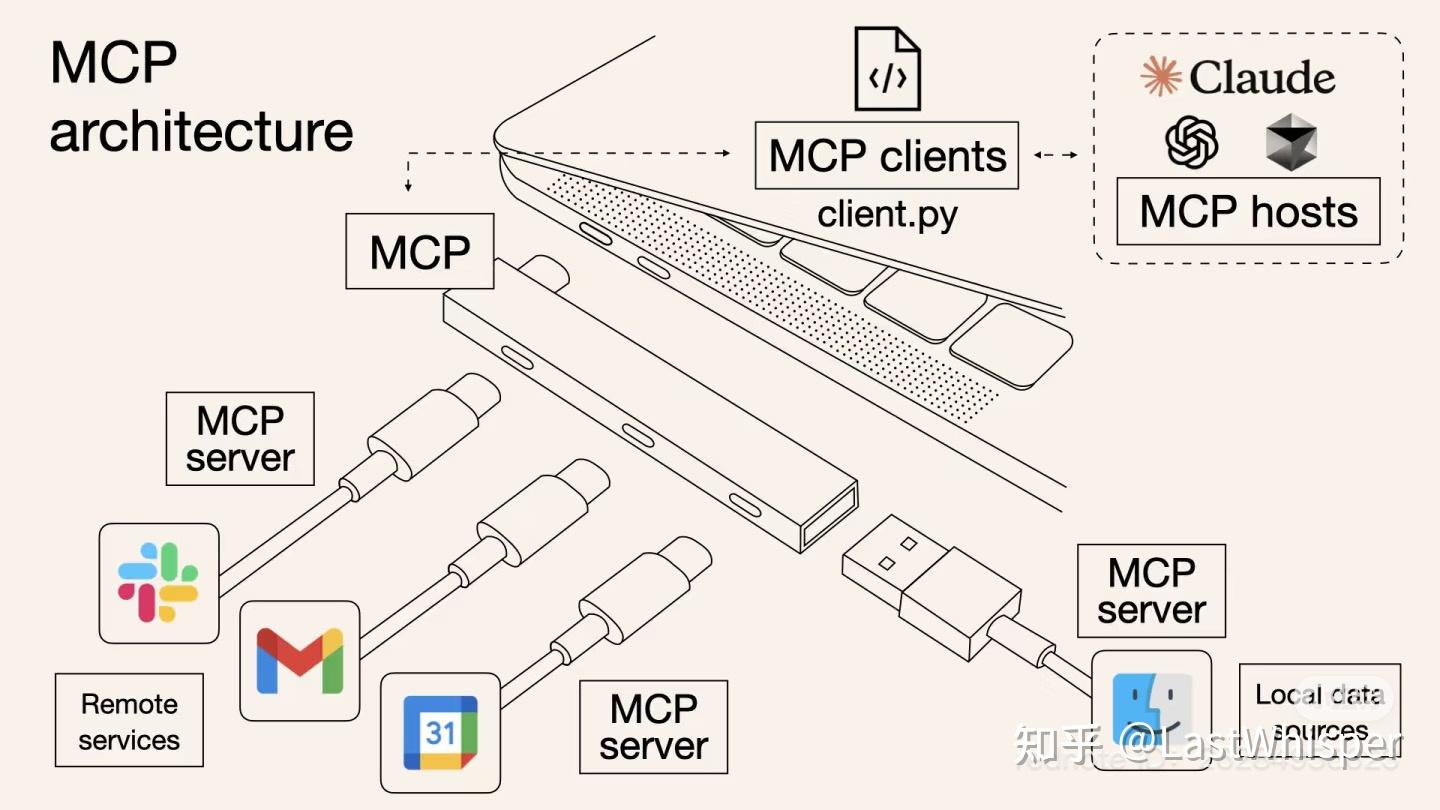

这里首先引用官方给出的架构图。

|

||||

|

||||

|

||||

|

||||

MCP 由三个核心组件构成:Host、Client 和 Server。让我们通过一个实际场景来理解这些组件如何协同工作:

|

||||

|

||||

假设你正在使用 Claude Desktop (Host) 询问:"我桌面上有哪些文档?"

|

||||

|

||||

1. **Host**:Claude Desktop 作为 Host,负责接收你的提问并与 Claude 模型交互。

|

||||

2. **Client**:当 Claude 模型决定需要访问你的文件系统时,Host 中内置的 MCP Client 会被激活。这个 Client 负责与适当的 MCP Server 建立连接。

|

||||

3. **Server**:在这个例子中,文件系统 MCP Server 会被调用。它负责执行实际的文件扫描操作,访问你的桌面目录,并返回找到的文档列表。

|

||||

|

||||

整个流程是这样的:你的问题 → Claude Desktop(Host) → Claude 模型 → 需要文件信息 → MCP Client 连接 → 文件系统 MCP Server → 执行操作 → 返回结果 → Claude 生成回答 → 显示在 Claude Desktop 上。

|

||||

|

||||

这种架构设计使得 Claude 可以在不同场景下灵活调用各种工具和数据源,而开发者只需专注于开发对应的 MCP Server,无需关心 Host 和 Client 的实现细节。

|

||||

|

||||

|

||||

|

||||

## 5\. 原理:模型是如何确定工具的选用的?

|

||||

|

||||

在学习的过程中,我一直好奇一个问题: **Claude(模型)是在什么时候确定使用哪些工具的呢**?好在 Anthropic 为我们提供了详细的 [解释](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/quickstart/server%23what%25E2%2580%2599s-happening-under-the-hood):

|

||||

|

||||

当用户提出一个问题时:

|

||||

|

||||

1. 客户端(Claude Desktop / Cursor)将你的问题发送给 Claude。

|

||||

2. Claude 分析可用的工具,并决定使用哪一个(或多个)。

|

||||

3. 客户端通过 MCP Server 执行所选的工具。

|

||||

4. 工具的执行结果被送回给 Claude。

|

||||

5. Claude 结合执行结果构造最终的 prompt 并生成自然语言的回应。

|

||||

6. 回应最终展示给用户!

|

||||

|

||||

> MCP Server 是由 Claude 主动选择并调用的。有意思的是 Claude 具体是如何确定该使用哪些工具呢?以及是否会使用一些不存在的工具呢(幻觉)?

|

||||

|

||||

**(原谅我之前解释的过于简单)** 为了探索这个问题让我们深入 [源码](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk/tree/main/examples/clients/simple-chatbot/mcp_simple_chatbot)。显然这个调用过程可以分为两个步骤:

|

||||

|

||||

1. 由 LLM(Claude)确定使用哪些 MCP Server。

|

||||

2. 执行对应的 MCP Server 并对执行结果进行重新处理。

|

||||

|

||||

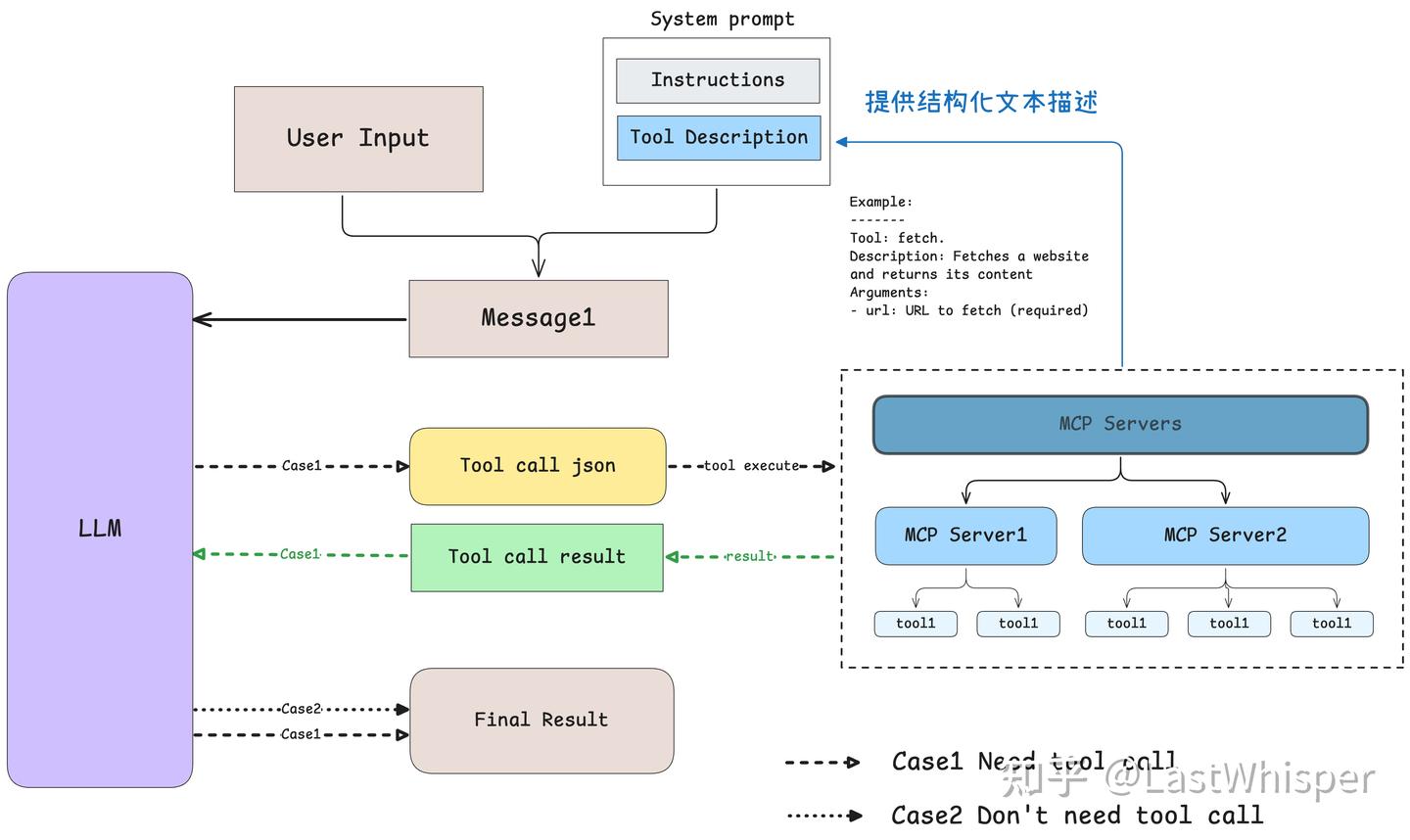

先给出一个简单可视化帮助理解:

|

||||

|

||||

|

||||

|

||||

### 5.1 模型如何智能选择工具?

|

||||

|

||||

先理解第一步 **模型如何确定该使用哪些工具?** 这里以 MCP 官方提供的 [client example](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk/tree/main/examples/clients/simple-chatbot/mcp_simple_chatbot) 为讲解示例,并简化了对应的代码(删除了一些不影响阅读逻辑的异常控制代码)。通过阅读代码,可以发现模型是通过 prompt 来确定当前有哪些工具。我们通过 **将工具的具体使用描述以文本的形式传递给模型**,供模型了解有哪些工具以及结合实时情况进行选择。参考代码中的注释:

|

||||

|

||||

```python

|

||||

... # 省略了无关的代码

|

||||

async def start(self):

|

||||

# 初始化所有的 mcp server

|

||||

for server in self.servers:

|

||||

await server.initialize()

|

||||

|

||||

# 获取所有的 tools 命名为 all_tools

|

||||

all_tools = []

|

||||

for server in self.servers:

|

||||

tools = await server.list_tools()

|

||||

all_tools.extend(tools)

|

||||

|

||||

# 将所有的 tools 的功能描述格式化成字符串供 LLM 使用

|

||||

# tool.format_for_llm() 我放到了这段代码最后,方便阅读。

|

||||

tools_description = "\n".join(

|

||||

[tool.format_for_llm() for tool in all_tools]

|

||||

)

|

||||

|

||||

# 这里就不简化了,以供参考,实际上就是基于 prompt 和当前所有工具的信息

|

||||

# 询问 LLM(Claude)应该使用哪些工具。

|

||||

system_message = (

|

||||

"You are a helpful assistant with access to these tools:\n\n"

|

||||

f"{tools_description}\n"

|

||||

"Choose the appropriate tool based on the user's question. "

|

||||

"If no tool is needed, reply directly.\n\n"

|

||||

"IMPORTANT: When you need to use a tool, you must ONLY respond with "

|

||||

"the exact JSON object format below, nothing else:\n"

|

||||

"{\n"

|

||||

' "tool": "tool-name",\n'

|

||||

' "arguments": {\n'

|

||||

' "argument-name": "value"\n'

|

||||

" }\n"

|

||||

"}\n\n"

|

||||

"After receiving a tool's response:\n"

|

||||

"1. Transform the raw data into a natural, conversational response\n"

|

||||

"2. Keep responses concise but informative\n"

|

||||

"3. Focus on the most relevant information\n"

|

||||

"4. Use appropriate context from the user's question\n"

|

||||

"5. Avoid simply repeating the raw data\n\n"

|

||||

"Please use only the tools that are explicitly defined above."

|

||||

)

|

||||

messages = [{"role": "system", "content": system_message}]

|

||||

|

||||

while True:

|

||||

# Final... 假设这里已经处理了用户消息输入。

|

||||

messages.append({"role": "user", "content": user_input})

|

||||

|

||||

# 将 system_message 和用户消息输入一起发送给 LLM

|

||||

llm_response = self.llm_client.get_response(messages)

|

||||

|

||||

... # 后面和确定使用哪些工具无关

|

||||

|

||||

|

||||

class Tool:

|

||||

"""Represents a tool with its properties and formatting."""

|

||||

|

||||

def __init__(

|

||||

self, name: str, description: str, input_schema: dict[str, Any]

|

||||

) -> None:

|

||||

self.name: str = name

|

||||

self.description: str = description

|

||||

self.input_schema: dict[str, Any] = input_schema

|

||||

|

||||

# 把工具的名字 / 工具的用途(description)和工具所需要的参数(args_desc)转化为文本

|

||||

def format_for_llm(self) -> str:

|

||||

"""Format tool information for LLM.

|

||||

|

||||

Returns:

|

||||

A formatted string describing the tool.

|

||||

"""

|

||||

args_desc = []

|

||||

if "properties" in self.input_schema:

|

||||

for param_name, param_info in self.input_schema["properties"].items():

|

||||

arg_desc = (

|

||||

f"- {param_name}: {param_info.get('description', 'No description')}"

|

||||

)

|

||||

if param_name in self.input_schema.get("required", []):

|

||||

arg_desc += " (required)"

|

||||

args_desc.append(arg_desc)

|

||||

|

||||

return f"""

|

||||

Tool: {self.name}

|

||||

Description: {self.description}

|

||||

Arguments:

|

||||

{chr(10).join(args_desc)}

|

||||

"""

|

||||

```

|

||||

|

||||

那 tool 的描述和代码中的 `input_schema` 是从哪里来的呢?通过进一步分析 MCP 的 Python SDK 源代码可以发现:大部分情况下,当使用装饰器 `@mcp.tool()` 来装饰函数时,对应的 `name` 和 `description` 等其实直接源自用户定义函数的函数名以及函数的 `docstring` 等。这里仅截取一小部分片段,想了解更多请参考 [原始代码](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk/blob/main/src/mcp/server/fastmcp/tools/base.py%23L34-L73)。

|

||||

|

||||

```python

|

||||

@classmethod

|

||||

def from_function(

|

||||

cls,

|

||||

fn: Callable,

|

||||

name: str | None = None,

|

||||

description: str | None = None,

|

||||

context_kwarg: str | None = None,

|

||||

) -> "Tool":

|

||||

"""Create a Tool from a function."""

|

||||

func_name = name or fn.__name__ # 获取函数名

|

||||

|

||||

if func_name == "<lambda>":

|

||||

raise ValueError("You must provide a name for lambda functions")

|

||||

|

||||

func_doc = description or fn.__doc__ or "" # 获取函数 docstring

|

||||

is_async = inspect.iscoroutinefunction(fn)

|

||||

|

||||

... # 更多请参考原始代码...

|

||||

```

|

||||

|

||||

总结: **模型是通过 prompt engineering,即提供所有工具的结构化描述和 few-shot 的 example 来确定该使用哪些工具**。另一方面,Anthropic 肯定对 Claude 做了专门的训练(毕竟是自家协议,Claude 更能理解工具的 prompt 以及输出结构化的 tool call json 代码)

|

||||

|

||||

### 5.2 工具执行与结果反馈机制

|

||||

|

||||

其实工具的执行就比较简单和直接了。承接上一步,我们把 system prompt(指令与工具调用描述)和用户消息一起发送给模型,然后接收模型的回复。当模型分析用户请求后,它会决定是否需要调用工具:

|

||||

|

||||

- **无需工具时**:模型直接生成自然语言回复。

|

||||

- **需要工具时**:模型输出结构化 JSON 格式的工具调用请求。

|

||||

|

||||

如果回复中包含结构化 JSON 格式的工具调用请求,则客户端会根据这个 json 代码执行对应的工具。具体的实现逻辑都在 `process_llm_response` 中, [代码](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk/blob/main/examples/clients/simple-chatbot/mcp_simple_chatbot/main.py%23L295-L338),逻辑非常简单。

|

||||

|

||||

如果模型执行了 tool call,则工具执行的结果 `result` 会和 system prompt 和用户消息一起 **重新发送** 给模型,请求模型生成最终回复。

|

||||

|

||||

如果 tool call 的 json 代码存在问题或者模型产生了幻觉怎么办呢?通过阅读 [代码](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk/blob/main/examples/clients/simple-chatbot/mcp_simple_chatbot/main.py%23L295-L338) 发现,我们会 skip 掉无效的调用请求。

|

||||

|

||||

执行相关的代码与注释如下:

|

||||

|

||||

```python

|

||||

... # 省略无关的代码

|

||||

async def start(self):

|

||||

... # 上面已经介绍过了,模型如何选择工具

|

||||

|

||||

while True:

|

||||

# 假设这里已经处理了用户消息输入。

|

||||

messages.append({"role": "user", "content": user_input})

|

||||

|

||||

# 获取 LLM 的输出

|

||||

llm_response = self.llm_client.get_response(messages)

|

||||

|

||||

# 处理 LLM 的输出(如果有 tool call 则执行对应的工具)

|

||||

result = await self.process_llm_response(llm_response)

|

||||

|

||||

# 如果 result 与 llm_response 不同,说明执行了 tool call(有额外信息了)

|

||||

# 则将 tool call 的结果重新发送给 LLM 进行处理。

|

||||

if result != llm_response:

|

||||

messages.append({"role": "assistant", "content": llm_response})

|

||||

messages.append({"role": "system", "content": result})

|

||||

|

||||

final_response = self.llm_client.get_response(messages)

|

||||

logging.info("\nFinal response: %s", final_response)

|

||||

messages.append(

|

||||

{"role": "assistant", "content": final_response}

|

||||

)

|

||||

# 否则代表没有执行 tool call,则直接将 LLM 的输出返回给用户。

|

||||

else:

|

||||

messages.append({"role": "assistant", "content": llm_response})

|

||||

```

|

||||

|

||||

结合这部分原理分析:

|

||||

|

||||

- 工具文档至关重要 \- 模型通过工具描述文本来理解和选择工具,因此精心编写工具的名称、docstring 和参数说明至关重要。

|

||||

- 由于 MCP 的选择是基于 prompt 的,所以任何模型其实都适配 MCP,只要你能提供对应的工具描述。但是当你使用非 Claude 模型时,MCP 使用的效果和体验难以保证(没有做专门的训练)。

|

||||

|

||||

## 6\. 总结

|

||||

|

||||

MCP (Model Context Protocol) 代表了 AI 与外部工具和数据交互的标准建立。通过本文,我们可以了解到:

|

||||

|

||||

1. **MCP 的本质**:它是一个统一的协议标准,使 AI 模型能够以一致的方式连接各种数据源和工具,类似于 AI 世界的"USB-C"接口。

|

||||

|

||||

2. **MCP 的价值**:它解决了传统 function call 的平台依赖问题,提供了更统一、开放、安全、灵活的工具调用机制,让用户和开发者都能从中受益。

|

||||

|

||||

3. **使用与开发**:对于普通用户,MCP 提供了丰富的现成工具, **用户可以在不了解任何技术细节的情况下使用**;对于开发者,MCP 提供了清晰的架构和 SDK,使工具开发变得相对简单。

|

||||

|

||||

MCP 还处于发展初期,但其潜力巨大。更重要的是生态吧,基于统一标准下构筑的生态也会正向的促进整个领域的发展。

|

||||

|

||||

以上内容已经覆盖了 MCP 的基本概念、价值和使用方法。对于技术实现感兴趣的读者,以下 **附录提供了一个简单的 MCP Server 开发实践**,帮助你更深入地理解 MCP 的工作原理。

|

||||

|

||||

## Appendix A:MCP Server 开发实践

|

||||

|

||||

`READ⏰: 30min`

|

||||

|

||||

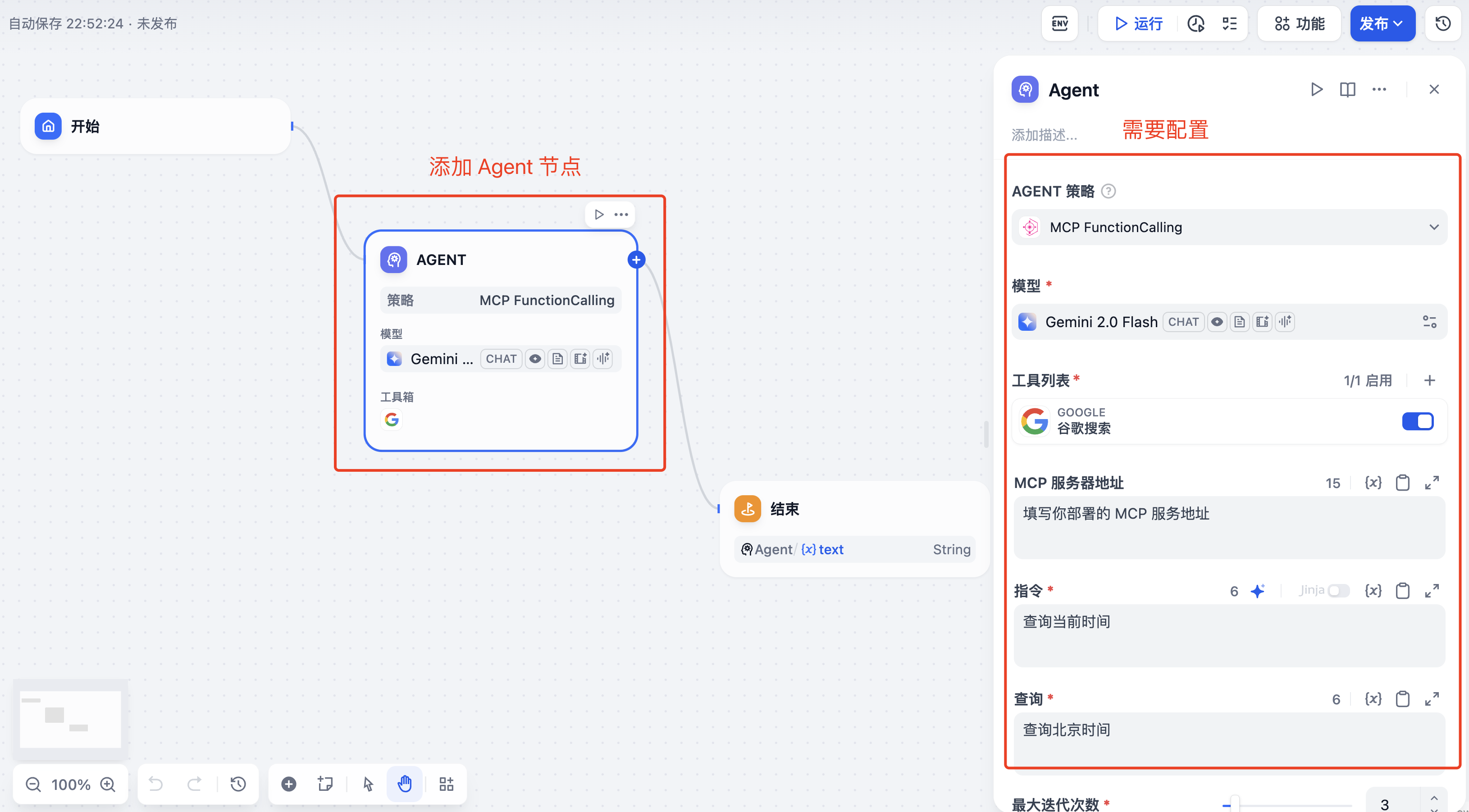

在了解 MCP 组件之后,很容易发现对绝大部分 AI 开发者来说,我们只需要关心 Server 的实现。因此,我这里准备通过一个最简单的示例来介绍如何实现一个 MCP Server。

|

||||

|

||||

MCP servers 可以提供三种主要类型的功能:

|

||||

|

||||

- Resources(资源):类似文件的数据,可以被客户端读取(如 API 响应或文件内容)

|

||||

- Tools(工具):可以被 LLM 调用的函数(需要用户批准)

|

||||

- Prompts(提示):预先编写的模板,帮助用户完成特定任务

|

||||

|

||||

本教程将主要关注工具(Tools)。

|

||||

|

||||

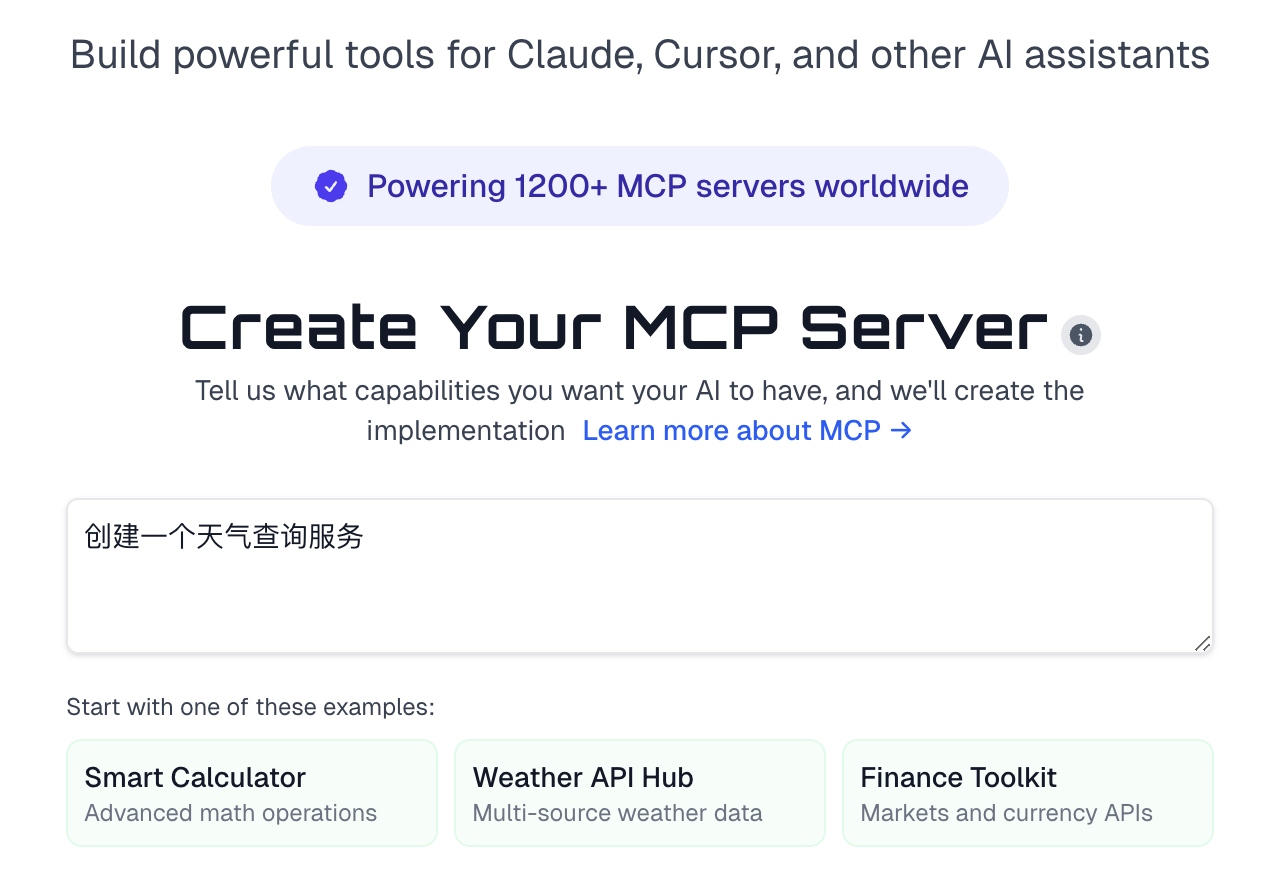

### A.I 使用 LLM 构建 MCP 的最佳实践

|

||||

|

||||

在开始之前,Anthropic 为我们提供了一个基于 LLM 的 MCP Server 的 [最佳开发实践](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/tutorials/building-mcp-with-llms),总结如下:

|

||||

|

||||

- 引入 domain knowledge(说人话就是,告诉他一些 MCP Server 开发的范例和资料)

|

||||

|

||||

- 访问 [https://modelcontextprotocol.io/llms-full.txt](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/llms-full.txt) 并复制完整的文档文本。(实测这个太长了,可以忽略)

|

||||

- 导航到 MCP [TypeScript SDK](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/typescript-sdk) 或 [Python SDK](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk) Github 项目中并复制相关内容。

|

||||

- 把这些作为 prompt 输入到你的 chat 对话中(作为 context)。

|

||||

|

||||

- 描述你的需求

|

||||

|

||||

- 你的服务器会开放哪些资源

|

||||

- 它会提供哪些工具

|

||||

- 它应该给出哪些引导或建议

|

||||

- 它需要跟哪些外部系统互动

|

||||

|

||||

给出一个 example prompt:

|

||||

|

||||

```text

|

||||

... (这里是已经引入的 domain knowledge)

|

||||

|

||||

打造一个 MCP 服务器,它能够:

|

||||

|

||||

- 连接到我公司的 PostgreSQL 数据库

|

||||

- 将表格结构作为资源开放出来

|

||||

- 提供运行只读 SQL 查询的工具

|

||||

- 包含常见数据分析任务的引导

|

||||

```

|

||||

|

||||

剩下的部分也很重要,但是偏重于方法论,实践性较弱,我这里就不展开了,推荐大家直接看 [官方文档](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/tutorials/building-mcp-with-llms)。

|

||||

|

||||

### A.II 手动实践

|

||||

|

||||

本节内容主要参考了官方文档: [Quick Start: For Server Developers](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/quickstart/server)。你可以选择直接跳过这部分内容或者进行一个速读。

|

||||

|

||||

这里我准备了一个简单的示例,使用 Python 实现一个 MCP Server,用来 **统计当前桌面上的 txt 文件数量和获取对应文件的名字**(你可以理解为一点用都没有,但是它足够简单,主要是为了难以配置环境的读者提供一个足够短的实践记录)。以下实践均运行在我的 MacOS 系统上。

|

||||

|

||||

**Step1. 前置工作**

|

||||

|

||||

- 安装 Claude Desktop。

|

||||

- Python 3.10+ 环境

|

||||

- [Python MCP SDK](https://zhida.zhihu.com/search?content_id=254822599&content_type=Article&match_order=1&q=Python+MCP+SDK&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDM4MzQwMDIsInEiOiJQeXRob24gTUNQIFNESyIsInpoaWRhX3NvdXJjZSI6ImVudGl0eSIsImNvbnRlbnRfaWQiOjI1NDgyMjU5OSwiY29udGVudF90eXBlIjoiQXJ0aWNsZSIsIm1hdGNoX29yZGVyIjoxLCJ6ZF90b2tlbiI6bnVsbH0.1c42YmabWtcjJAfTjF4cGX2Bsp0Qbkl6Pjc7V22BSJ0&zhida_source=entity) 1.2.0+

|

||||

|

||||

**Step2. 环境配置**

|

||||

|

||||

由于我使用的是官方推荐的配置:

|

||||

|

||||

```text

|

||||

# 安装 uv

|

||||

curl -LsSf https://astral.sh/uv/install.sh | sh

|

||||

|

||||

# 创建项目目录

|

||||

uv init txt_counter

|

||||

cd txt_counter

|

||||

|

||||

# 设置 Python 3.10+ 环境

|

||||

echo "3.11" > .python-version

|

||||

|

||||

# 创建虚拟环境并激活

|

||||

uv venv

|

||||

source .venv/bin/activate

|

||||

|

||||

# Install dependencies

|

||||

uv add "mcp[cli]" httpx

|

||||

|

||||

# Create our server file

|

||||

touch txt_counter.py

|

||||

```

|

||||

|

||||

> **Question**: 什么是 `uv` 呢和 `conda` 比有什么区别?

|

||||

>

|

||||

> **Answer**: 一个用 Rust 编写的超快速 (100x) Python 包管理器和环境管理工具,由 Astral 开发。定位为 pip 和 venv 的替代品,专注于速度、简单性和现代 Python 工作流。

|

||||

|

||||

**Step3. 构造一个 prompt**

|

||||

|

||||

```text

|

||||

"""

|

||||

... (这里是已经引入的 domain knowledge)

|

||||

"""

|

||||

|

||||

打造一个 MCP 服务器,它能够:

|

||||

- 功能:

|

||||

- 统计当前桌面上的 txt 文件数量

|

||||

- 获取对应文件的名字

|

||||

|

||||

要求:

|

||||

- 不需要给出 prompt 和 resource 相关代码。

|

||||

- 你可以假设我的桌面路径为 /Users/{username}/Desktop

|

||||

```

|

||||

|

||||

- Domain Knowledge 复制于 MCP Python SDK 的 [README 文件](https://link.zhihu.com/?target=https%3A//raw.githubusercontent.com/modelcontextprotocol/python-sdk/refs/heads/main/README.md)

|

||||

|

||||

**Step4. 实现 MCP Server**

|

||||

|

||||

以下代码由 Claude 3.7 直接生成。当然,这主要是因为我的需求足够简单,当你需要实现一个复杂的 MCP Server 时,你可能需要多步的引导和 Debug 才能得到最终的代码。

|

||||

|

||||

```python

|

||||

import os

|

||||

from pathlib import Path

|

||||

from mcp.server.fastmcp import FastMCP

|

||||

|

||||

# 创建 MCP Server

|

||||

mcp = FastMCP("桌面 TXT 文件统计器")

|

||||

|

||||

@mcp.tool()

|

||||

def count_desktop_txt_files() -> int:

|

||||

"""Count the number of .txt files on the desktop."""

|

||||

# Get the desktop path

|

||||

username = os.getenv("USER") or os.getenv("USERNAME")

|

||||

desktop_path = Path(f"/Users/{username}/Desktop")

|

||||

|

||||

# Count .txt files

|

||||

txt_files = list(desktop_path.glob("*.txt"))

|

||||

return len(txt_files)

|

||||

|

||||

@mcp.tool()

|

||||

def list_desktop_txt_files() -> str:

|

||||

"""Get a list of all .txt filenames on the desktop."""

|

||||

# Get the desktop path

|

||||

username = os.getenv("USER") or os.getenv("USERNAME")

|

||||

desktop_path = Path(f"/Users/{username}/Desktop")

|

||||

|

||||

# Get all .txt files

|

||||

txt_files = list(desktop_path.glob("*.txt"))

|

||||

|

||||

# Return the filenames

|

||||

if not txt_files:

|

||||

return "No .txt files found on desktop."

|

||||

|

||||

# Format the list of filenames

|

||||

file_list = "\n".join([f"- {file.name}" for file in txt_files])

|

||||

return f"Found {len(txt_files)} .txt files on desktop:\n{file_list}"

|

||||

|

||||

if __name__ == "__main__":

|

||||

# Initialize and run the server

|

||||

mcp.run()

|

||||

```

|

||||

|

||||

任务非常简单,只需要调用非常基本的 `os` 就可以完成。

|

||||

|

||||

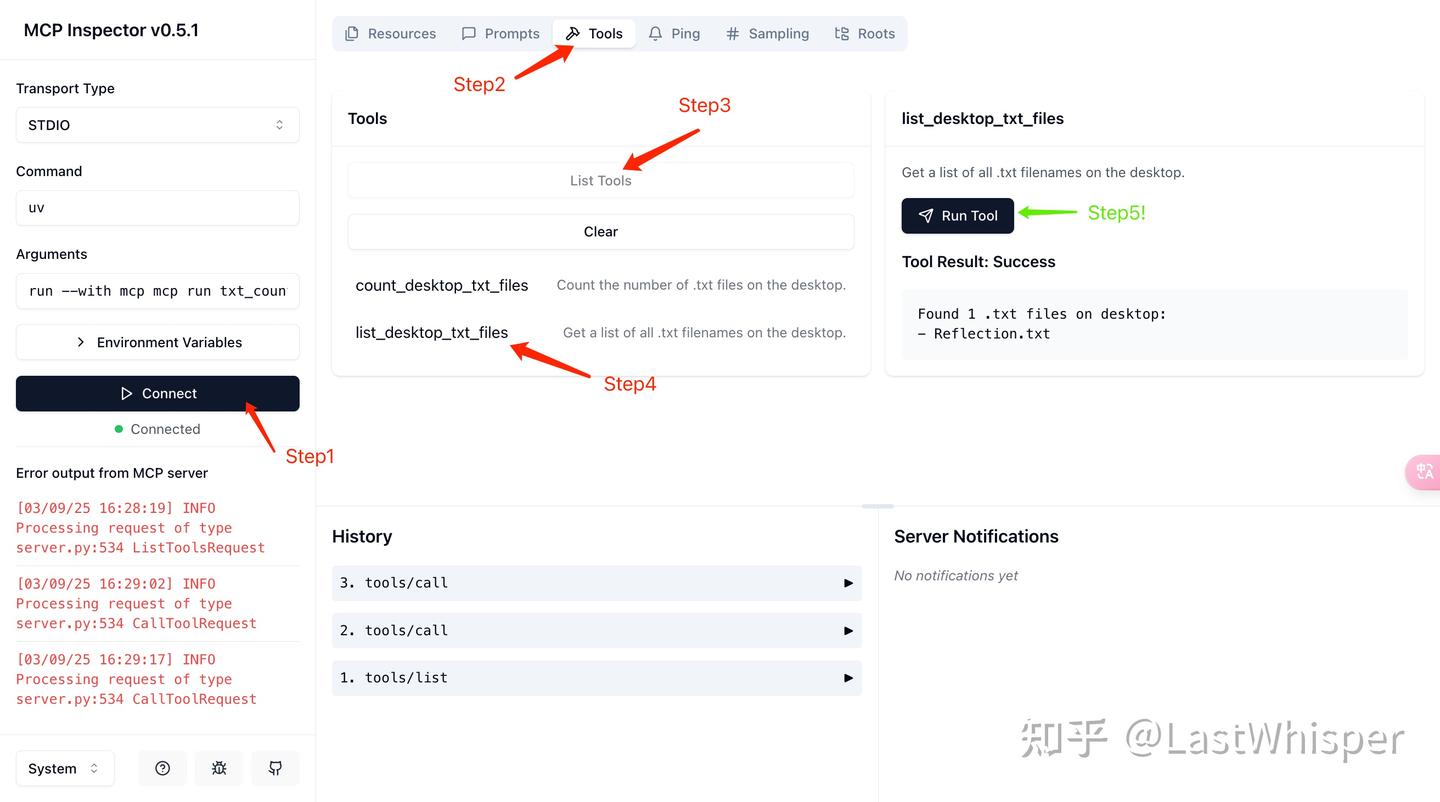

**Step5. 测试 MCP Server**

|

||||

|

||||

(官方没有这一步,但是我非常推荐大家这么做)

|

||||

|

||||

```text

|

||||

$ mcp dev txt_counter.py

|

||||

Starting MCP inspector...

|

||||

Proxy server listening on port 3000

|

||||

|

||||

MCP Inspector is up and running at http://localhost:5173

|

||||

```

|

||||

|

||||

之后进入到给出的链接中,你大概能按下图进行操作:

|

||||

|

||||

|

||||

|

||||

如果成功,你应该能像我一样看到对应的输出( `Tool Result`)~

|

||||

|

||||

**Step6. 接入 Claude**

|

||||

|

||||

最后一步就是把我们写好的 MCP 接入到 Claude Desktop 中。流程如下:

|

||||

|

||||

```text

|

||||

# 打开 claude_desktop_config.json (MacOS / Linux)

|

||||

# 如果你用的是 cursor 或者 vim 请更换对应的命令

|

||||

code ~/Library/Application\ Support/Claude/claude_desktop_config.json

|

||||

```

|

||||

|

||||

在配置文件中添加以下内容,记得替换 `/Users/{username}` 为你的实际用户名,以及其他路径为你的实际路径。

|

||||

|

||||

```json

|

||||

{

|

||||

"mcpServers": {

|

||||

"txt_counter": {

|

||||

"command": "/Users/{username}/.local/bin/uv",

|

||||

"args": [\

|

||||

"--directory",\

|

||||

"/Users/{username}/work/mcp-learn/code-example-txt", // 你的项目路径(这里是我的)\

|

||||

"run",\

|

||||

"txt_counter.py" // 你的 MCP Server 文件名\

|

||||

]

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

- `uv` 最好是绝对路径,推荐使用 `which uv` 获取。

|

||||

|

||||

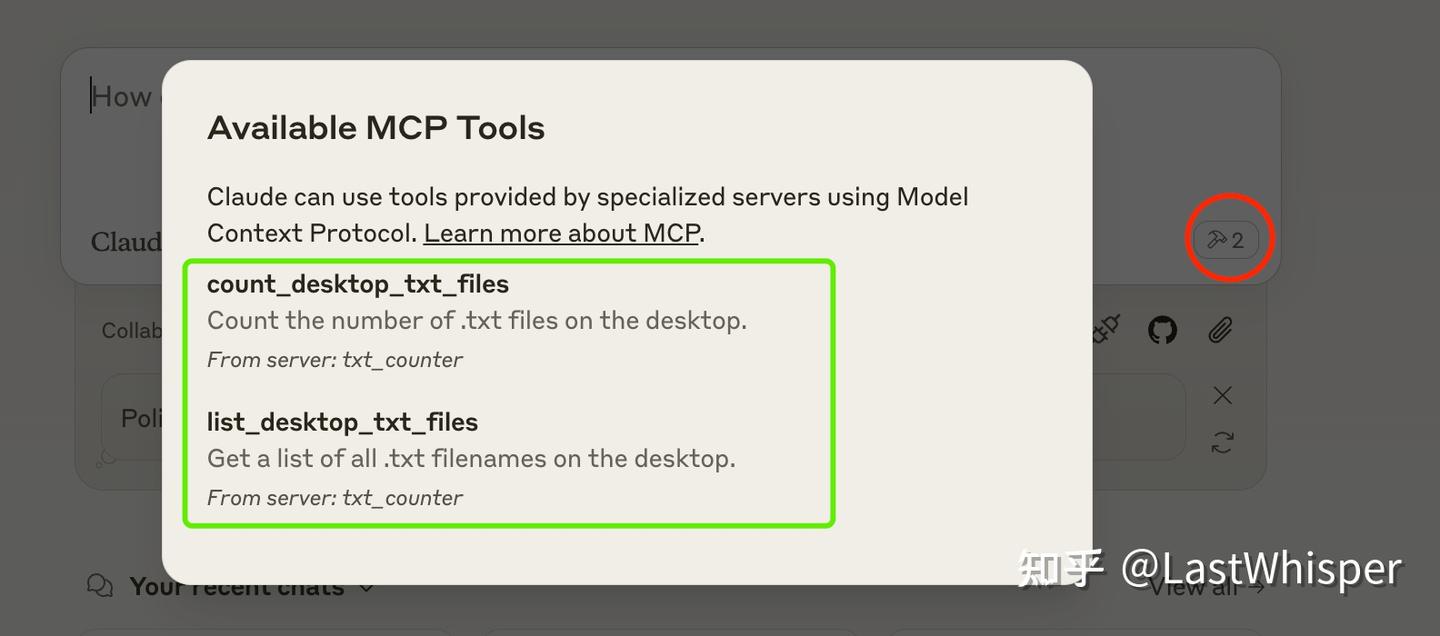

配置好后重启 Claude Desktop,如果没问题就能看到对应的 MCP Server 了。

|

||||

|

||||

|

||||

|

||||

**Step7. 实际使用**

|

||||

|

||||

接下来,我们通过一个简单的 prompt 进行实际测试:

|

||||

|

||||

```text

|

||||

能推测我当前桌面上 txt 文件名的含义吗?

|

||||

```

|

||||

|

||||

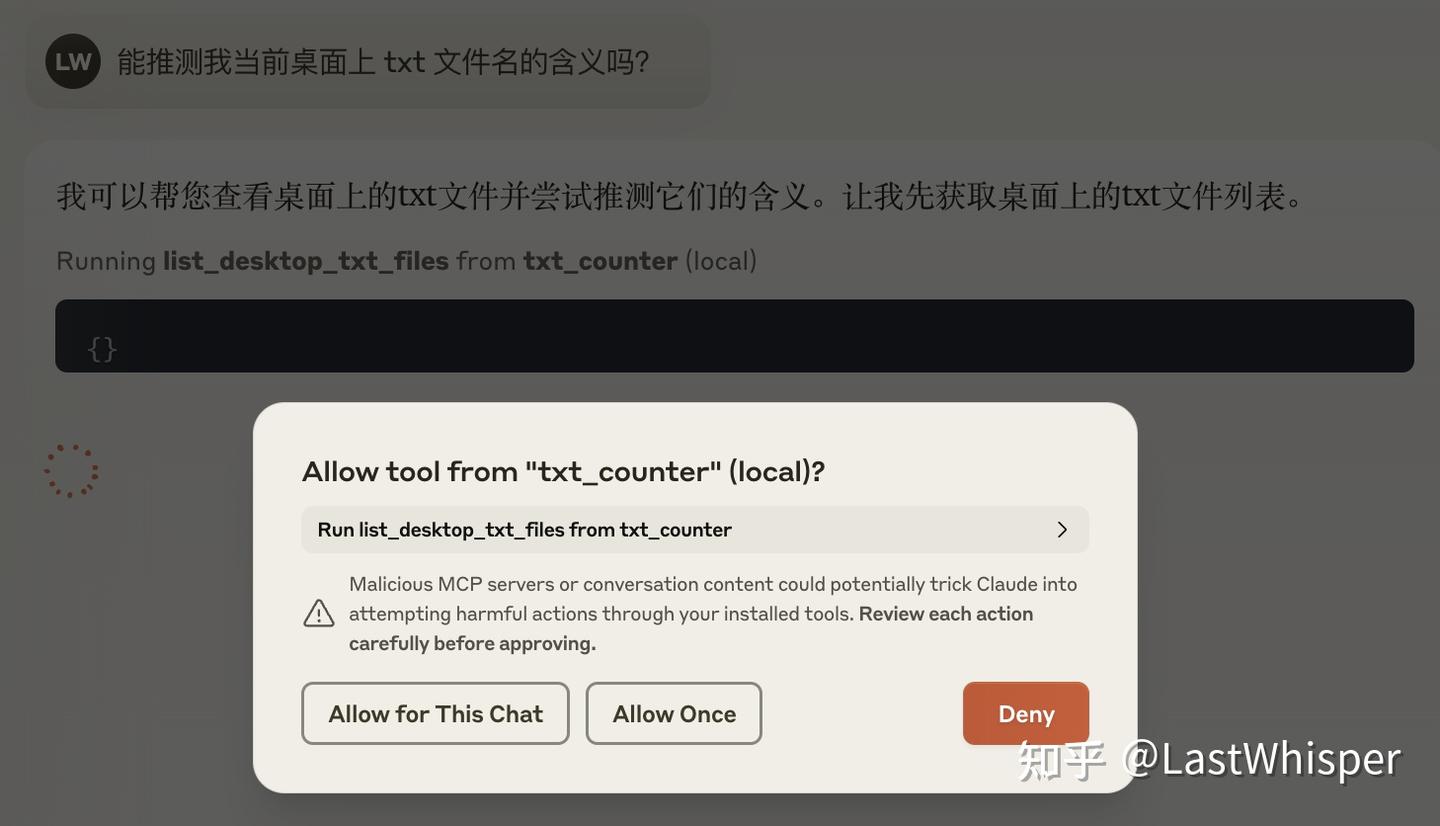

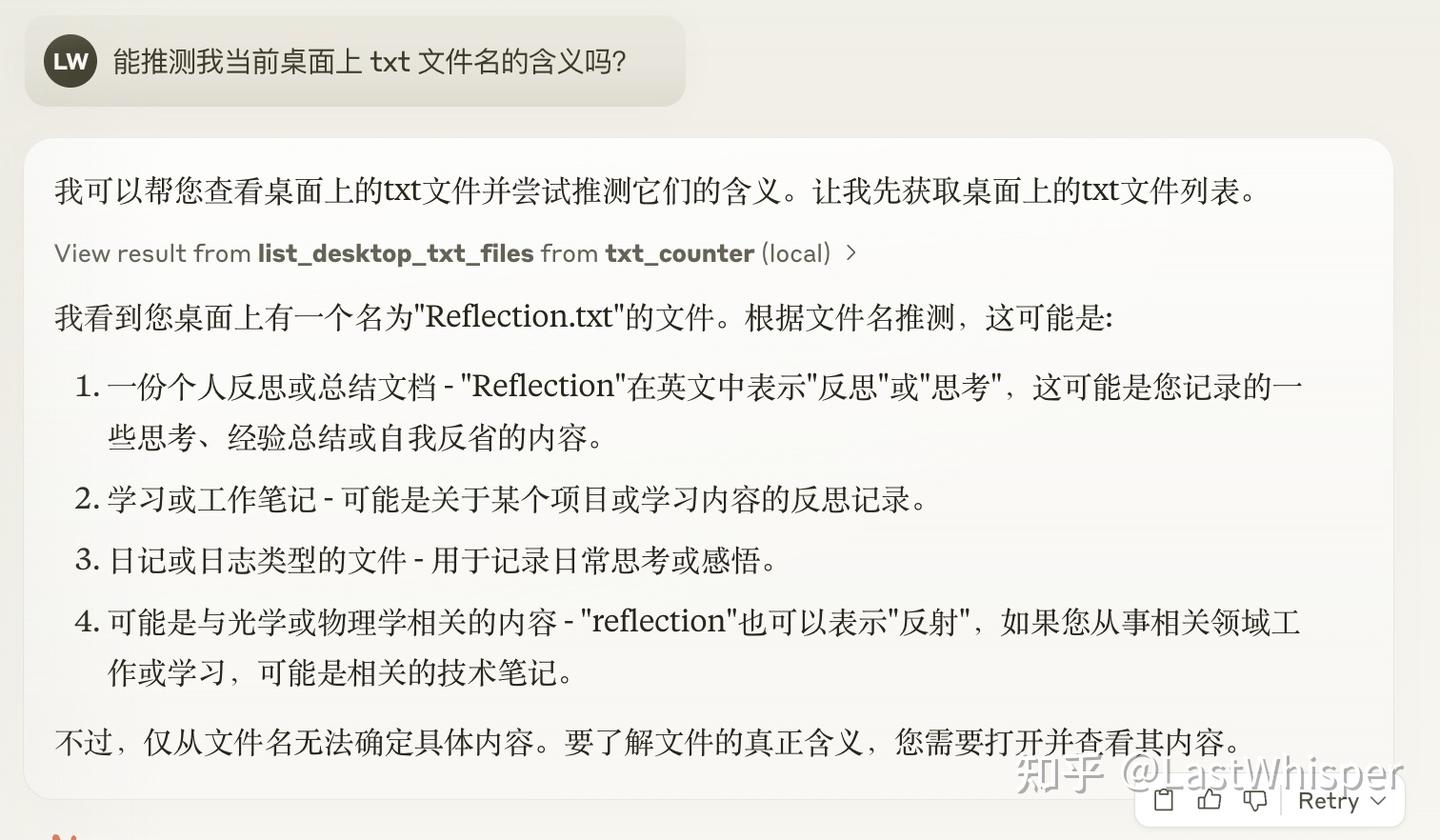

它可能会请求你的使用权限,如图一所示,你可以点击 `Allow for This Chat`

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

看起来我们 MCP Server 已经正常工作了!

|

||||

|

||||

### A.III MCP Server Debug

|

||||

|

||||

Debug 是一个非常复杂的话题,这里直接推荐官方的教程:

|

||||

|

||||

- [Official Tutorial: Debugging](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/docs/tools/debugging)

|

||||

- [Official Tutorial: Inspector](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/docs/tools/inspector)

|

||||

|

||||

## Reference

|

||||

|

||||

- [MCP Official Docs](https://link.zhihu.com/?target=https%3A//modelcontextprotocol.io/)

|

||||

- [MCP Python SDK](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/python-sdk)

|

||||

- [MCP Available Server](https://link.zhihu.com/?target=https%3A//github.com/modelcontextprotocol/servers)

|

||||

- [Blog: What is Model Context Protocol? (MCP) Architecture Overview](https://link.zhihu.com/?target=https%3A//medium.com/%40tahirbalarabe2/what-is-model-context-protocol-mcp-architecture-overview-c75f20ba4498)

|

||||

- [Blog: LLM Function-Calling vs. Model Context Protocol (MCP)](https://link.zhihu.com/?target=https%3A//www.gentoro.com/blog/function-calling-vs-model-context-protocol-mcp)

|

||||

|

||||

> 来源:知乎

|

||||

@@ -0,0 +1,213 @@

|

||||

# 刚刚,GPT-4o 原生图像生成上线,P 图、生图也就一嘴的事

|

||||

|

||||

就在 DeepSeek V3「小版本更新」,阿里通义千问团队开源了新模型后,OpenAI 深夜也悄悄搞事情。

|

||||

|

||||

毫无预告地,OpenAI 推出 GPT-4o 原生图像生成。效果让人惊叹不已。更妙的是,即使免费用户也可使用。

|

||||

|

||||

|

||||

|

||||

先来体验一下:

|

||||

|

||||

|

||||

|

||||

在生成结果中可以看到,GPT-4o 在执行任务时首先会对我们的原始提示词进行优化,编写一个更加详细的英文版提示词:

|

||||

|

||||

|

||||

|

||||

在 OpenAI 看来,图像生成应该是语言模型的核心能力之一。因此他们将最先进的图像生成器 4o 集成到了 GPT-4o 中。

|

||||

|

||||

2024 年 5 月,OpenAI 发布其首个全能多模态模型 GPT-4o,与 ChatGPT 之前采用的生成式 AI 图像模型(OpenAI 的 DALL-E 3)不同 —— 这个经典的 diffusion transformer 通过去除像素噪声来根据文本提示重建图像 —— 新的图像生成器被整合到了同一个多模态模型中。OpenAI 对整个模型进行了统一训练,使其能够同时理解文本、代码和图像等多种形式。

|

||||

|

||||

GPT-4o 的图像生成能力具有以下突出优势:它能精准呈现文字内容,严格遵循指令要求,并充分调用 4o 内置知识库和对话上下文 —— 包括对上传图像进行转化处理或将其作为视觉灵感来源。这些特性让用户能更轻松地创造出与构想完全一致的图像,通过视觉表达实现更高效的沟通,从而将图像生成技术升级为兼具精确性与实用性的强大工具。

|

||||

|

||||

效果如何,我们接着往下看。

|

||||

|

||||

有用且美丽的图像生成

|

||||

|

||||

OpenAI 基于在线图像和文本对模型进行了训练,这不仅让模型学习了图像与语言之间的关系,还学习了图像之间的相互关系。结合后训练,最终的模型具有令人惊讶的视觉流畅性,能够生成有用、一致且具有上下文感知能力的图像。

|

||||

|

||||

文本渲染

|

||||

|

||||

一图胜千言,但有时在恰当位置生成几个字就能升华图像意境。4o 将精准符号与视觉元素完美融合的能力,使图像生成进阶为真正的视觉传达工具。

|

||||

|

||||

提示:「创建一张逼真的照片,内容是两名 20 多岁的女巫(一名是灰白色挑染发型,另一名是长卷的红褐色头发)正在阅读一个街标。

|

||||

|

||||

背景:纽约威廉斯堡一条普通的城市街道,一根电线杆上完全被许多详细的街标覆盖(例如,街道清扫时间、需要停车许可证、车辆分类、拖车规则),包括中间的几个荒谬的标志:Broom Parking for Witches Not Permitted in Zone C,Magic Carpet Loading and Unloading Only (15-Minute Limit) 等等。

|

||||

|

||||

人物:一名女巫拿着一把扫帚,另一名女巫拿着一个卷起的魔法地毯。她们在前景中,身体微微背向相机,头部微微倾斜,仔细查看标志。

|

||||

|

||||

从背景到前景的构图:街道 \+ 停放的汽车 \+ 建筑物 → 街标 → 女巫。人物必须是离拍摄相机最近的。」

|

||||

|

||||

这就是生成一张图片的部分提示词,提示词描述的可谓非常详细。GPT-4o 不但严格遵循指令,还将提示语中的文本字符也准确的表达出来了。

|

||||

|

||||

|

||||

|

||||

GPT-4o 生成的菜单,不知道的还以为这是一张真实菜单。

|

||||

|

||||

提示:「我在 Marin 开设了一家名为 Haein 的传统概念餐厅,主打采用有机农场新鲜食材烹制的韩式料理,并根据时令供应轮换菜单。请您设计一份菜单图片,需包含以下菜品 —— 整体风格要兼顾传统 / 乡村韵味与高端精致感。请为每道菜品配上优雅的彼得兔风格的插画,确保所有文字正确呈现,并使用白色背景。

|

||||

|

||||

顶部:大酱汤(发酵大豆炖菜) \- 18 美元

|

||||

|

||||

大酱汤是用当地的蘑菇、豆腐和时令蔬菜做成的,配上米饭……

|

||||

|

||||

底部:时令米酒 —— 每杯 12 美元」

|

||||

|

||||

|

||||

|

||||

持续生成

|

||||

|

||||

由于图像生成功能现已深度集成于 GPT-4o 系统,用户可通过自然对话实现图像优化。GPT-4o 能基于聊天上下文中的图文内容持续创作,确保输出结果的一致性。例如在设计游戏角色时,当你反复调整和测试方案,该角色的外观特征将在多次迭代中保持高度协调。

|

||||

|

||||

举例来说,当你输入一张猫咪的图片,然后给出提示「给这只猫一顶侦探帽和一副单片眼镜」,GPT-4o 就能在保持原始图片的情况下,遵循指令重新生成一张。

|

||||

|

||||

你还可以继续修改图片,只要给点提示就可以了,例如给定提示「将这个场景制作成一款 AAA 级的 4K 游戏引擎打造的视频游戏,并添加一个神秘角色扮演游戏的用户界面作为覆盖层。在游戏中,我们可以在顶部看到生命值条和小地图,底部则显示法术图标,整体界面风格保持一致且具有标志性。」对话过程一张精美的图片就生成了。

|

||||

|

||||

|

||||

|

||||

除了图像作为输入,你也可以从提示入手,例如要求 GPT-4o 生成一张「奢华蛋壳纹理卡片上的诗歌」,然后把诗歌内容也附加上,就能出现如下的效果图,你也可以进一步修改,输入提示就可以了。

|

||||

|

||||

|

||||

|

||||

指令遵循

|

||||

|

||||

GPT-4o 的图像生成能够细致入微地遵循详细的提示,注重细节。其他系统在处理大约 5 到 8 个对象时可能会遇到困难,而 GPT-4o 能够处理多达 10 到 20 个不同的对象。对象与其特征和关系的更紧密绑定,使得控制更加精准。

|

||||

|

||||

提示:「一张正方形图片,包含一个 4 行 4 列的网格,共有 16 个物体,背景为白色。从左到右、从上到下依次排列如下:

|

||||

|

||||

一颗蓝色的星星

|

||||

|

||||

一个红色的三角形

|

||||

|

||||

一个绿色的正方形

|

||||

|

||||

一个粉色的圆形

|

||||

|

||||

一个橙色的沙漏

|

||||

|

||||

一个紫色的无穷大符号

|

||||

|

||||

一个黑白波点图案的领结

|

||||

|

||||

一个扎染风格的 42 字样

|

||||

|

||||

……

|

||||

|

||||

用草书写成的 OpenAI 字样

|

||||

|

||||

一道彩虹色的闪电」

|

||||

|

||||

|

||||

|

||||

空旷的城市,提示:下午的纽约时代广场,没有人,没有车辆,也没有发光的广告牌。

|

||||

|

||||

|

||||

|

||||

转化数学公式:

|

||||

|

||||

|

||||

|

||||

上下文学习

|

||||

|

||||

GPT-4o 能够分析并学习用户上传的图像,将图像的细节无缝整合到上下文中,以指导图像生成。

|

||||

|

||||

当你输入几张图像,然后给出提示:用这些图像作为参考,画一个三角形车轮的车辆设计。

|

||||

|

||||

标出前轮,后轮,并在图的下方给出文字(用小大写)

|

||||

|

||||

「TRIANGLE WHEELED VEHICLE. English Patent. 2025. OPENAI」

|

||||

|

||||

|

||||

|

||||

提示:蓝色电锯逼真图像。

|

||||

|

||||

然后再给出提示:为这个电锯做个广告,一个奶奶在感恩节餐桌上切火鸡。并添加标签行。

|

||||

|

||||

|

||||

|

||||

世界知识

|

||||

|

||||

原生图像生成使 4o 能够将文本和图像之间的知识联系起来,从而形成一个感觉更智能、更高效的模型。

|

||||

|

||||

|

||||

|

||||

提示:制作一个视觉信息图表,描述为什么旧金山如此多雾。

|

||||

|

||||

简单的一句提示,4o 就把影响环境质量的原因用图片的形式描述出来了。看来,4o 掌握的知识还是很丰富的。

|

||||

|

||||

|

||||

|

||||

要求 4o 制作一幅关于如何制作抹茶的彩色图解,也没有问题。

|

||||

|

||||

|

||||

|

||||

风格

|

||||

|

||||

在反映丰富多样图像风格的图像上进行训练,使模型能够令人信服地创建或转换图像。

|

||||

|

||||

提示:一只猫望着街上的水坑,但它的倒影是一只老虎,而且两种倒影都被水中的涟漪真实地扭曲了。

|

||||

|

||||

|

||||

|

||||

提示:创建一张超逼真的照片,内容是这四只动物在公园的野餐毯上玩扑克,画面拉远,呈现全景,照片风格逼真。一只长毛虎斑猫正拿着一手牌……

|

||||

|

||||

|

||||

|

||||

局限性

|

||||

|

||||

OpenAI 没有避讳自身模型的局限性。他们指出:「我们的模型并不完美。我们目前已经看到了其存在多种限制,我们将在首次发布后通过模型改进来解决这些限制。」具体来说,OpenAI 罗列出的限制包括:

|

||||

|

||||

- 裁剪:GPT-4o 有时会错误地裁剪较长的图像(如海报),尤其是靠近底部的部分。

|

||||

|

||||

- 幻觉:与其他文本模型一样,图像生成模型也可以编造信息,尤其是在上下文提示较少时。

|

||||

|

||||

- 高结合问题:当生成图像需要依赖于其知识库时,它可能难以同时准确地呈现 10-20 多个不同的概念,例如完整的元素周期表。

|

||||

|

||||

- 精确绘图:模型可能在绘制涉及数据的图表时不准确。

|

||||

|

||||

- 多语言文本渲染:模型有时难以渲染非拉丁语言,并且字符可能不准确或产生幻觉,尤其是在更复杂的情况下。

|

||||

|

||||

- 编辑精度:当要求编辑图像生成的特定部分(例如拼写错误)时,结果并不总是有效,还可能出现在没有请求的情况下更改图像的其他部分或引入更多错误的情况。另一个错误是模型难以保持用户上传的人脸在编辑中的一致性,但 OpenAI 预计将在一周内修复该错误。

|

||||

|

||||

- 小文本信息密集:众所周知,当被要求以非常小的尺寸呈现详细信息时,模型会遇到困难。

|

||||

|

||||

|

||||

|

||||

安全性

|

||||

|

||||

OpenAI 也强调了自己在模型安全方面所做的工作。

|

||||

|

||||

按照 OpenAI 之前发布的 Model Spec(模型规范),他们的目标是「通过支持游戏开发、历史探索和教育等有价值的用例来最大限度地提高创作自由 —— 同时保持严格的安全标准。与此同时,阻止违反这些标准的请求仍然和以往一样重要。」以下是对其它风险领域的评估:

|

||||

|

||||

通过 C2PA 和内部可逆搜索给出出处

|

||||

|

||||

所有生成的图像都将自带 C2PA 元数据,即会被标记成来自 GPT‑4o 的图像。OpenAI 表示,这样做是为了提供透明性。并且他们宣布已经构建了一个内部搜索工具,可利用生成结果的技术属性来帮助验证某个内容是否出自他们的模型。

|

||||

|

||||

阻止不良内容

|

||||

|

||||

OpenAI 表示将继续阻止可能违反其内容政策的生成图像请求。他们表示,当真人图像处于上下文中时,会加强对可以创建的图像类型的限制。

|

||||

|

||||

「与任何发布一样,安全性永不止步,而是一个持续的投资领域。随着我们更多地了解该模型在现实世界中的使用情况,我们将相应地调整我们的政策。」

|

||||

|

||||

使用推理来增强安全性

|

||||

|

||||

与审议性对齐(deliberative alignment)类似,OpenAI 表示已经训练了一个可以直接根据人工编写的可解释安全规范工作的推理 LLM。

|

||||

|

||||

「我们在开发过程中使用了这个推理 LLM 来帮助我们识别和解决我们政策中的歧义。结合我们为 ChatGPT 和 Sora 开发的多模态技术进步和现有的安全技术,这能让我们根据我们的政策来调节输入文本和输出图像。」

|

||||

|

||||

有关安全性的更多论述和研究结果请访问 OpenAI 同步发布的 GPT-4o 系统卡附录。

|

||||

|

||||

|

||||

|

||||

附录地址:https://cdn.openai.com/11998be9-5319-4302-bfbf-1167e093f1fb/Native\_Image\_Generation\_System\_Card.pdf

|

||||

|

||||

哪些用户可以使用?

|

||||

|

||||

OpenAI 表示,从今天开始,4o 图像生成能力将向 Plus、Pro、Team 和免费用户推出,作为 ChatGPT 中的默认图像生成器,企业版和教育版用户还需等待一段时间。它也可以在 Sora 中使用。对于那些 DALL・E 在其心中占有特殊地位的人来说,仍然可以通过一个专门的 DALL・E GPT 访问它。

|

||||

|

||||

API 用户呢?OpenAI 表示也快了:访问权限将在未来几周内推出。

|

||||

|

||||

最后,OpenAI 表示:「使用 GPT-4o,创建和定制图像就像天一样简单 —— 只需描述你需要什么,包括任何细节,如宽高比、使用十六进制代码的精确颜色或透明背景。」不过,OpenAI 也指出,由于此模型能生成更详细的图像,因此图像渲染时间更长,通常长达一分钟。

|

||||

|

||||

参考链接:https://openai.com/index/introducing-4o-image-generation/

|

||||

|

||||

> 海量资讯、精准解读,尽在新浪财经 APP

|

||||

@@ -0,0 +1,338 @@

|

||||

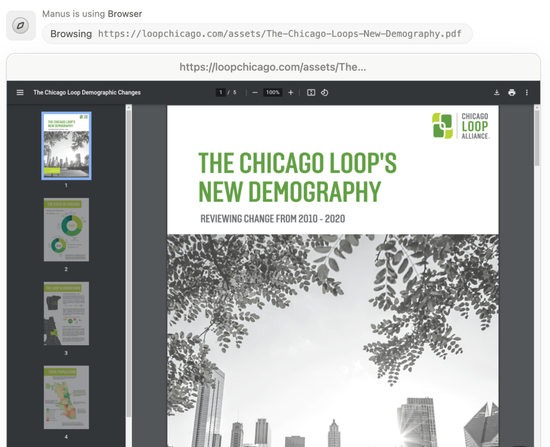

# 实测 Manus:首个真干活 AI,中国造(附 50 个用例 + 拆解)

|

||||

|

||||

本以为 DeepSeek 已是天下无敌,没想到有人比他还猛...

|

||||

|

||||

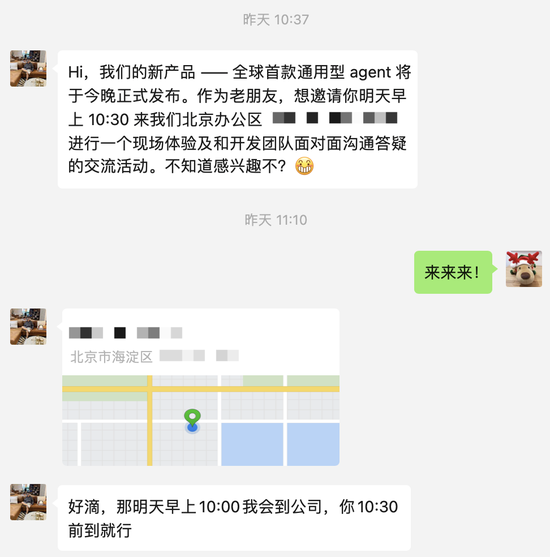

这个产品是 Manus,全球首款通用型 Agent,中国制造,昨夜上线,今早发布。

|

||||

|

||||

地址是:https://manus.im/

|

||||

|

||||

目前还在内测,可在登录后,申请加入内测

|

||||

|

||||

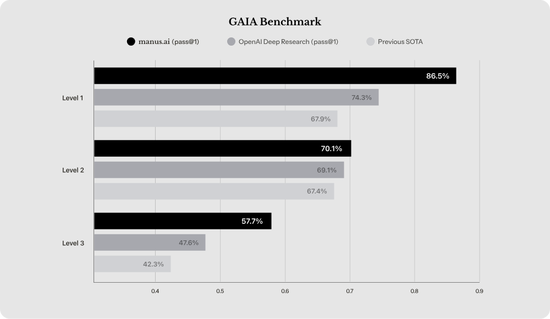

这东西,在 GAIA 基准测试中远远甩开了 OpenAI。

|

||||

|

||||

|

||||

|

||||

Peak,作为 Manus 的首席科学家,放送了原声。

|

||||

|

||||

Manus 的产品名,意思为“手”,来自拉丁文“mens et manus” —— 知行合一。它体现了一种理念:知识和智慧必须通过身体力行才能对世界产生正向影响。这就是 Manus 的追求,为 LLM 做一双能巧妙调用工具的手,从而扩展人的能力,让你心中的愿景成为现实。

|

||||

|

||||

之前知道他们在“整个大活”,一直充满期待。

|

||||

|

||||

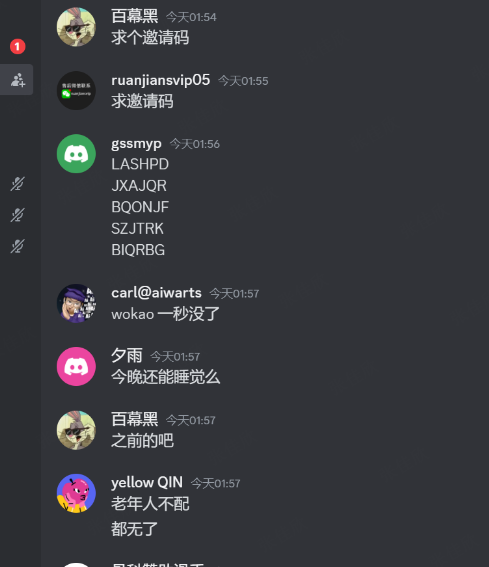

没想到,直接整了个刷爆全网的:真叫一个一码难求

|

||||

|

||||

|

||||

|

||||

我先放几个例子,这些来自于官方

|

||||

|

||||

提示词:

|

||||

|

||||

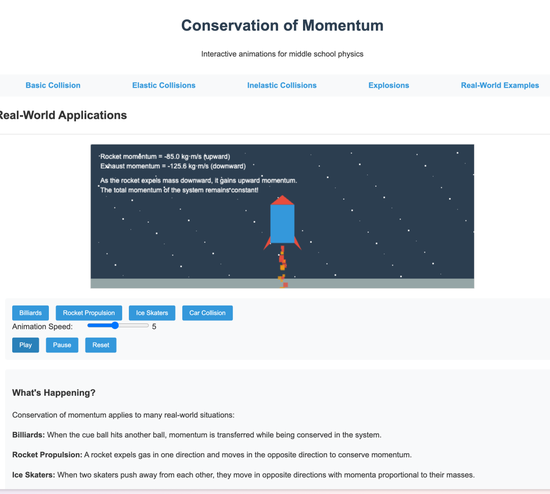

我是一名中学物理老师,正准备教授动量守恒定律。您能否创建一系列清晰准确的演示动画,并将它们整理成一个简单的 HTML 演示文稿?

|

||||

|

||||

https://manus.im/share/pAdLIvlktJmV945593mFio

|

||||

|

||||

提示词:

|

||||

|

||||

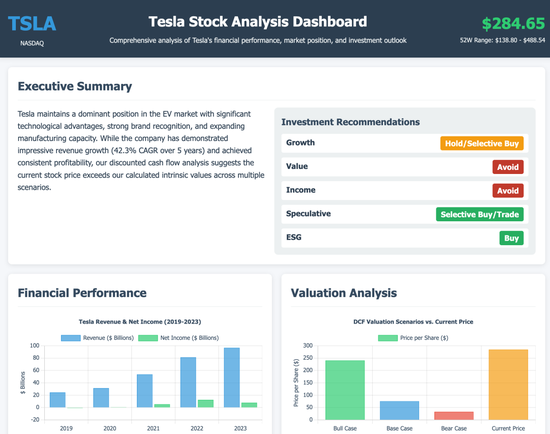

我想要一份特斯拉股票的全面分析,包括:概述:公司概况、关键指标、业绩数据和投资建议财务数据:收入趋势、利润率、资产负债表和现金流分析市场情绪:分析师评级、情绪指标和新闻影响技术分析:价格趋势、技术指标和支撑/阻力水平资产比较:市场份额和与主要竞争对手的财务指标对比价值投资者:内在价值、增长潜力和风险因素投资论点:SWOT 分析和针对不同类型投资者的建议

|

||||

|

||||

https://manus.im/share/xFgpHb15vKqfRPWIs3JJPJ?replay=1

|

||||

|

||||

提示词:

|

||||

|

||||

我需要一个 4 月 15-23 日从西雅图出发的 7 天日本行程,预算为我和未婚妻两人 2500-5000 美元。我们喜欢历史遗迹、隐藏的宝地和日本文化(剑道、茶道、禅修)。我们想看奈良的鹿并徒步探索城市。我计划在这次旅行中求婚,需要一个特别场所的建议。请提供详细的行程安排和一个简单的 HTML 旅行手册,包含地图、景点描述、必备的日语短语和我们整个旅程中可以参考的旅行小贴士。

|

||||

|

||||

https://manus.im/share/brWKUSp51ItvVMBpcXNCZ1?replay=1

|

||||

|

||||

Manues 的创始团队,是很久的朋友了,各个顶呱呱。

|

||||

|

||||

上线前给留了个码,让我能来测测这一产品。

|

||||

|

||||

顺道着,摸了点独家消息。

|

||||

|

||||

|

||||

|

||||

我先随便跑了个...非常离谱的任务:

|

||||

|

||||

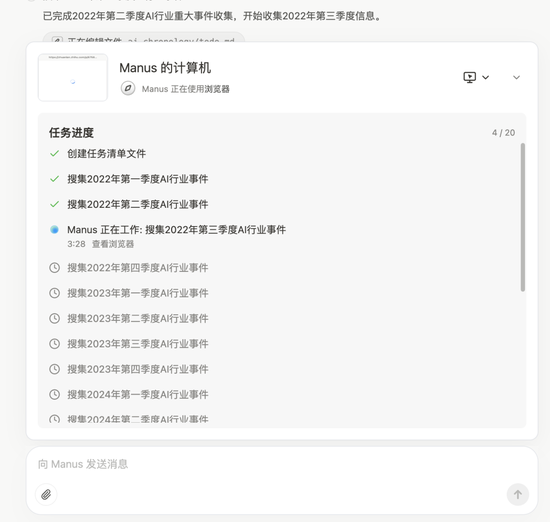

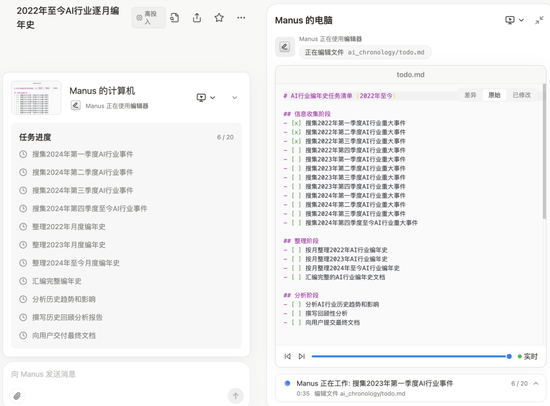

帮我整理一份逐月编年史,纪录从 2022 年到现在,AI 行业每个月都发生了哪些事情。整理完之后,再从现在的视角回顾下这段历史

|

||||

|

||||

然后...迎来了我的一声声“卧槽“,首先..他清晰的去规划任务

|

||||

|

||||

|

||||

|

||||

然后,开着浏览器导出去吧啦信息...

|

||||

|

||||

|

||||

|

||||

还会不断的回顾矫正。。。

|

||||

|

||||

|

||||

|

||||

没错,是我想要的 Agent 了!

|

||||

|

||||

(不过这个 case 实在太大了,跑了几个小时还没跑完)

|

||||

|

||||

同时的,我去跑了另一个 Case:写个游戏

|

||||

|

||||

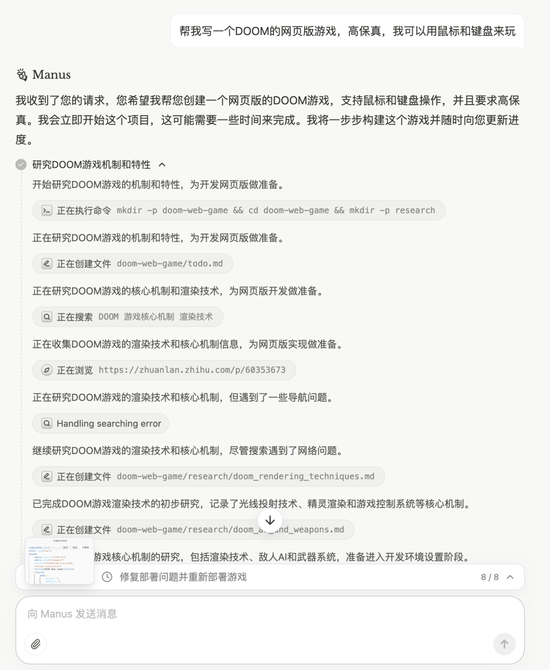

帮我写一个 DOOM 的网页版游戏,高保真,我可以用鼠标和键盘来玩

|

||||

|

||||

这里补充说一下:《Doom》(《毁灭战士》)是由 id Software 开发并于 1993 年 发行的里程碑式第一人称射击游戏(FPS)。它不仅是电子游戏历史上的经典之作,更被认为是现代 FPS 类型的奠基者之一。

|

||||

|

||||

在我把需求给到 Manus 之后,就看着他一阵捣鼓。

|

||||

|

||||

|

||||

|

||||

而最终呢,不但完成了任务,甚至帮我部署好了

|

||||

|

||||

https://etuswgwm.manus.space/

|

||||

|

||||

顺道还给我留了个手册

|

||||

|

||||

|

||||

|

||||

当然了,这里还有茫茫多的 case,来自官方

|

||||

|

||||

Manus 通过资料研究、数据分析捕捉了过去四个季度市场对 Amazon 的情绪变化。

|

||||

|

||||

|

||||

|

||||

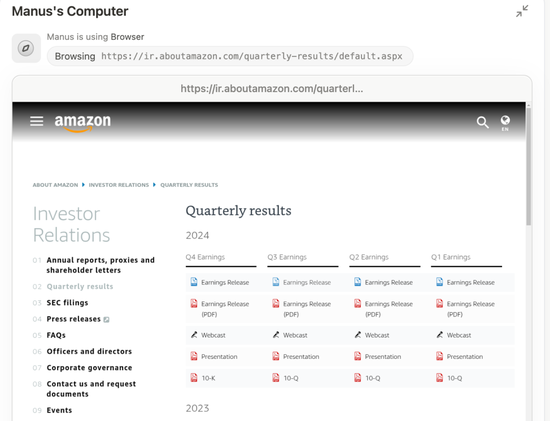

Manus 全网深入调研找到最符合需求的货源

|

||||

|

||||

|

||||

|

||||

让 Manus 根据你的个人主页或简历制作一个有设计感的名片。

|

||||

|

||||

|

||||

|

||||

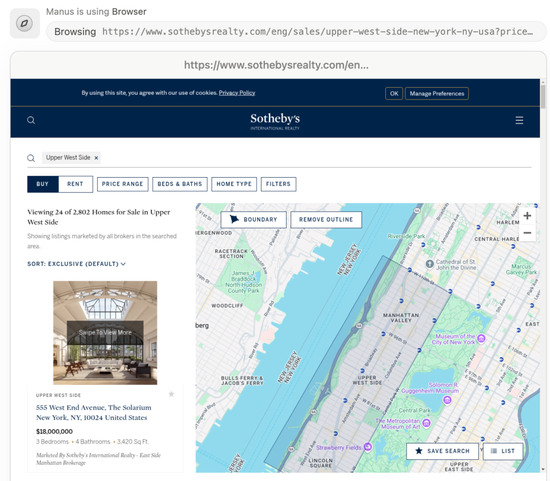

Manus 将深入理解和分析你的家庭情况和需求,并去专业的房产销售网站为你筛选最符合需求的标的。

|

||||

|

||||

|

||||

|

||||

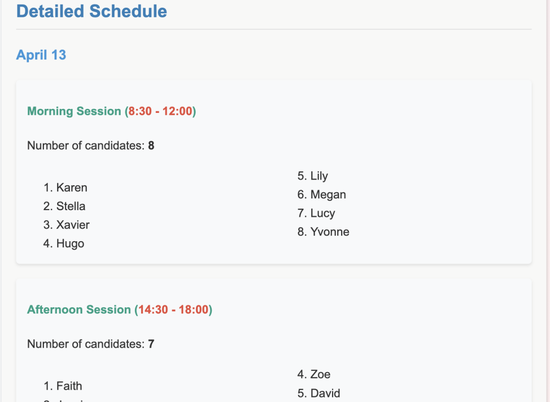

来看看 Manus 是高效合理的安排 40 位候选人的时间

|

||||

|

||||

|

||||

|

||||

上传你的课堂录音,让 manus 为你做一个图文并茂的课堂笔记

|

||||

|

||||

|

||||

|

||||

Manus 为你全面个性化整理高质量的强化学习学习资源。

|

||||

|

||||

|

||||

|

||||

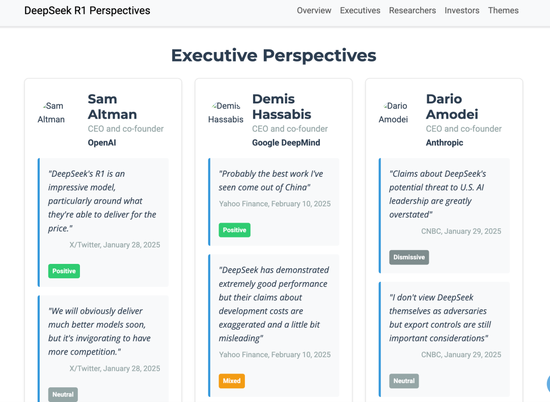

Manus 可以为你从各个渠道收集你关心的某个事件关键人物的公开观点

|

||||

|

||||

|

||||

|

||||

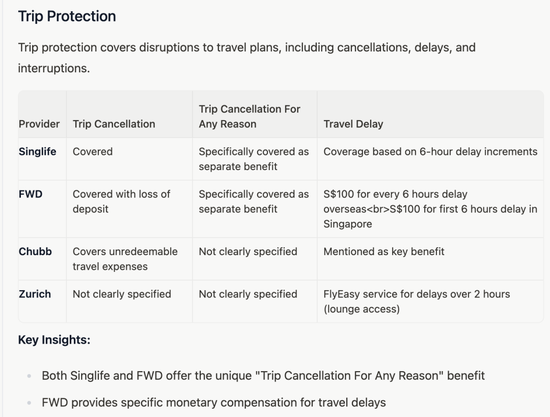

买保险的时候要对比太多 Policy 条款?交给 Manus 为你制作清晰的关键信息对比表,给出你最佳决策建议

|

||||

|

||||

|

||||

|

||||

枯燥但需要打起十二分精神来完成的繁琐的合同审查工作,也是 Manus 非常擅长的。Manus 将会根据你的合同先去研究和学习相关的法律法规,再有理有据的告诉你的合同目前存在的纰漏。

|

||||

|

||||

|

||||

|

||||

把你的 API excel 文档交给 Manus,让他为你转换成一个详尽的 doc 版本的 API 文档。

|

||||

|

||||

|

||||

|

||||

Manus 深入文献研究 Pitera 这种化妆品成分,并撰写了 Youtube 视频讲解脚本。

|

||||

|

||||

|

||||

|

||||

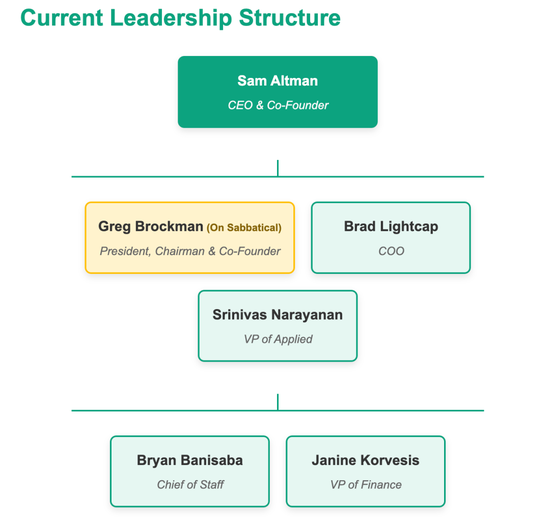

Manus 通过公开信息的深入搜集和分析,绘制一份公司组织关系图。

|

||||

|

||||

|

||||

|

||||

我们让 Manus 看 Techcrunch 的官网设计风格,并根据这个风格设计了一套 Slide 可用的 icon 图表库

|

||||

|

||||

|

||||

|

||||

Manus 根据你的喜好为你定制一段任意长度的冥想引导音频

|

||||

|

||||

|

||||

|

||||

Manus 深入进行股票分析,并制作惊艳的 Dashboard 为你展示股票的详细信息

|

||||

|

||||

|

||||

|

||||

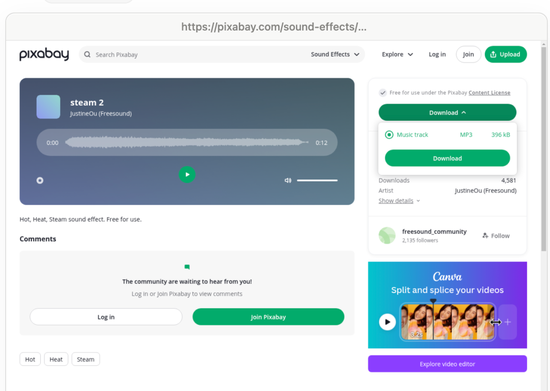

Manus 可以为你定制化你想要的各种奇怪的音效,来听听 Manus 为我们做的鸟鸣混合蒸汽的音效

|

||||

|

||||

|

||||

|

||||

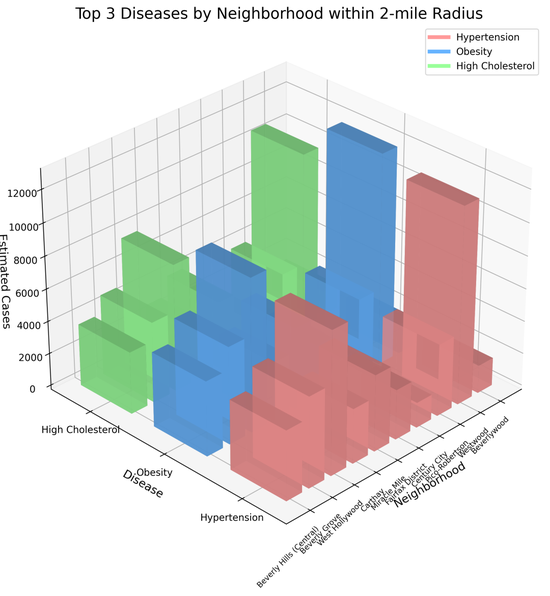

Manus 可以深入分析地区 POI 数据,交叉验证官方统计数据,深入分析某地病患人口统计

|

||||

|

||||

|

||||

|

||||

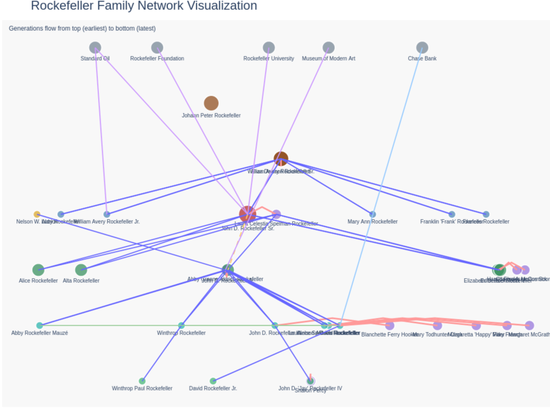

Manus 深入搜集了洛克菲勒家族并将家族关系整理成了清晰的关系图表

|

||||

|

||||

|

||||

|

||||

Manus 通过资料搜集、分析并发挥想象力为编剧创作者提供资料支持和灵感启发

|

||||

|

||||

|

||||

|

||||

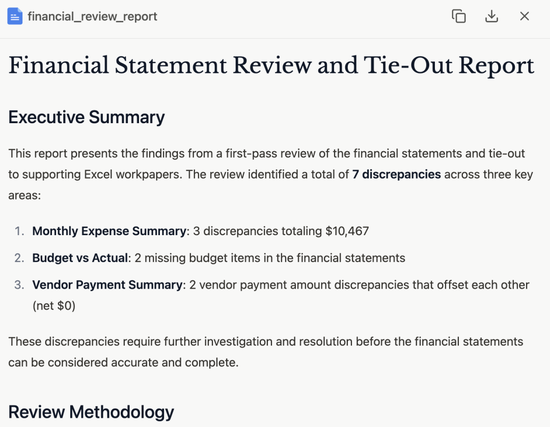

根据财务记录文件审核公司的财务报表

|

||||

|

||||

|

||||

|

||||

描述你公司的业务和你期待的潜在 B 端客户画像,Manus 将为你深入 Mapping

|

||||

|

||||

|

||||

|

||||

Manus 为一家得克萨斯州的 BBQ 门店深入进行门店周边的数据估算和分析并提供销售额提升策略报告

|

||||

|

||||

|

||||

|

||||

当你需要学习某个开源项目时,manus 会深入代码库理解代码,绘制系统结构图,并为你深入讲解项目细节

|

||||

|

||||

|

||||

|

||||

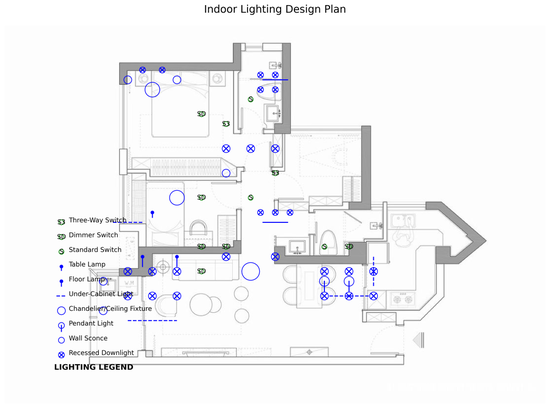

上传室内平面图,Manus 学习室内灯光设计科学后为你设计室内灯光

|

||||

|

||||

|

||||

|

||||

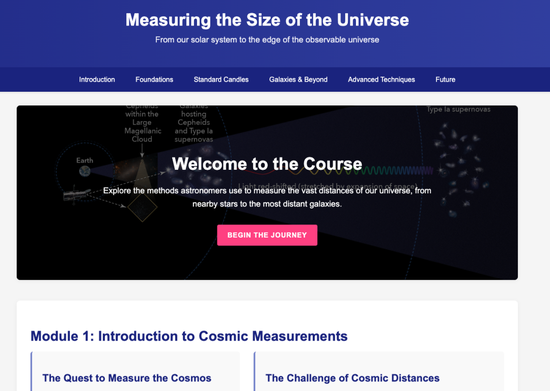

Manus 为你制作宇宙大小测量的互动课程网页

|

||||

|

||||

|

||||

|

||||

为中学教师制作动量定理讲解的视频展示课件

|

||||

|

||||

|

||||

|

||||

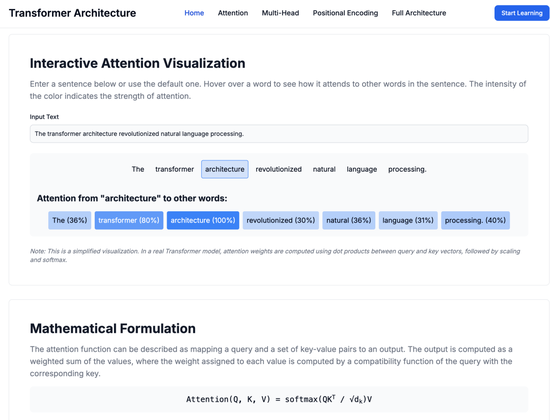

Manus 为你清晰、惊艳的制作 Transformer 架构的互动讲解网页

|

||||

|

||||

|

||||

|

||||

Manus 可以代理你深入体验某个网站的功能并作为一个产品专家为你写详尽的产品体验报告

|

||||

|

||||

|

||||

|

||||

Manus 可以为记者或投资人深入整理待访谈人的全面信息并准备访谈所需的所有材料

|

||||

|

||||

|

||||

|

||||

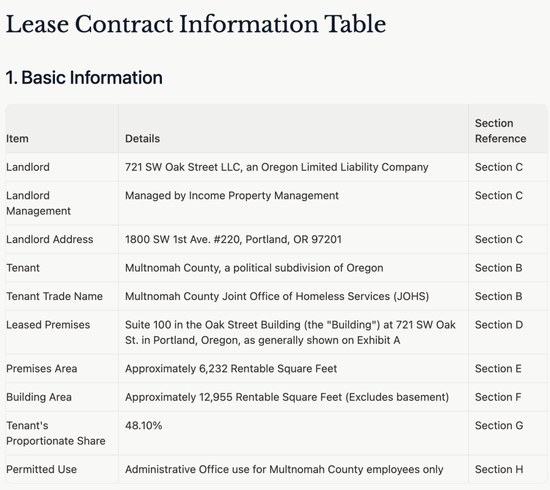

为你的复杂租赁合同制作一份关键信息表格

|

||||

|

||||

|

||||

|

||||

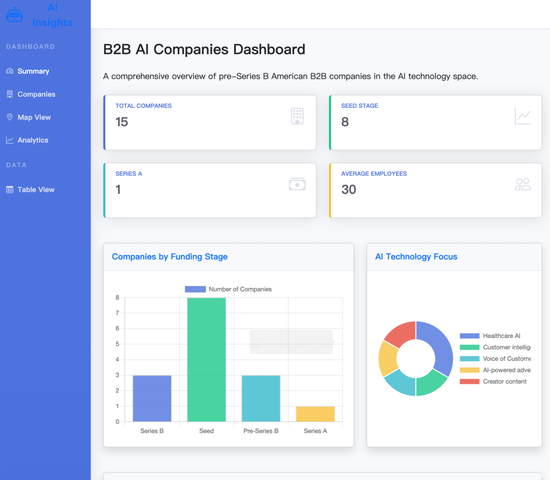

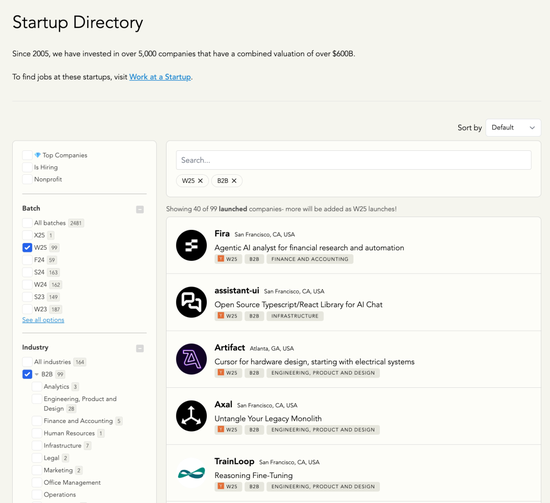

我们想要 YC w25 batch 中所有的 B2B 公司的名单,Manus 自己操作 YC 官网筛选出符合要求的公司,并高效完成任务

|

||||

|

||||

|

||||

|

||||

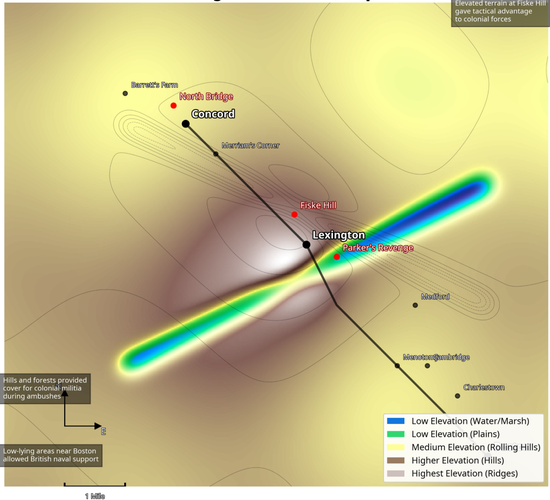

Manus 为我们讲解莱克星顿第一枪的战役过程时,配上了自己画的可视化地图

|

||||

|

||||

|

||||

|

||||

你下一场的演讲需要个逐字稿提词器?Manus 将贴心地为你制作一个可控制速度、可控制字体大小、阅读清晰的 presentattion 文件

|

||||

|

||||

|

||||

|

||||

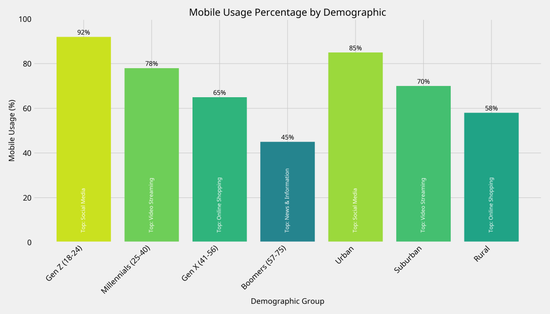

让 Manus 深入研究美国在感恩节期间的各州移动互联网流量消费情况并制作丰富的可视化图表

|

||||

|

||||

|

||||

|

||||

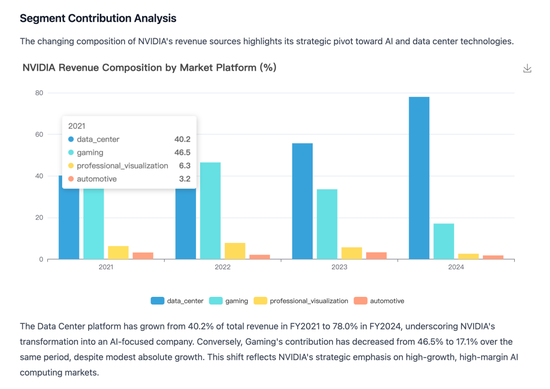

按照要求深入分析英伟达的财报

|

||||

|

||||

|

||||

|

||||

上传你的 Amzon 网店销售数据表格,Manus 为你深入分析、可视化并提供销售提升建议

|

||||

|

||||

|

||||

|

||||

给 Manus 一个 Kaggle 竞赛网址,Manus 自己完成了代码编写,预测结果输出。一次打到了前 10% 的成绩

|

||||

|

||||

|

||||

|

||||

Manus 为你定制个性化的小游戏。来试试泽连斯基白宫论战模拟器

|

||||

|

||||

|

||||

|

||||

让 Manus 为你的播客节目剪个两分钟的金句合集吧!

|

||||

|

||||

|

||||

|

||||

Manus 不仅会润色你的文章,还能贴心地让美化文章的排版

|

||||

|

||||

|

||||

|

||||

Manus 深入研究整理了服装行业的 AI 搜索产品,并进行详尽的产品分析

|

||||

|

||||

|

||||

|

||||

如果你需要了解某个产品真实的市场反馈,Manus 会为你详细整理分析电商平台对该产品的客户评论

|

||||

|

||||

|

||||

|

||||

Manus 通过深度研究和数据分析详尽论证 AWS 未来千亿市值的可能性

|

||||

|

||||

|

||||

|

||||

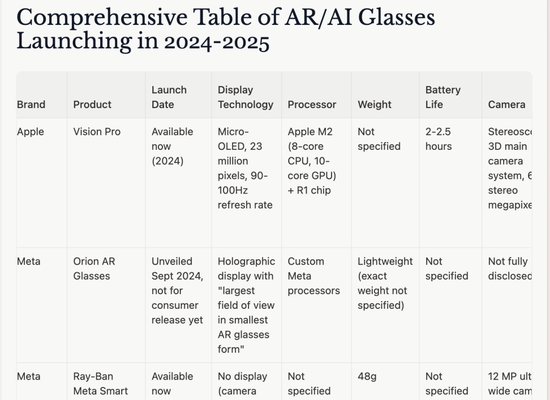

Manus 自己找到并研究了 24 年所有重要的 AR/AI 产品和行业动态

|

||||

|

||||

|

||||

|

||||

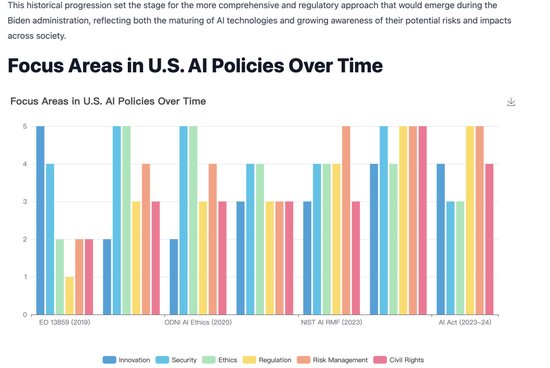

Manus 通过一手信息源的追踪整理,深入细节研究了过去十年美国 AI 产业政策

|

||||

|

||||

|

||||

|

||||

一次性上传 25 份候选人简历,manus 会按要求制作候选人信息表格,甚至能为你评估潜在候选人

|

||||

|

||||

|

||||

|

||||

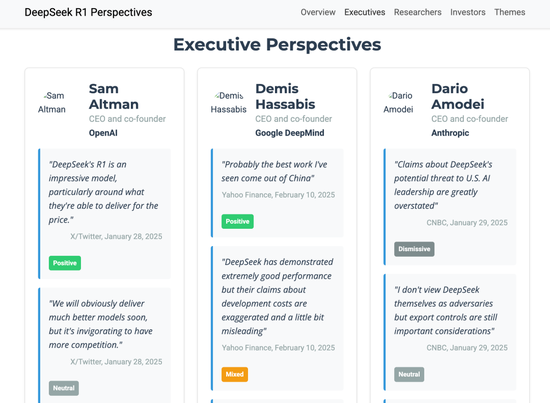

Manus 可以让你轻松知道某个话题在 Twitter\\youtube 等社交媒体上的舆论情况

|

||||

|

||||

|

||||

|

||||

Manus 调研市场上 Top 20 的 CRM 机构,并整理出了各自的 Slogan 与品牌故事。

|

||||

|

||||

|

||||

|

||||

Manus 不仅能整合各类信息为你提供详尽的个性化旅行定制,还能为做一个专属你这次旅行的 handbook。

|

||||

|

||||

|

||||

|

||||

我们让 Manus 完成了对 Andrej Karpathy 的个人网站的 SEO 优化报告,只需要甩给 Manus 一个网址即可

|

||||

|

||||

|

||||

|

||||

Manus 通过深入的公开资料研究,为你撰写一份 Adobe 的公司传记。Manus 可以真正为你关心的主题写一本书,你再也不用担心读不到你喜欢的名人或公司的传记了。

|

||||

|

||||

|

||||

|

||||

通过上面的例子,你会发现 Manus 与 ChatGPT、Claude 这类传统聊天[机器人](https://finance.sina.com.cn/realstock/company/sz300024/nc.shtml)有本质区别。

|

||||

|

||||

- Manus 拥有强大的工具调用能力:它不仅能理解你的需求,还能主动调用浏览器、代码编辑器、数据分析工具等完成复杂任务。它不只是告诉你“应该怎么做”,而是直接为你把事情做好,将最终成果交付给你。

|

||||

- 运行在云端的 Manus 有自己的计算环境:能够独立工作而不需要你的持续监督。你只需提出需求,然后去处理其他事务,它会在后台自主完成任务。这种“委托 - 交付”模式真正解放了你的时间和注意力。

|

||||

- 与 Manus 的协作更像与人类同事合作,而非使用工具:你可以随时介入调整方向,中途更改需求,Manus 会灵活适应。当某次任务完成得特别好,你可以直接告诉它“以后都这样做”,它会记住你的偏好,不断调整工作方式,成为越来越懂你的伙伴。

|

||||

|

||||

因此,Manus 特别擅长处理繁琐的文件批处理任务,如批量简历整理、文件格式转换、合同财报审核等:

|

||||

|

||||

- 它能进行深度调研分析,从多渠道搜集信息,提供全面而有见解的研究报告。

|

||||

- 面对复杂生活决策,Manus 可以帮你比较选项、规划旅行,让决策过程变得轻松。

|

||||

- 在数据分析方面,Manus 会自动找到相关数据源,编写代码分析并创建直观的可视化效果。

|

||||