@@ -49,6 +49,17 @@ export default [

|

||||

"title": "2025-04",

|

||||

"collapsable": true,

|

||||

"children": [

|

||||

"Deepseek行业资讯/2025-04/Cursor 迎来了强大的对手,Augment Code 实测",

|

||||

"Deepseek行业资讯/2025-04/一张照片生成连贯全片!Runway Gen4 深夜发布,终于捅破 AI 视频多年的天花板",

|

||||

"Deepseek行业资讯/2025-04/AI 生态的 USB 接口?阿里、腾讯全面支持 MCP",

|

||||

"Deepseek行业资讯/2025-04/5 分钟直出 46 页论文!谷歌 Deep Research 完爆 OpenAI,最强 Gemini 2.5 加持",

|

||||

"Deepseek行业资讯/2025-04/Shopify 新标准:将 AI 融入日常工作,已是基本要求",

|

||||

"Deepseek行业资讯/2025-04/《聪明的机器,复杂的人心》,斯坦福 AI 报告 2025 年版的 12 个信号",

|

||||

"Deepseek行业资讯/2025-04/实测:阿里云百炼上线「全周期 MCP 服务」,AI 工具一站式托管",

|

||||

"Deepseek行业资讯/2025-04/正式挑战谷歌!OpenAI 上线 ChatGPT 搜索功能",

|

||||

"Deepseek行业资讯/2025-04/Meta 深夜开源 Llama 4!首次采用 MoE,惊人千万 token 上下文,竞技场超越 DeepSeek",

|

||||

"Deepseek行业资讯/2025-04/马云现身阿里云发声!谈科技人员责任:让 AI 更懂人类",

|

||||

"Deepseek行业资讯/2025-04/Gemini 2.5 Pro 实测:或将成为最实用的推理模型",

|

||||

"Deepseek行业资讯/2025-04/阿里秘密研发新模型将发布,影响力指标成最重要考核",

|

||||

"Deepseek行业资讯/2025-04/有史以来最大力度!苹果进军医疗,计划明年推出AI医生 - 华尔街见闻",

|

||||

"Deepseek行业资讯/2025-04/一张照片生成连贯全片!Runway Gen-4 深夜发布,终于捅破 AI 视频多年的天花板",

|

||||

|

||||

@@ -0,0 +1,181 @@

|

||||

## 5 分钟直出 46 页论文!谷歌 Deep Research 完爆 OpenAI,最强 Gemini 2.5 加持

|

||||

|

||||

|

||||

|

||||

【新智元导读】谷歌 Deep Research 重大升级,搭载全球顶尖 Gemini 2.5 Pro 模型。5 分钟生成 46 页学术论文、复杂报告转为 10 分钟播客。性能超 OpenAI DR 40%,价格仅为其 1/10。

|

||||

|

||||

今早,谷歌 Deep Research 迎来史上最强升级,正式搭载了 Gemini 2.5 Pro 全球顶尖模型。

|

||||

|

||||

这一次,新版本在以下方面得到显著的提升:

|

||||

|

||||

|

||||

|

||||

谷歌 CEO 劈柴哥转发力挺。首席科学家、Gemini 负责人 Jeff Dean 也出来为 Deep Research 站台。

|

||||

|

||||

可见谷歌内部对这款产品的重视程度。

|

||||

|

||||

|

||||

|

||||

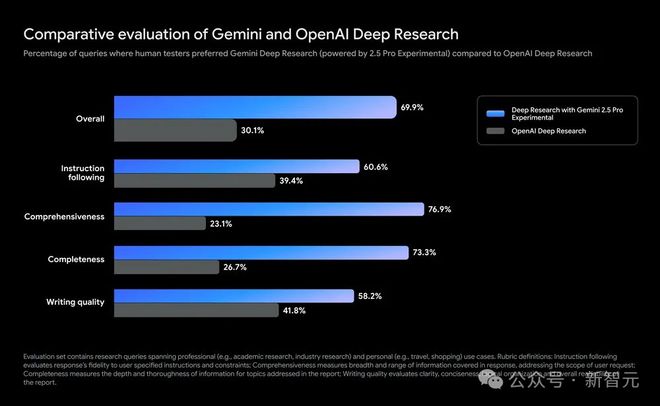

相较于 OpenAI DR,谷歌在整体性能上飙升超 40%。此外,在指令遵循、全面性、完整性、写作质量方面,谷歌 Deep Research 性能跃升很大。

|

||||

|

||||

|

||||

|

||||

在内部测试中,谷歌 DR 生成的报告深受评估者青睐,程度远超其他领先 DR 工具 2 倍多。

|

||||

|

||||

这意味着,不论你需要分析复杂问题,还是撰写高质量报告,DR 都能得心应手,节省数小时的时间。

|

||||

|

||||

不过,这次的升级将率先为 Gemini Advanced 订阅用户开放,仅需 19.99 美元,要比 OpenAI DR(200 美元/月)整整便宜 10 倍。

|

||||

|

||||

|

||||

|

||||

只需登录网页版、安卓版、或是 iOS 版 GeminiApp,均可第一时间体验新功能。

|

||||

|

||||

而现在,已经有一大批网友开启测试,效果足够惊艳。

|

||||

|

||||

5 分钟搞定 46 页论文 + 播客

|

||||

|

||||

量子物理学家、AI 研究科学家 ChrisUniverse 第一时间对 Gemini 2.5 Pro 驱动的 Deep Research 做了测试。

|

||||

|

||||

|

||||

|

||||

体验之后他被深深震撼到了,「我们正处于技术和信息爆炸的奇点,速度前所未有。」他写道。

|

||||

|

||||

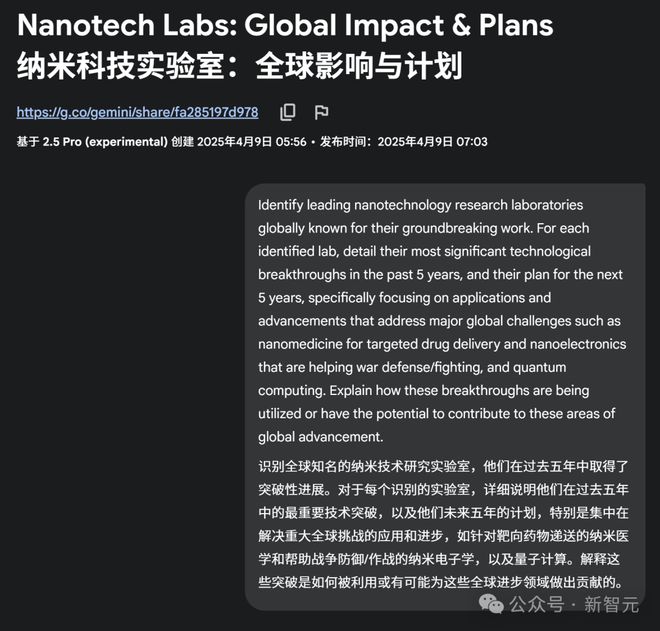

作为一名物理学家,ChrisUniverse 让谷歌 DR 研究了过去五年纳米技术的突破。

|

||||

|

||||

|

||||

|

||||

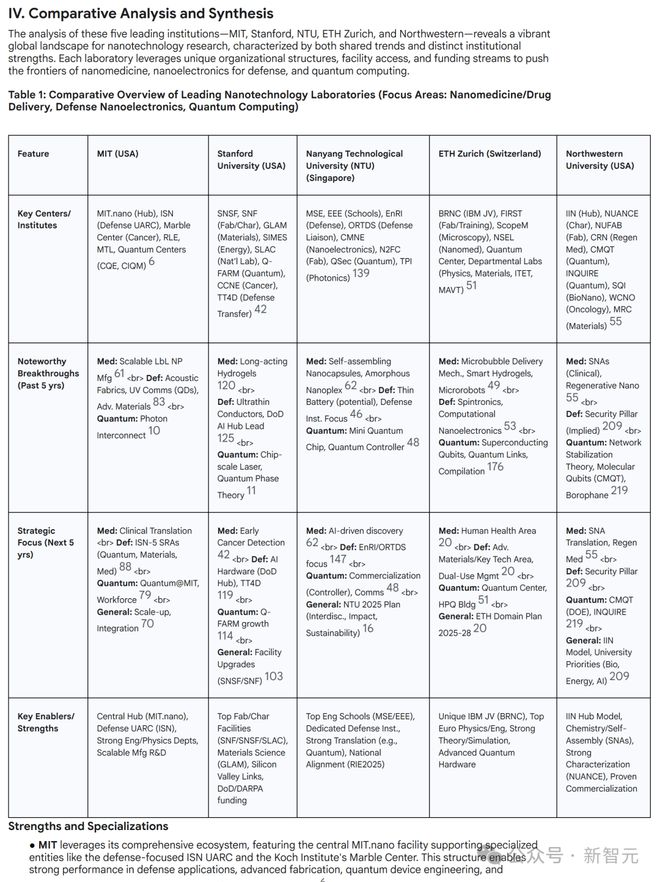

仅仅这一个提示,谷歌 DR 就自己找到并研究了 339 个网站,生成了一篇长达 46 页的完整学术论文。

|

||||

|

||||

论文列举了 5 个全球知名的纳米技术实验室,详细总结了他们过去五年的重要技术突破以及未来的计划。

|

||||

|

||||

|

||||

|

||||

论文地址:

|

||||

|

||||

https://docs.google.com/document/d/1uxexZharvJJ8ScVFmhrDrFfiYtiSmQ9oeYkZBBxwDZ8/edit?tab=t.0

|

||||

|

||||

除此之外,论文中还通过表格对这五家研究机构做了详细的横向对比。

|

||||

|

||||

|

||||

|

||||

如果担心 AI 的幻觉问题,那也没关系,谷歌 DR 在结尾列出了十几页的数据来源链接。

|

||||

|

||||

这还不算完,如果你看到这份 46 页的论文比较头疼,那么再加一句提示词,谷歌 DR 立马帮你把论文转成一个 10 分钟的播客!

|

||||

|

||||

这样你就可以把一篇枯燥的学术论文变成一个类似真人的对话访谈,听着理解其中内容。

|

||||

|

||||

|

||||

|

||||

更厉害的是,所有这些过程一共还不到 5 分钟!

|

||||

|

||||

ChrisUniverse 表示,现在自己了解了全球顶尖的 5 家纳米科技公司,包括它们的核心实验室、突破性成果,以及未来 5 年的重点方向。

|

||||

|

||||

「这些信息要是放在 2 年前,可能得花我几天甚至几周时间去研究,说不定还更久。」他说。

|

||||

|

||||

ChrisUniverse 自己也没想到谷歌 DR 如此好用,已经好到让他无话可说了。

|

||||

|

||||

|

||||

|

||||

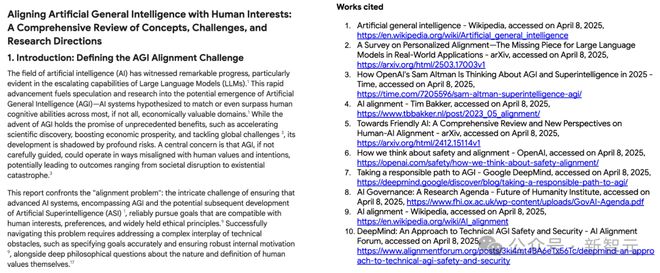

另一位 AI 大佬 Kol Tregaskes 提供一个话题——如何让 AGI 与人类价值观对齐,谷歌 DR 在极短时间内,直出 46 页报告。

|

||||

|

||||

|

||||

|

||||

他表示,这次改进比 Gemini 2.0 版本加持 DR 报告长度更多,而且与 OpenAI DR 相当。这从侧面印证了,谷歌基准测试中,DR 的完整性是最强的。

|

||||

|

||||

|

||||

|

||||

而且,在报告文末,一共引用了 138 参考链接,在生成过程中查阅了足足 179 个参考网站,对于人类来说,一个时间根本看不完。

|

||||

|

||||

|

||||

|

||||

报告地址:https://docs.google.com/document/d/1e4qMho\_5p-yfCx6Dqx8BhjW79qEg4C30uj1f1SKCA8k/edit?tab=t.0

|

||||

|

||||

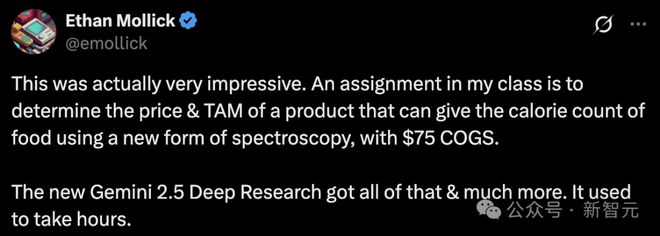

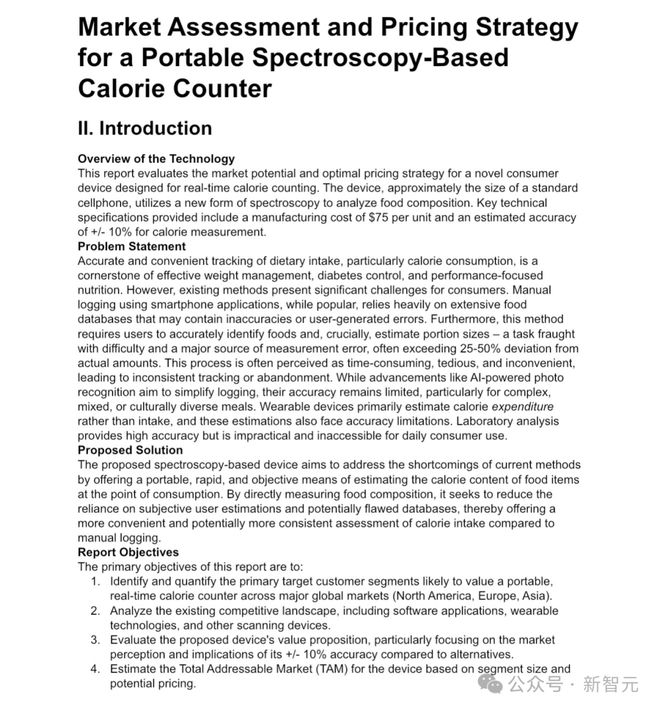

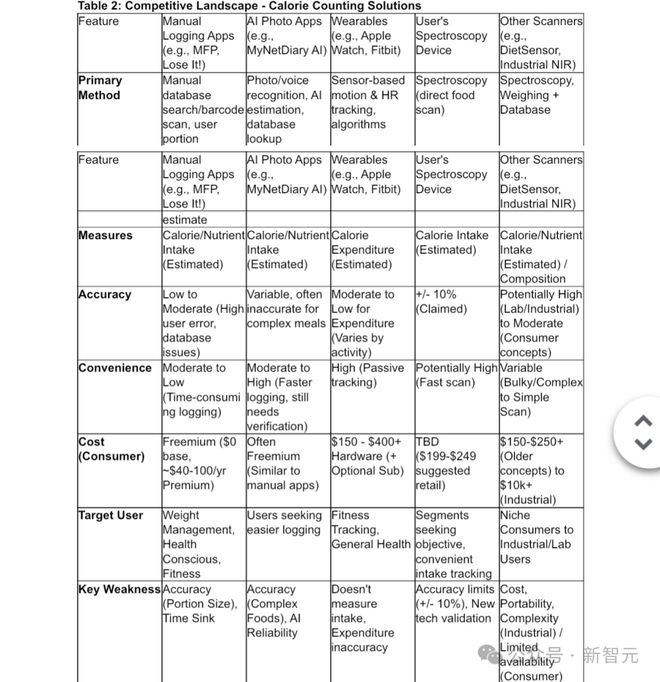

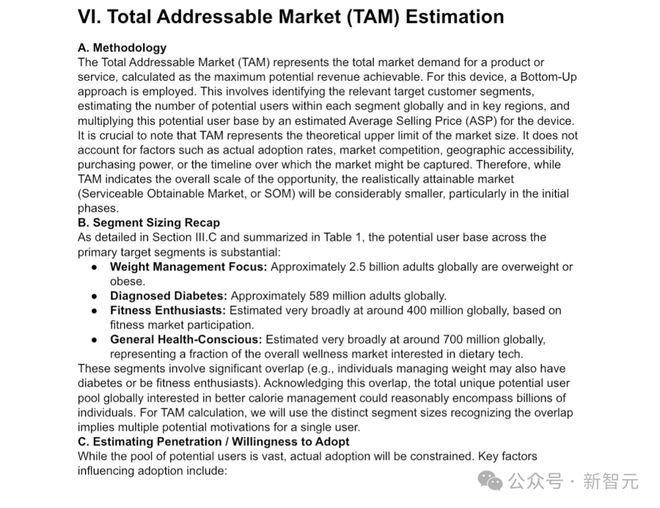

沃顿商学院教授 Ethan Mollick 将课堂一项作业扔给谷歌 DR——为一种采用新型光谱技术、成本 75 美元的食物热量检测设备进行定价及总体可获取市场(TAM)分析。

|

||||

|

||||

他惊喜地发现,Gemini 2.5 加持的 DR 不仅完美完成分析,还提供更多深度洞察。

|

||||

|

||||

要知道,这类分析通常消耗数小时。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

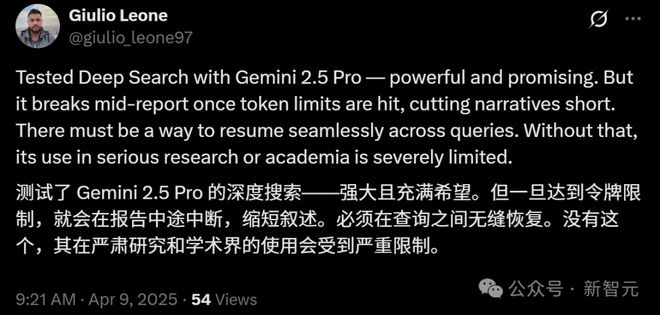

虽然一片叫好之声,网友 Giulio Leone 也指出了谷歌 DR 的一点问题。

|

||||

|

||||

他表示,虽然 Gemini 2.5 Pro 加持的 DR 非常强大,但一旦达到 token 数量限制,报告就会中断。

|

||||

|

||||

Giulio 认为,谷歌应该让报告的生成可以无缝衔接,否则会在严肃的研究中受限。

|

||||

|

||||

|

||||

|

||||

胜券在握,DeepMind 注定会赢?

|

||||

|

||||

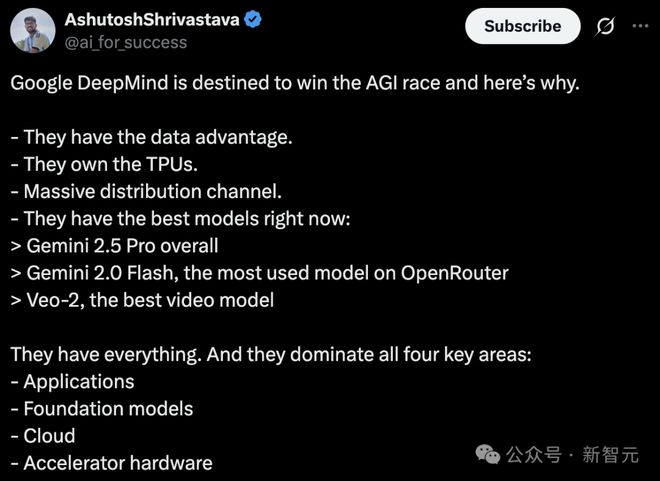

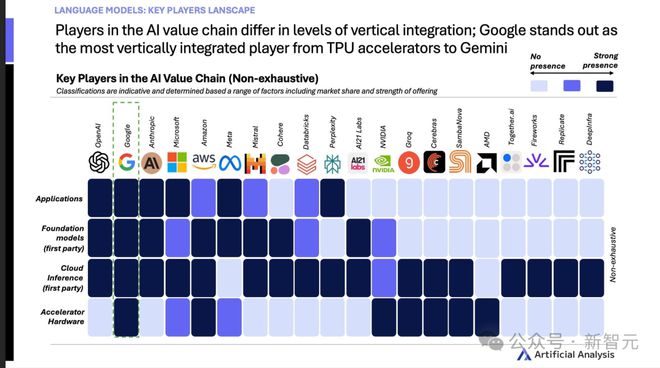

不难看出,在 AI 激烈角逐中,谷歌 DeepMind 正以无可匹敌的优势崭露头角。

|

||||

|

||||

从数据到硬件,从模型到人才战略,他们似乎已经掌握了通往 AGI 的所有关键要素。

|

||||

|

||||

|

||||

|

||||

几天前,Artificial Analysis 一份报告中,展示了谷歌在应用、基础模型、云服务、加速器硬件四大关键领域全面开花。

|

||||

|

||||

|

||||

|

||||

网友@ai_for_success 分析称,谷歌 DeepMind 具备了海量的数据优势,依托谷歌生态系统的庞大资源,为训练更强大、更智能 AI 提供坚实基础。

|

||||

|

||||

而目前,DeepMind 拥有业界公认的最优模型阵容,涵盖了多个领域。

|

||||

|

||||

比如,综合性能最强的旗舰模型 Gemini 2.5 Pro;推理模型 Gemini 2.0 Flash 兼具速度与实用性;Veo 2 成为视频生成领域的翘楚。

|

||||

|

||||

不仅如此,他们还手握 TPU 这张王牌,专为深度学习任务优化,性能和效率远超传统 GPU。

|

||||

|

||||

再加上谷歌自身庞大的分发渠道,能够让 DeepMind 的成果无缝集成,迅速抵达全球用户。Google Cloud 更是为 AI 提供高效部署平台。

|

||||

|

||||

这不,一年一度 Google Cloud Next 今晚将在拉斯维加斯召开,届时还会带来更多新品。

|

||||

|

||||

|

||||

|

||||

与此同时,谷歌开发者关系负责人 Logan Kilpatrick 也在频频暗示这周的重大发布。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

在人才方面,谷歌 DeepMind 更是通过激进的「竞业禁止协议」,牢牢地锁住了 AI 顶尖人才。

|

||||

|

||||

据 BI 爆料,DeepMind 部分英国员工在离职后,需遵守长达 6-12 个月的竞业协议,在此期间不得为竞争对手工作。

|

||||

|

||||

为了确保这些人才不流向对手,他们甚至还会为部分员工提供「花园休假」(garden leave),即在竞业期继续支付薪水,但员工务虚工作。

|

||||

|

||||

|

||||

|

||||

与其让人才立即跳槽至对手公司,谷歌宁愿花钱让他们休假一年。

|

||||

|

||||

一位前 DeepMind 员工无奈地表示,「在 AI 这个圈子,一年后再入职,谁会签你」?

|

||||

|

||||

的确,在 AI 日新月异的当下,6 个月空窗期就可能让人错误无数机会,更不用说整整一年。

|

||||

|

||||

就连微软 AI 副总 Nando de Freitas 曾公开抨击了这种做法,称其为「滥用权力」。

|

||||

|

||||

|

||||

|

||||

谷歌这种做法,无非只有一个目的,在 AGI 竞赛中拔得头筹。

|

||||

|

||||

前谷歌员工甚至表示,「当前 AI 热潮如同『太空竞赛』,这是我职业生涯中看到如此疯狂的战争。领先 6 个月或是 1 年,可能就意味着一切」。

|

||||

|

||||

大模型、人才、数据、硬件,谷歌 DeepMind 几乎在这场终极赛的每个环节,都占据了制高点。

|

||||

|

||||

AGI 终点尚不明朗,但至少现在,他们已经手握胜券的所有筹码。

|

||||

|

||||

参考资料:

|

||||

|

||||

https://x.com/GeminiApp/status/1909721519724339226

|

||||

|

||||

https://x.com/testingcatalog/status/1909725934846116209

|

||||

|

||||

https://x.com/ChrisUniverseB/status/1909744703504793952

|

||||

|

||||

> 来源:新浪财经 APP

|

||||

@@ -0,0 +1,61 @@

|

||||

## AI 生态的 USB 接口?阿里、腾讯全面支持 MCP

|

||||

|

||||

成为未来 AI 生态的“标准 USB 接口”

|

||||

|

||||

MCP 被认为是未来 AI 生态的“标准 USB 接口”,OpenAl、谷歌、微软和亚马逊等均已支持。

|

||||

|

||||

阿里云百炼上线业界首个全生命周期 MCP 服务,无需用户管理资源、开发部署、工程运维等工作,5 分钟即可快速搭建一个连接 MCP 服务的 Agent(智能体)。腾讯云也迅速跟进,正式发布“AI 开发套件”,支持 MCP 插件托管服务,帮助开发者最快 5 分钟搭建业务型 AI Agent。《科创板日报》注意到,即将在 4 月 25 日举行的 Create2025 百度 AI 开发者大会上,MCP 生态也成为重要议题之一。

|

||||

|

||||

过去一个月,国外巨头如 OpenAl、谷歌、微软和亚马逊也陆续宣布支持或正在深度集成 MCP 协议。

|

||||

|

||||

中信建投认为,在 AI Agent 中,MCP 相较于传统 Function Calling 外部工具的调用方式,通过主机、服务器和客户端的解耦,大幅降低重复开发成本,同时提升了各类 AI 工具的互联互通能力,亦为全球复现 Manus 的关键技术。随着头部公司的加速支持,MCP 生态边界有望进一步拓展,加速 AI 产业发展。

|

||||

|

||||

当前 MCP 协议仍处在发展早期阶段,生态不健全、工具链不完整、数据质量不能保证等等,是其面临的主要挑战。

|

||||

|

||||

## **成为未来 AI 生态的“标准 USB 接口”**

|

||||

|

||||

MCP(Modular Context Protocol)是给多智能体系统使用的上下文协议,让不同 Al Agent 听得懂彼此的“工作语言”。过去,大模型想调用导航、订酒店等这些功能,得程序员一个个写代码对接,现在只要符合 MCP 标准,所有工具都能即插即用。

|

||||

|

||||

阿里云智能集团资深副总裁刘伟光表示, **MCP 是今天公认的业界标准,有望加速 AI 应用爆发的最后一公里的连接。**

|

||||

|

||||

“在 MCP 之前有很多人尝试过函数调用、提示词工程、插件等方式,今天 MCP 通过统一标准接口, **类似于今天电脑手机当中看到 USB-C、Tap C 接口,这样一种标准接口降低大模型和外部系统的集成门槛。“**

|

||||

|

||||

映云科技市场与开发者社区总监顾钧表示,MCP 的价值在于标准化了模型和其他组件之间的访问接口,简化了之前复杂的构建 Agent 的框架。

|

||||

|

||||

相比最初 AI 智能体的单打独斗,现在的 AI 智能体已经开始成为“一个小团队”,负责行程规划的、负责订票的、负责客服联络的….….每个 Agent 各司其职, **而 MCP 有望成为未来 AI 生态的标准化协议,负责串起每个 Agent 的意图、状态、任务和环境。** 正如当年智能手机靠“应用商店”引爆生态,MCP 或许就是 AI 时代的生态钥匙。

|

||||

|

||||

快思慢想研究院院长田丰向《科创板日报》介绍,“MCP 就好比一条高速公路,原来大家用 API 连接 APP,现在用 MCP 来连接 Agent,实现快速调用、数据交互。比如,开车时想知道周围有哪些好吃的,饿了么、大众点评 MCP 服务就可以推荐了。在开车沿途过程中,各种衣食住行都可以给用户推荐。如果通过 MCP 更好地调用跨领域多智能体协作,来完成用户的复杂任务,实现智能体任务流之间的无缝衔接,那么对于用户体验将有很大的提升。”

|

||||

|

||||

## **阿里、腾讯等支持 MCP 国内协议标准开启**

|

||||

|

||||

巨头们自然不会错过这一 AI 生态布局。此前,OpenAl、谷歌、微软和亚马逊等国外企业已经陆续宣布支持或正在深度集成 MCP 协议。OpenAI 于 3 月 27 日官宣 Agents SDK 加入 MCP 服务协议,后续 ChatGPT 桌面应用和 Responses API 也将快速支持。

|

||||

|

||||

国内厂商也开始跟进。昨日,阿里云百炼宣布全面支持 MCP 服务部署与调用,首批上线了高德、无影、Fetch、Notion 等 50 多款阿里巴巴集团和三方 MCP 服务。

|

||||

|

||||

腾讯云紧随其后宣布支持 MCP。有业内分析认为,一旦 MCP 能在微信生态中落地,基于微信小程序、企业微信、腾讯会议等平台的 Al Agent 会获得巨大的可用空间。这对开发者来说,是非常现实的利好。

|

||||

|

||||

此外,百度地图、高德地图、腾讯地图,以及蚂蚁集团旗下 OceanBase 数据库等应用也已宣布支持 MCP 接口。

|

||||

|

||||

一位浙江大学 AI 研究学者表示,随着国内 MCP 协议标准开启,有望推动各类 Agent 炸场,未来甚至人人都可以是程序员。

|

||||

|

||||

开放传神(OpenCSG)创始人陈冉向《科创板日报》分析,MCP 是 AI Agent 的中间态,其推动 AI agent 爆发的作用无需质疑,而未来终极形态则是 Native Agent(原生智能体)。

|

||||

|

||||

《科创板日报》获悉,阿里云已在推进 AI Agent Store 的生态建设。“站在 2025 年 AI Agent 爆发元年,不仅属于技术突破,更属于开放、协作和共享生态,我们追求的一定不是单纯的模型强国,而是未来的更为丰富的 AI 应用强国。”阿里云智能集团资深副总裁刘伟光称。

|

||||

|

||||

田丰看好腾讯和阿里系既有的业务生态所形成的智能体家族,在 MCP 协议的推动下有望发挥更大的价值。“以往不同厂家的移动互联网 APP 之间是有巨大的壁垒,在单一厂家生态范围内通过 MCP 修路,这些 APP 能变为一种 AI 智能体的管家组合,然后开放给阿里云上的 Agent 开发者。”

|

||||

|

||||

## **MCP 协议仍处在发展早期**

|

||||

|

||||

虽然阿里、腾讯等巨头的入局为其注入了动力,但 MCP 协议仍处在发展早期阶段。

|

||||

|

||||

“生态不健全,工具链不完整,模型成本还过高,数据质量不能保证等等,是目前 MCP 协议发展的挑战。”陈冉提到。

|

||||

|

||||

顾钧认为, **核心还是效果,能否满足业务需求。“数据库这些基础软件支持 MCP 协议,会比较简单,但如果是现有的业务系统,千头万绪想要支持不容易。”**

|

||||

|

||||

另有,IT 业内人士认为,互联网的封闭生态,难以让 MCP 协议发挥预想的效应。“各个互联网企业会在内部生态里实现打通,但对外该封闭还是封闭。而 MCP 协议的初衷是在开放数据的预设场景下推出的,如果不是这样的,那么其对 AI 智能体生态打造的作用会很有限。”

|

||||

|

||||

田丰也表示,MCP 生态的开放程度非常重要,才能在上面长出新应用。“因为就算有了高速公路,但如果这条路上有一堆关卡要收昂贵的过路费,那么开发者是玩不起的,他们是从 0 到 1 在做创新。”

|

||||

|

||||

总而言之,MCP 协议要成为真正的行业标准,除了协议本身的兼容性和安全性问题,还需要生态的进一步成熟。这也是 MCP 能否走远的关键。

|

||||

|

||||

> 来源:财联社 AI daily | 36kr

|

||||

@@ -0,0 +1,139 @@

|

||||

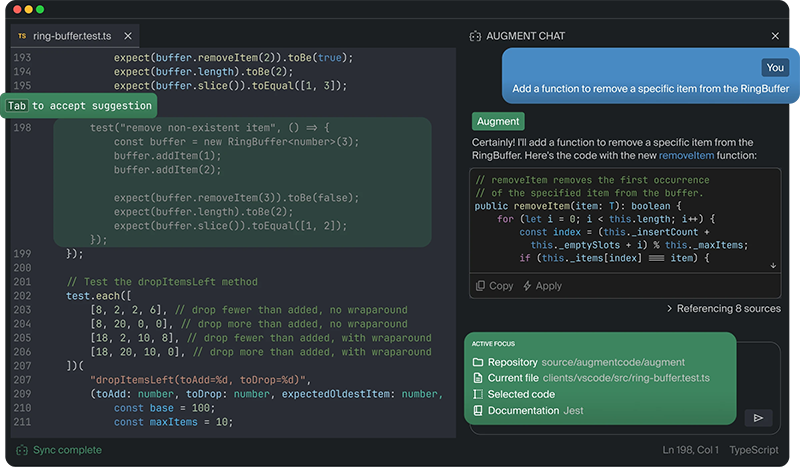

## Cursor 迎来了强大的对手,Augment Code 实测

|

||||

|

||||

## Augment Code 介绍

|

||||

|

||||

根据官方介绍,Augment Agent 是首个转为大型代码库工作的专业软件工程师设计的 AI 编码助手,上下文支持 200K,也就是 20 万的 token 啊。

|

||||

|

||||

这对于专业的编程人员来讲,太实用了,已经达到可以做项目级别了。

|

||||

|

||||

除此之外,Augment Agent 还支持持久性的内存,就是它可以学习你的编码风格,记得你之前的重构,适配你的代码规范。记忆会随着时间的推移而积累。你不必在每次会话中重新教它。

|

||||

|

||||

除了基本的编码支持,Augment Agent 还支持多模态输入,如截图和 Figma 文件,用于修复错误和实现 UI。

|

||||

|

||||

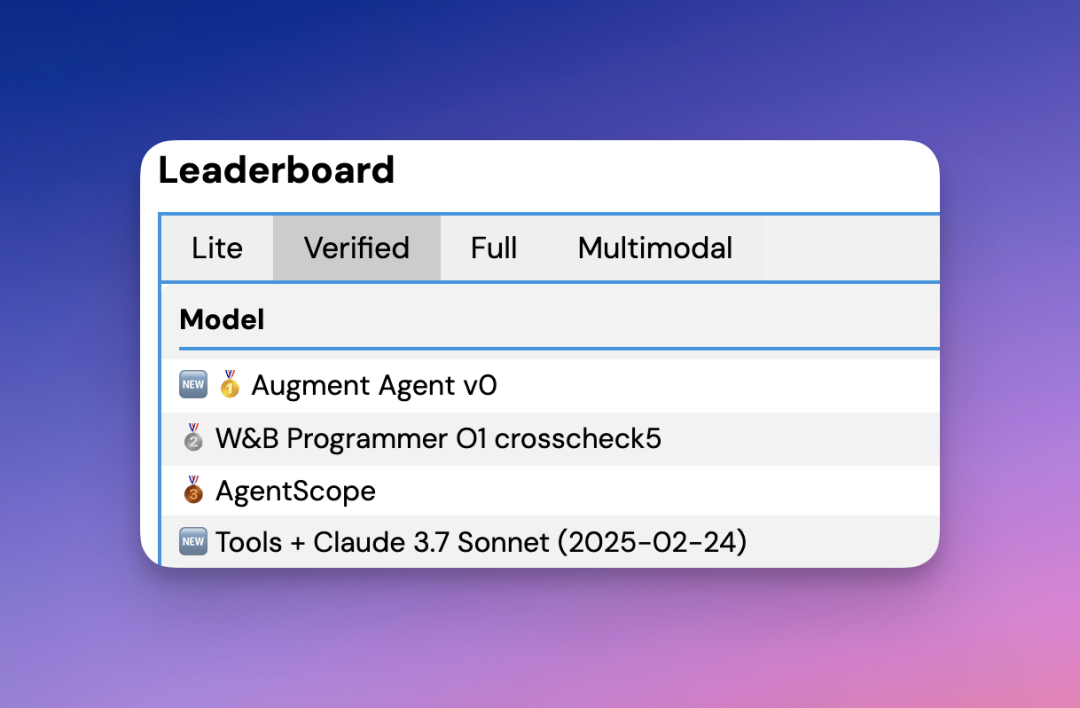

另外,目前 Augment Agent 通过结合 [Anthropic](https://zhida.zhihu.com/search?content_id=256145915&content_type=Article&match_order=1&q=Anthropic&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDcyMjEsInEiOiJBbnRocm9waWMiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYxNDU5MTUsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.s-Qlz5_gQXKB-83ew6fdNuoqCgOSZ69vCoaXwefWdcQ&zhida_source=entity) 的 [Claude Sonnet 3.7](https://zhida.zhihu.com/search?content_id=256145915&content_type=Article&match_order=1&q=Claude+Sonnet+3.7&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDcyMjEsInEiOiJDbGF1ZGUgU29ubmV0IDMuNyIsInpoaWRhX3NvdXJjZSI6ImVudGl0eSIsImNvbnRlbnRfaWQiOjI1NjE0NTkxNSwiY29udGVudF90eXBlIjoiQXJ0aWNsZSIsIm1hdGNoX29yZGVyIjoxLCJ6ZF90b2tlbiI6bnVsbH0.Ks9wyI53nxEYvxg3d-2qBm9e_IipirNvX86aSq5yKeM&zhida_source=entity) 和 [OpenAI](https://zhida.zhihu.com/search?content_id=256145915&content_type=Article&match_order=1&q=OpenAI&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDcyMjEsInEiOiJPcGVuQUkiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYxNDU5MTUsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.dos4DrsF8bBrrMJP56gBcEBaRRvD_smBaFOX4vPO-s8&zhida_source=entity) 的 [O1 推理模型](https://zhida.zhihu.com/search?content_id=256145915&content_type=Article&match_order=1&q=O1+%E6%8E%A8%E7%90%86%E6%A8%A1%E5%9E%8B&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDcyMjEsInEiOiJPMSDmjqjnkIbmqKHlnosiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYxNDU5MTUsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.JukcV5qUlsKbGMIXftuvbN_W1ZFODYvuca55rKQbIew&zhida_source=entity),在 SWE-bench verified 基准测试中取得了最高分,达到第 1 名(在真实任务上达到 65.4%)。

|

||||

|

||||

|

||||

|

||||

### **简介**

|

||||

|

||||

Augment 是一款开发者 AI 平台,它能帮助你理解代码、调试问题并快速交付,因为它理解你的代码库。使用聊天、下一编辑和代码补全功能,让你更高效地完成任务。

|

||||

|

||||

|

||||

|

||||

核心宣传点:

|

||||

|

||||

1. 1\. Chat(聊天):永远不再为开始而卡壳。聊天将帮助你快速熟悉不熟悉的代码。

|

||||

2. 2\. 下一代编辑器:通过逐步引导您完成复杂或重复性的更改,帮助您持续推进任务。

|

||||

3. 3\. 代码补全:智能代码建议,即可了解您的代码库。

|

||||

|

||||

这里我推荐一个非常好用的手指筷子,在平时玩手机、电脑工作、刷剧的时候想吃零食又不想脏手,非常实用和实惠,我买了两双,爱不释手。现在卖的很便宜

|

||||

|

||||

## Augment Code 试用

|

||||

|

||||

### 安装

|

||||

|

||||

目前提供了 `vscode` 扩展、`[JetBrains IDEs](https://plugins.jetbrains.com/plugin/24072-augment)` 插件、`VIM` 这三种使用方式,下面通过安装 `vscode` 扩展来使用。

|

||||

|

||||

|

||||

|

||||

安装成功之后,需要进行登陆,登陆成功之后就可以使用了;目前测试下来 `remote` 模式的 `vscode` 登陆不上,本地的可以。

|

||||

|

||||

### 使用

|

||||

|

||||

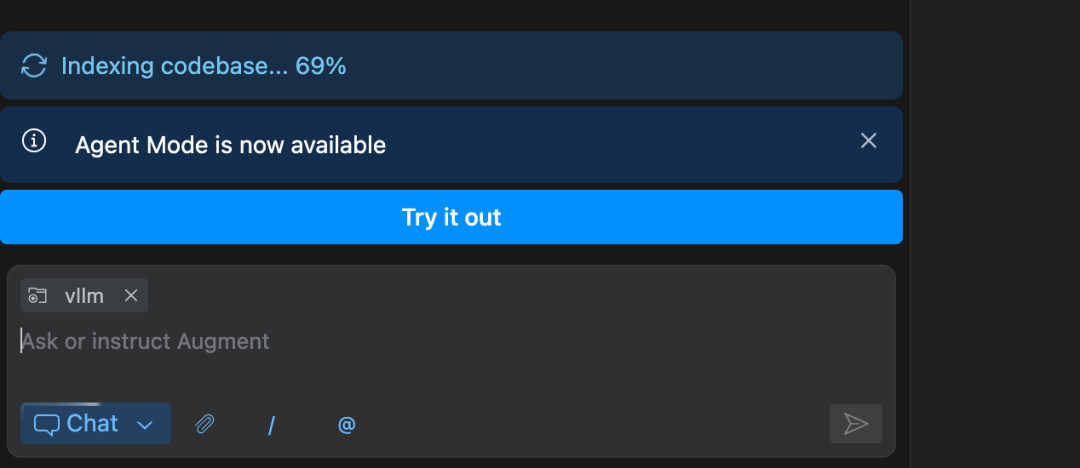

刚好有一份 `vllm` 项目的代码,而且也不太懂,测试一下看能不能把我讲明白。

|

||||

|

||||

1. 1\. 先导入一个项目;导入之后它就会进行索引整个项目

|

||||

|

||||

|

||||

|

||||

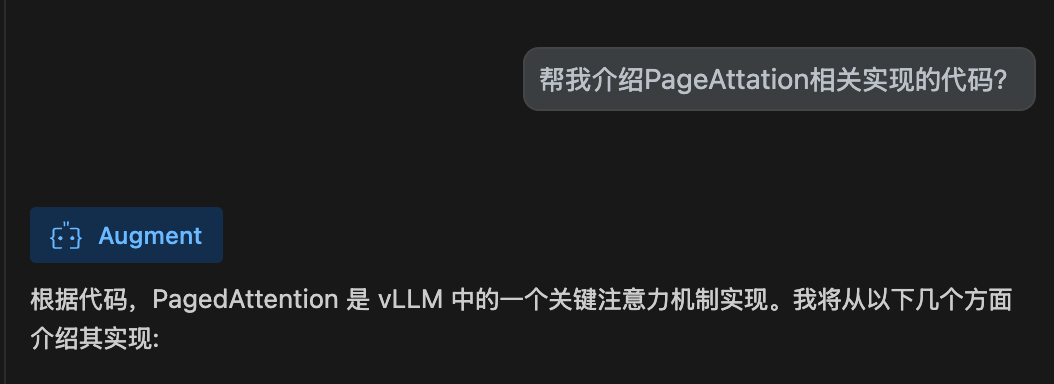

`vllm` 最核心的就是 `PagedAttention` 的原理,但是从之前看过一些介绍来看,只是明白了,但还不知道是如何实现的。

|

||||

|

||||

`PagedAttention` 的核心就是把 `Attention` 的加载从一个连续的显存空间拆分成了按显存页进行加载,使 `GPU` 的显存利用率增高。

|

||||

|

||||

### 问出了第一个问题:介绍`PagedAttention`

|

||||

|

||||

|

||||

|

||||

1. 1\. 核心架构,这个我去看了代码确实是对的,在 `vllm/attention/backends` 目录下的 `abstract.py` 文件中有这个抽象类的定义。还提到了它有多个实现类,这个有点问题,真实的实现类比这个多,比如缺少 `CPUMLABackend` 等等,还有好几个。

|

||||

|

||||

|

||||

|

||||

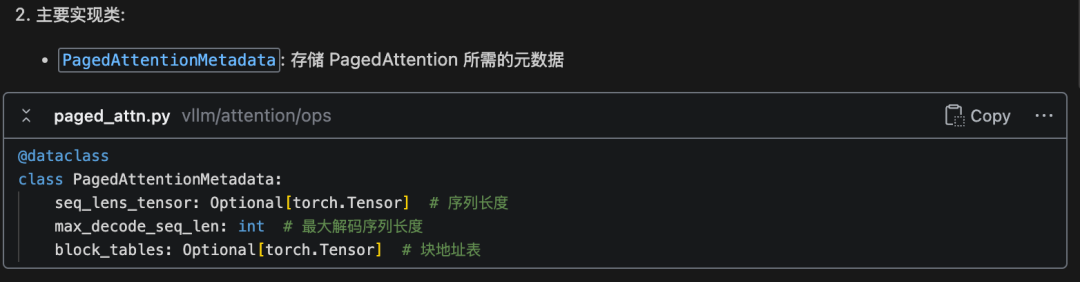

1. 1\. 讲了主要实现类以及文件位置 `PagedAttention` 都是对的。

|

||||

|

||||

|

||||

|

||||

1. 1\. 突然讲到了 `KV Cache` 管理,有点奇怪。

|

||||

|

||||

|

||||

|

||||

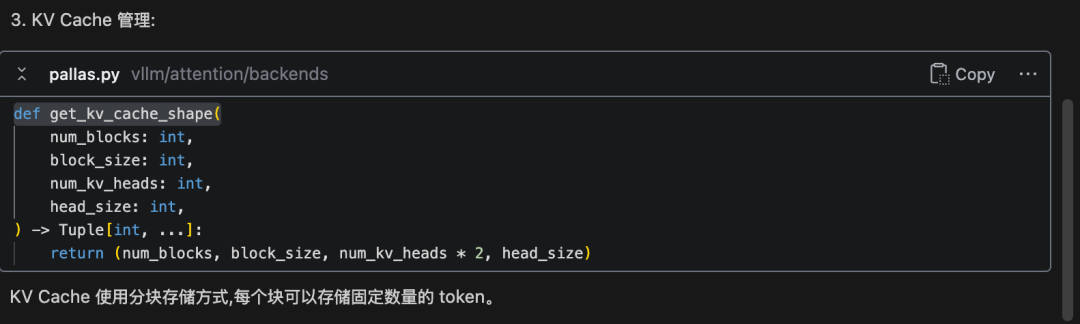

1. 1\. `Attention` 的计算实现 `forward_decode` 。提到有两种模式 `Decode` 和 `Prefix` ,对应的就是 `forward_decode` 和 `forward_prefix` 这两个函数。

|

||||

|

||||

|

||||

|

||||

1. 1\. 后面又补充了说支持很多硬件,算是给第一点进行补充,

|

||||

|

||||

|

||||

|

||||

这个问题问下来算是对这块的代码基本有一个了解了;比直接看确实强很多

|

||||

|

||||

### 第二个问题:让它帮我添加一个新模型

|

||||

|

||||

```text

|

||||

帮我添加 Salesforce/SFR-Embedding-Code-2B_R 这个新的模型在 vllm 中运行;目前 vllm 的代码还不能运行它。你需要去 huggingface 上查看模型 https://huggingface.co/Salesforce/SFR-Embedding-Code-2B_R/blob/main/config.json 文件,获取它的 architectures 信息,之后才能添加模型注册;其它还需要参考 https://huggingface.co/Salesforce/SFR-Embedding-Code-2B_R/blob/main/modeling_gemma2.py 中的实现使其在 vllm 中能运行。

|

||||

```

|

||||

|

||||

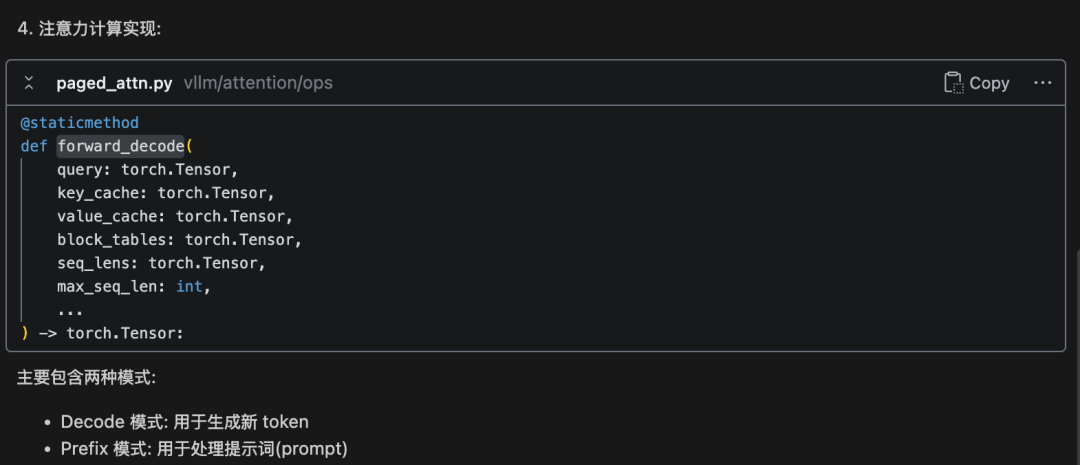

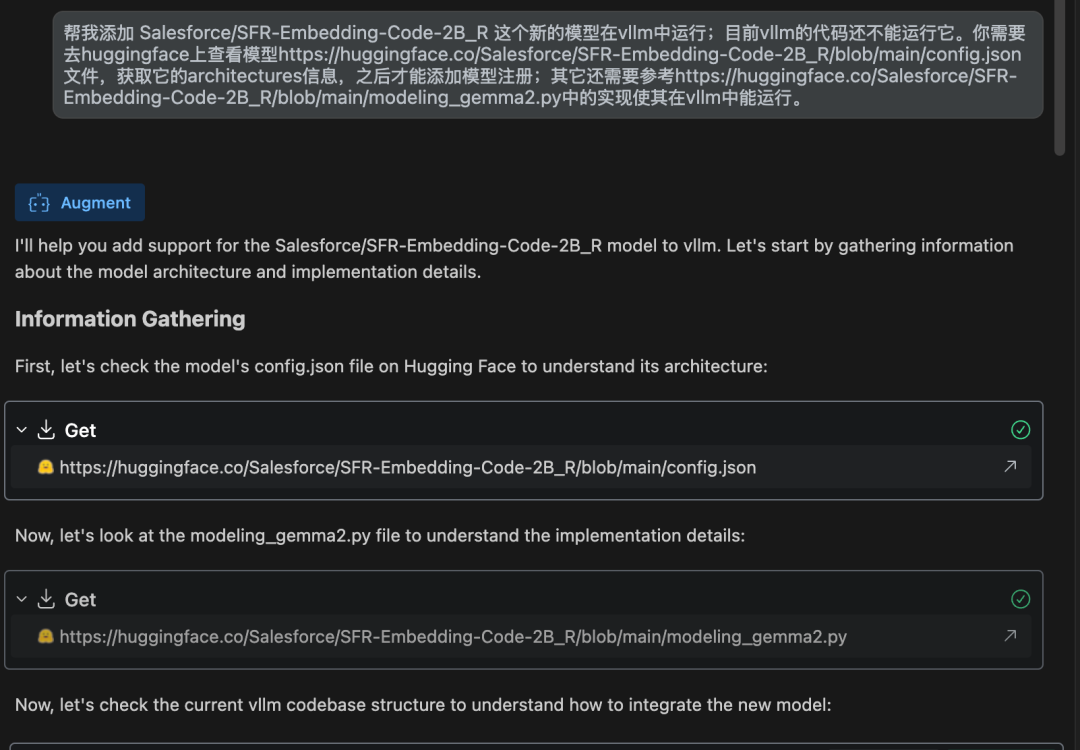

首先还是使用 `chat` 模式,进行了多次 输入的调整,但是依然回复的牛头不对马嘴;于是选用 `Agent` 模式进行测试一下。

|

||||

|

||||

还是使用上面的提示此。

|

||||

|

||||

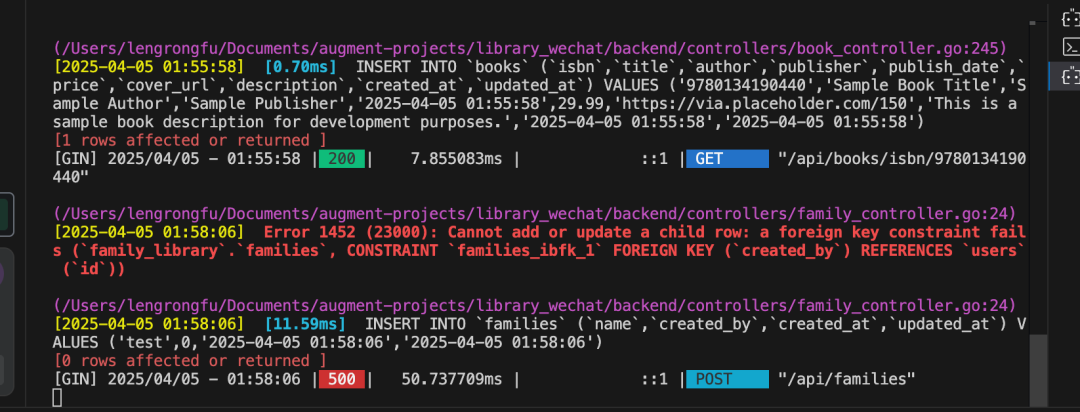

1. 1\. 第一点另我意外的是它居然真的去下载文件回来进行查看了。因为它需要知道这个模型架构的类型,就需要读取 `config.json` 文件,在 `chat` 模式下都是给我乱说的。

|

||||

|

||||

|

||||

|

||||

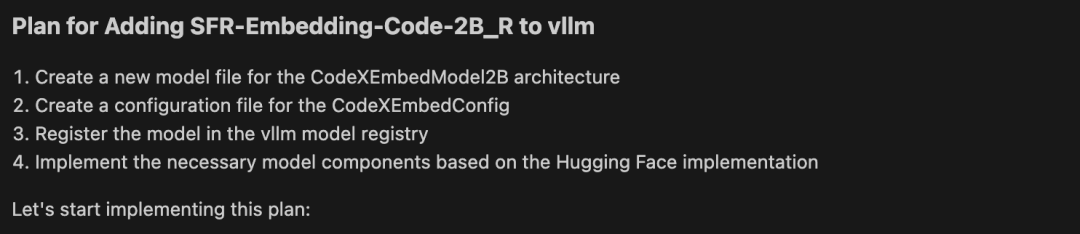

1. 1\. 然后它列出了执行计划,涉及到四个步骤;第一步这个模型架构就描述对了。

|

||||

|

||||

|

||||

|

||||

1. 2\. 它给我实现出来了,我直接进行测试一下,而且它还贴心的给了测试文件。

|

||||

|

||||

|

||||

|

||||

尝试运行之后发现还不能跑,有 bug,也可能和它训练时候的 `vllm` 版本代码有关,导入的很多包路径都有问题。

|

||||

|

||||

### 第三个问题:做一个微信小程序

|

||||

|

||||

```text

|

||||

帮我设计和实现一个微信小程序的项目,同时帮我实现后端 golang web 服务和数据库 mysql 表,项目主要功能是家庭图书管理系统,记录家庭购买的书籍以及存放位置信息等;主要有三页面,第一个页面是首页,主要展示家庭图书信息,可以支持搜索图书,需要通过调用后端 API 把功能实现。第二个页面是一个图书录入页面,通过扫描图书的 ISBN,然后通过后端的 ISBN 查询接口去查询图书的基本信息,包括作者、出版时间、价格等等;第三个页面是我的页面,主要是可以邀请家庭成员进入这个图书馆,查看图书所在位置和有那些图书。

|

||||

```

|

||||

|

||||

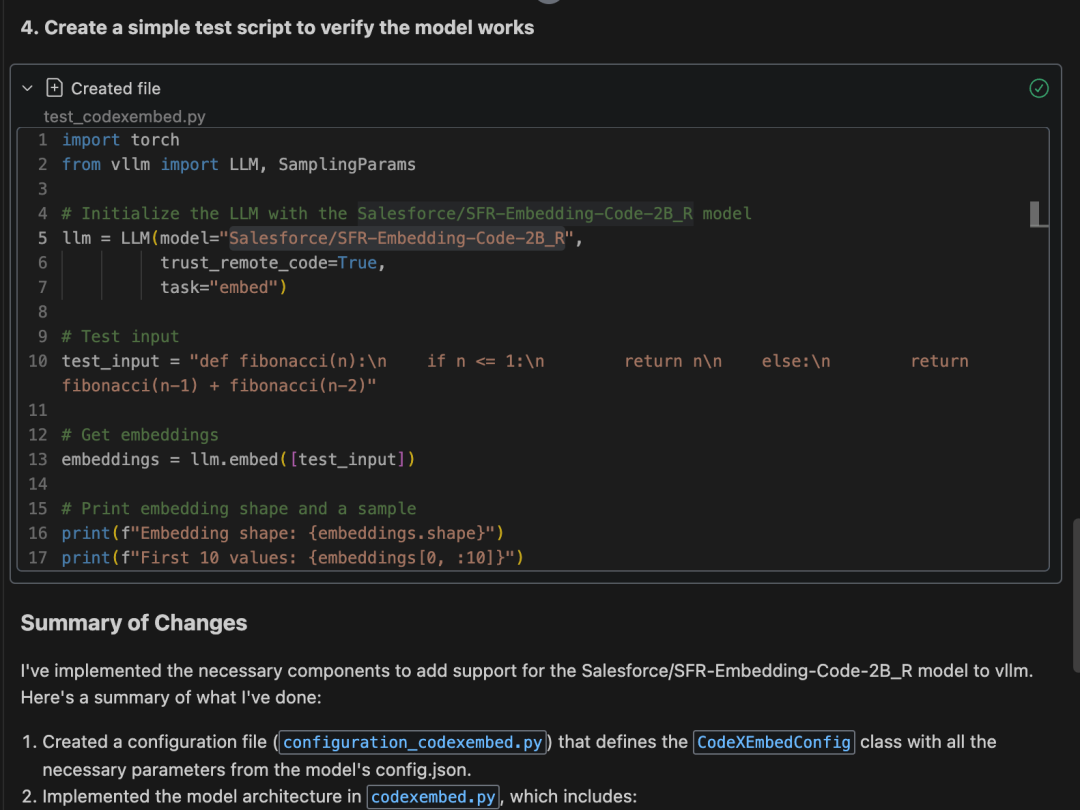

把提示此输入之后,大概 20 分钟给我实现了前端、后端、数据库表设计,并且最后都可以成功的执行。

|

||||

|

||||

1. 1\. 小程序

|

||||

|

||||

|

||||

|

||||

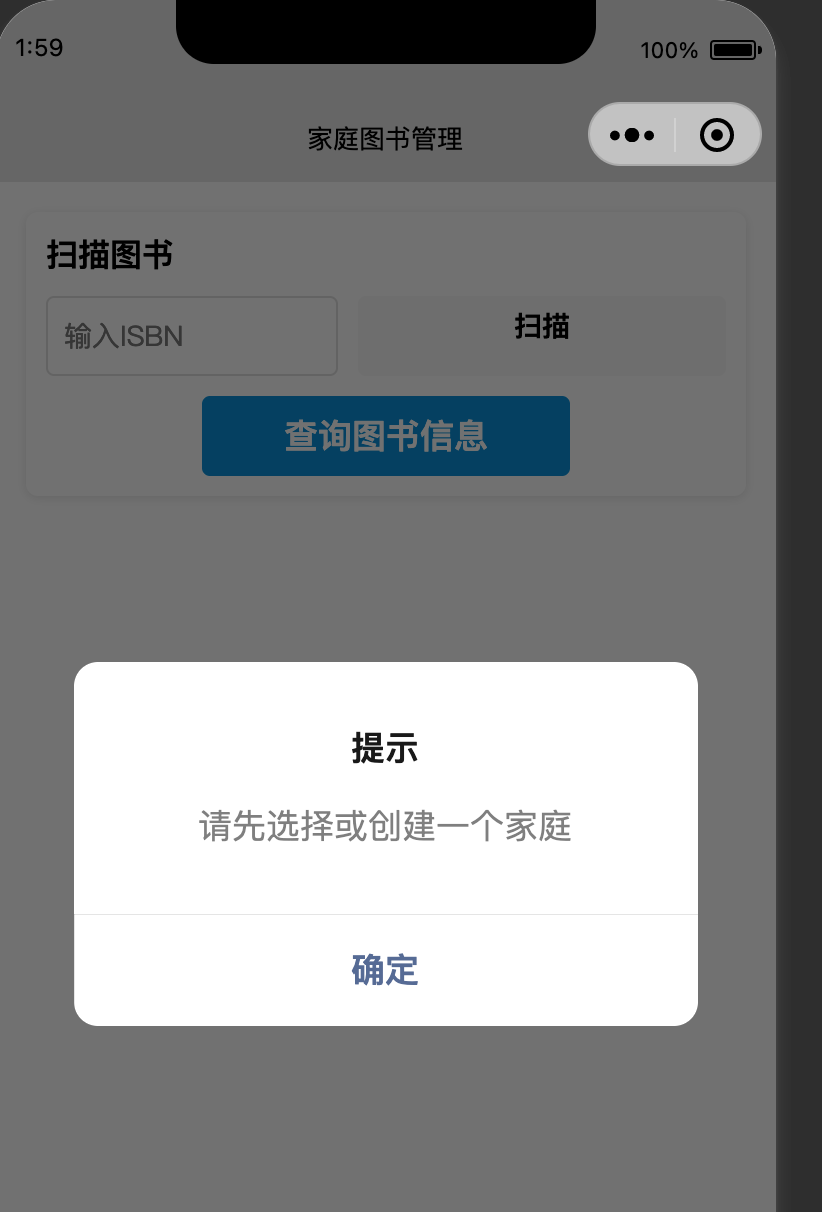

1. 2\. 后端自动给我启动之后调用 API 报错了,说明前端已经自动给我添加这个实现了。

|

||||

|

||||

|

||||

|

||||

1. 3\. 我本地没有数据库,让它给我用 docker 启动并且创建表

|

||||

|

||||

|

||||

|

||||

## 对比 Cursor

|

||||

|

||||

首先给我的感觉就是比 Cursor 可以执行的东西跟多了,而且执行很快,不知道是因为他们的模型快还是什么原因,总之很快,而且准确率很高。

|

||||

|

||||

在不久的将来,感觉像 `WEB` 程序只需要三个角色就可以做出一个系统来:

|

||||

|

||||

- • 一个 UI 设计,把所有的页面样式、图标设计好,给到工具。

|

||||

- • 一个产品经路,把业务逻辑梳理清楚。

|

||||

- • 一个架构师,把系统架构设计出来,设计出合理的数据库、接口定义等这些。

|

||||

|

||||

之后就可以通过工具自动化的生成、打包、部署然后就可以进行测试了。

|

||||

|

||||

### 引用链接

|

||||

|

||||

[1] abstract.py: _[http://abstract.py](https://link.zhihu.com/?target=http%3A//abstract.py)_

|

||||

|

||||

> 来源:知乎

|

||||

@@ -0,0 +1,41 @@

|

||||

## Gemini 2.5 Pro 实测:或将成为最实用的推理模型

|

||||

|

||||

Google 最新旗舰语言模型 Gemini 2.5 Pro 的发布,被吉卜力工作室 AI 图像风波所掩盖。也许是吸取了之前失败发布的教训,Google 谨慎地将其描述为"我们最智能的 AI 模型",而不像其他 AI 实验室那样宣称自己的新模型是世界最佳。

|

||||

|

||||

然而,实际测试表明,Gemini 2.5 Pro 确实令人印象深刻,可能是目前最优秀的推理模型。这为许多新应用开辟了道路,并可能使 Google 在生成式 AI 竞赛中处于领先地位。

|

||||

|

||||

具备出色编程能力的超长上下文

|

||||

|

||||

Gemini 2.5 Pro 最突出的特点是其超长的上下文窗口和输出长度。该模型可以处理多达 100 万个 token (即将支持 200 万),使其能够在需要时将多个长文档和完整的代码库装入提示中。该模型的输出限制为 64,000 个 token,而其他 Gemini 模型仅为 8,000 左右。

|

||||

|

||||

长上下文窗口也支持更长时间的对话,因为每次与推理模型的交互都可能产生数万个 token,特别是在涉及代码、图像和视频时(我在使用 Claude 3.7 Sonnet 时就遇到了这个问题,它的上下文窗口为 200,000 个 token)。

|

||||

|

||||

例如,软件工程师 Simon Willison 使用 Gemini 2.5 Pro 为他的网站创建了一个新功能。Willison 在博客中说:"它分析了我的整个代码库,找出了所有需要更改的地方——总共 18 个文件,从最终的 PR 中可以看出。整个项目从开始到完成只花了约 45 分钟,平均每个需要修改的文件不到 3 分钟。我向它提出了很多其他编程挑战,而评估这些结果的瓶颈变成了我自己的理解能力!"

|

||||

|

||||

令人印象深刻的多模态推理

|

||||

|

||||

Gemini 2.5 Pro 在非结构化文本、图像和视频方面也表现出色。例如,我向它提供了我最近关于基于采样搜索的文章,并要求它创建一个描述文中算法的 SVG 图形。Gemini 2.5 Pro 正确地提取了文章中的关键信息,并为采样和搜索过程创建了一个流程图,甚至准确地呈现了条件步骤。(相比之下,同样的任务使用 Claude 3.7 Sonnet 需要多次交互,而且最终达到了 token 限制。)

|

||||

|

||||

生成的图像有一些视觉错误(箭头位置不正确)。为了改进效果,我接着用多模态提示测试了 Gemini 2.5 Pro,给它一个渲染后的 SVG 文件截图和代码,要求它进行改进。结果令人印象深刻,它纠正了箭头的问题,并提升了图表的视觉质量。

|

||||

|

||||

其他用户在多模态提示方面也有类似的体验。例如,在测试中,DataCamp 复现了 Google 博客中展示的跑步游戏示例,然后将代码和游戏视频录制提供给 Gemini 2.5 Pro,并要求它对游戏代码进行一些修改。该模型能够对视觉内容进行推理,找到需要更改的代码部分,并做出正确的修改。

|

||||

|

||||

然而值得注意的是,与其他生成模型一样,Gemini 2.5 Pro 也可能出错,比如修改不相关的文件和代码段。指令越精确,模型出错的风险就越低。

|

||||

|

||||

具有实用推理过程的数据分析

|

||||

|

||||

最后,我用我典型的混乱数据分析测试来评估 Gemini 2.5 Pro 的推理能力。我提供了一个包含从雅虎财经不同股票历史页面复制粘贴的纯文本和原始 HTML 数据混合文件。然后要求它计算从 2024 年 1 月到文件中最新日期,每月初投资 140 美元,平均分配到"超级七巨头"股票的投资组合价值。

|

||||

|

||||

模型正确识别了文件中需要的股票(亚马逊、苹果、英伟达、微软、特斯拉、Alphabet 和 Meta),从 HTML 数据中提取金融信息,并根据每月初的股票价格计算每次投资的价值。它以格式良好的表格形式呈现了每月的股票和投资组合价值,并提供了整个投资在期末的总价值明细。

|

||||

|

||||

更重要的是,我发现其推理过程非常实用。虽然不清楚 Google 是否展示 Gemini 2.5 Pro 的原始思维链 (CoT) token,但推理过程非常详细。你可以清楚地看到模型是如何对数据进行推理、提取不同信息片段,并在生成答案前计算结果的。这有助于排查模型的行为,并在其犯错时引导它朝正确的方向发展。

|

||||

|

||||

企业级推理?

|

||||

|

||||

关于 Gemini 2.5 Pro 的一个担忧是,它只能在推理模式下使用,这意味着即使对于可以直接回答的非常简单的提示,模型也会经历"思考"过程。

|

||||

|

||||

Gemini 2.5 Pro 目前处于预览版阶段。一旦完整模型发布并公布定价信息,我们将更好地了解基于该模型构建企业应用的成本。不过,随着推理成本持续下降,我们可以期待它在规模化应用中变得更加实用。

|

||||

|

||||

尽管 Gemini 2.5 Pro 的首次亮相可能不够引人注目,但其功能值得关注。其超大的上下文窗口、出色的多模态推理能力和详细的推理链,为从代码库重构到精细数据分析等复杂的企业工作负载提供了切实的优势。

|

||||

|

||||

> 来源:澎湃新闻

|

||||

@@ -0,0 +1,138 @@

|

||||

## Meta 深夜开源 Llama 4!首次采用 MoE,惊人千万 token 上下文,竞技场超越 DeepSeek

|

||||

|

||||

万万没想到。Meta 选择在周六日,发布了最新 AI 模型系列 ——Llama 4,这是其 Llama 家族的最新成员。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/NZh1Fxddxd02VSBM.webp" alt="" width="100%" />

|

||||

|

||||

该系列包括 Llama 4 Scout、Llama 4 Maverick 和 Llama 4 Behemoth。所有这些模型都经过了大量未标注的文本、图像和视频数据的训练,以使它们具备广泛的视觉理解能力。

|

||||

|

||||

Meta GenAI 负责人 Ahmad Al-Dahle 表示,Llama 4 展示了 Meta 对开源 AI、整个开源 AI 社区的长期承诺以及坚定不移的信念 —— 开放系统将产出最好的小型、中型和即将出现的前沿大模型。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/olPCqIeVLrboWERM.webp" alt="" width="100%" />

|

||||

|

||||

谷歌 CEO 劈查伊不禁感叹,[人工智能](https://cloud.tencent.com/product/ai-class?from_column=20065&from=20065)世界永远不无聊,恭喜 Llama 4 团队,继续前进!

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/rm0wyEVzkWCmO5GN.webp" alt="" width="100%" />

|

||||

|

||||

在大模型竞技场(Arena),Llama 4 Maverick 的总排名第二,成为第四个突破 1400 分的大模型。其中开放模型排名第一,超越了 DeepSeek;在困难提示词、编程、数学、创意写作等任务中排名均为第一;大幅超越了自家 Llama 3 405B,得分从 1268 提升到了 1417;风格控制排名第五。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/mbX9CddoMznCJpof.webp" alt="" width="100%" />

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/DIegOg98wou5pKdn.webp" alt="" width="100%" />

|

||||

|

||||

那么 Llama 4 模型系列有何特点呢?具体而言:

|

||||

|

||||

Llama 4 Scout 是一个拥有 170 亿激活参数和 16 个专家的模型,是同类中全球最佳的多模态模型,比前几代 Llama 模型更强大,且能适配单个 NVIDIA H100 [GPU](https://cloud.tencent.com/product/gpu?from_column=20065&from=20065)。此外,Llama 4 Scout 提供了业界领先的 10M 上下文窗口,在广泛报道的基准测试中表现优于 Gemma 3、Gemini 2.0 Flash-Lite 和 Mistral 3.1。

|

||||

|

||||

Llama 4 Maverick 是一个拥有 128 位专家、170 亿个激活参数模型,是同类中最好的多模态模型,在广泛报道的基准测试中击败了 GPT-4o 和 Gemini 2.0 Flash,同时在推理和编程方面取得了与新 DeepSeek v3 相当的结果 —— 激活参数不到一半。Llama 4 Maverick 提供了一流的性价比,其实验性聊天版本在 LMArena 上的 ELO 得分为 1417。

|

||||

|

||||

以上这两个模型是 Meta 迄今为止最好的模型,主要得益于它们是从拥有 2880 亿激活参数和 16 个专家的 Llama 4 Behemoth 模型进行知识蒸馏而来。

|

||||

|

||||

Llama 4 Behemoth 是 Meta 目前最强大的模型之一,也是世界上最智能的大型语言模型之一。在多项科学、技术、工程和数学(STEM)基准测试中,Llama 4 Behemoth 的表现优于 GPT-4.5、Claude 3.7 Sonnet 和 Gemini 2.0 Pro。

|

||||

|

||||

不过,Llama 4 Behemoth 仍在训练中,后续 Meta 会放出更多内容。

|

||||

|

||||

好消息是,用户现在就可以在 llama.com 和 Hugging 上下载 Llama 4 Scout 和 Llama 4 Maverick 最新模型。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/9Pbj3qr0Pugjvsui.webp" alt="" width="100%" />

|

||||

|

||||

所有 Llama 4 模型均采用原生多模态设计,比如上传一张图像,你可以问关于这张图像的任何问题

|

||||

|

||||

|

||||

|

||||

Llama 4 Scout 支持长达 1000 万 token 的上下文,这是目前行业内最长的上下文长度,解锁了围绕记忆、个性化和多模态应用的新用例。

|

||||

|

||||

|

||||

|

||||

Llama 4 在图像 grounding 方面也是一流的,能够将用户提示与相关的视觉概念对齐,并将模型响应锚定到图像中的区域。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/dQLGATEior1zgFDU.webp" alt="" width="100%" />

|

||||

|

||||

Llama 4 还经过预训练和微调,能够理解 12 种语言的无与伦比的文本,支持全球开发和部署。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/2Xxr3oRk4SFfsGjs.webp" alt="" width="100%" />

|

||||

|

||||

**预训练**

|

||||

|

||||

Meta 在构建下一代 Llama 模型时,在预训练阶段尝试了多种新方法。

|

||||

|

||||

首先,**这是 Meta 首次采用混合专家(Mixture of Experts, MoE)架构**。在 MoE 模型中,单个 token 仅激活总参数的一部分。Meta 表示,MoE 架构在训练和推理时计算效率更高,在固定训练 FLOPs 预算下,相比密集模型提供更高的质量。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/ztQPiKKzKu4fvqP9.webp" alt="" width="100%" />

|

||||

|

||||

以 Llama 4 Maverick 模型为例,该模型拥有 170 亿激活参数和 4000 亿总参数。Meta 采用交替的密集层和混合专家(MoE)层来提高推理效率。在 MoE 层中,他们使用了 128 个路由专家和一个共享专家。每个 token 都会被发送到共享专家以及 128 个路由专家中的一个。

|

||||

|

||||

因此,尽管所有参数都存储在内存中,但在服务这些模型时,只有总参数的一部分被激活。这通过降低模型服务成本和延迟来提高推理效率 ——Llama 4 Maverick 可以在单个 NVIDIA H100 DGX 主机上运行,便于部署,也可以通过分布式推理实现最高效率。

|

||||

|

||||

Llama 4 系列模型采用原生多模态设计,通过早期融合将文本和视觉 token 无缝整合到统一的模型骨干中。早期融合是一个重大进步,因为这样能够使用大量未标记的文本、图像和视频数据对模型进行联合预训练。此外,Meta 还改进了 Llama 4 中的视觉编码器,该编码器基于 MetaCLIP,以更好地使编码器适应 LLM。

|

||||

|

||||

另外,Meta 还开发了一种新的训练技术,称为 MetaP,其能够可靠地设置模型超参数,例如每层的学习率和初始化规模。Meta 发现,选定的超参数在不同批量大小、模型宽度、深度和训练 token 值之间具有良好的迁移性。

|

||||

|

||||

Llama 4 通过在 200 种语言上进行预训练,支持开源微调工作,其中包括超过 100 种语言,每种语言都超过 10 亿 token,总体上比 Llama 3 多 10 倍的多语言 token。

|

||||

|

||||

此外,Meta 采用 FP8 精度进行训练,兼具质量并确保高 FLOPs 利用率。在使用 FP8 和 32K GPU 预训练 Llama 4 Behemoth 模型时,Meta 实现了每 GPU 390 TFLOPs。训练所用的数据混合总量超过 30 万亿 token,是 Llama 3 预训练数据混合量的两倍多,涵盖了多样化的文本、图像和视频数据集。

|

||||

|

||||

最后,Meta 还通过所谓的中期训练(mid-training)继续训练模型,提升模型核心能力,包括利用专门的数据集扩展长上下文。这使 Meta 在提升模型质量的同时,为 Llama 4 Scout 解锁了业界领先的 1000 万输入上下文长度。

|

||||

|

||||

**后训练**

|

||||

|

||||

Llama 4 Maverick 在图像和文本理解方面提供了无与伦比、行业领先的性能,能够创建跨越语言障碍的复杂人工智能应用。作为通用助手和聊天用例的产品主力模型,Llama 4 Maverick 在精确[图像理解](https://cloud.tencent.com/product/imagerecognition?from_column=20065&from=20065)和创意写作方面表现出色。

|

||||

|

||||

在对 Llama 4 Maverick 模型进行后训练时,最大的挑战是平衡多种输入模态、推理能力和对话能力。为了混合模态,Meta 设计了一种精心策划的课程策略,与单一模态专家模型相比,这种策略不会降低性能。

|

||||

|

||||

在 Llama 4 中,Meta 通过采用不同的方法对后训练流程进行了全面改进:轻量级监督微调(SFT)> 在线强化学习(RL)> 轻量级直接偏好优化(DPO)。Meta 发现,SFT 和 DPO 可能会过度约束模型,限制在线 RL 阶段的探索能力,从而导致推理、编程和数学领域的精度下降。

|

||||

|

||||

为了解决这一问题,Meta 使用 Llama 模型作为评判,移除了超过 50% 的标记为简单(easy)的数据,并在剩余较难的数据集上进行了轻量级监督微调(SFT)。在随后的多模态在线强化学习(RL)阶段,通过精心选择较难的提示,实现了性能的显著提升。

|

||||

|

||||

此外,Meta 还实施了持续在线 RL 策略,交替训练模型并使用它持续过滤并保留中等至高难度的提示。这种策略在计算和准确性权衡方面非常有益。

|

||||

|

||||

最后,Meta 还进行了轻量级直接偏好优化(DPO),以处理与模型响应质量相关的边缘情况,有效实现了模型智能与对话能力的良好平衡。这些改进促成了一个业界领先的通用聊天模型,具备最先进的智能和图像理解能力。

|

||||

|

||||

**性能**

|

||||

|

||||

Llama 4 Maverick 包含 170 亿激活参数、128 个专家和 4000 亿总参数,相比 Llama 3.3 70B,以更低的价格提供了更高的质量。由下表可知,Llama 4 Maverick 是同类中最佳的多模态模型,在编码、推理、多语言、长上下文和图像基准测试中,其性能超过了类似模型如 GPT-4o 和 Gemini 2.0,并且在编码和推理方面与规模更大的 DeepSeek v3.1 具有竞争力。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/Ilusha7l6FSYjYh8.webp" alt="" width="100%" />

|

||||

|

||||

较小模型 Llama 4 Scout 是一款通用型模型,拥有 170 亿激活参数、16 个专家和 1090 亿总参数,能够在其所属类别中提供最先进的性能。Llama 4 Scout 将支持的上下文长度从 Llama 3 的 128K 大幅提升至业界领先的 1000 万 token。这为多文档摘要、解析广泛用户活动以实现个性化任务以及推理庞大代码库等应用提供了更多可能性。

|

||||

|

||||

Llama 4 Scout 在预训练和后训练中均使用 256K 上下文长度,使基础模型具备强大的长上下文泛化能力。在大海捞针检索等任务中,该模型均展示了令人信服的结果。

|

||||

|

||||

Llama 4 架构的关键创新之一是使用无位置嵌入的交错注意力层(interleaved attention layers),并通过推理时的温度缩放来增强长上下文泛化能力。这种架构被称为 iRoPE 架构,其中 i 代表交错(interleaved)注意力层,强调其支持无限上下文长度的长期目标;RoPE 指大多数层中使用的旋转位置嵌入。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/cfCiNT5dwnYGawHq.webp" alt="" width="100%" />

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/usuVnEjcuadSu534.webp" alt="" width="100%" />

|

||||

|

||||

Meta 对两款模型进行了广泛的图像和视频帧静止图像训练,以赋予它们广泛的视觉理解能力,包括对时序活动及相关图像的理解。这使得模型能够在多图像输入和文本提示下轻松进行视觉推理和理解任务。这些模型在预训练时最多支持 48 张图像,并且在后训练中可以支持 8 张图像,结果良好。

|

||||

|

||||

Llama 4 Scout 在图像定位方面表现卓越,能够将用户提示与相关视觉概念对齐,并将模型响应锚定到图像中的特定区域。这使得大型语言模型能够更精确地进行视觉问答,更好地理解用户意图并定位感兴趣的对象。

|

||||

|

||||

此外,Llama 4 Scout 在编码、推理、长上下文和图像基准测试中超越了类似模型,并且比所有之前的 Llama 模型表现更强。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/nf0J197YjWF8yk7A.webp" alt="" width="100%" />

|

||||

|

||||

**将 Llama 推向新的尺度:2T Behemoth**

|

||||

|

||||

Llama 4 Behemoth 预览版是一个教师模型,也是一个多模态混合专家模型,拥有 2880 亿激活参数、16 个专家和近 2 万亿总参数。

|

||||

|

||||

在数学、多语言和图像基准测试中,它提供了非推理模型的最先进性能,是教授较小 Llama 4 模型的完美选择。

|

||||

|

||||

<img src="https://pic.code-nav.cn/post_picture/1619930914211520514/hUTxkLXhkdIsWyHW.webp" alt="" width="100%" />

|

||||

|

||||

对一个拥有两万亿参数的模型进行后训练是一个巨大的挑战,这要求研究者从数据规模开始,彻底重新设计和改进训练方案。为了最大化性能,Meta 不得不对监督微调(SFT)数据进行 95% 的剪枝,而较小模型的剪枝比例为 50%。这一举措是为了在质量和效率上取得必要的平衡。Meta 还发现,先进行轻量级监督微调(SFT),再进行大规模强化学习(RL),能够显著提升模型的推理和编码能力。

|

||||

|

||||

Meta 的强化学习(RL)方案专注于通过策略模型进行 pass@k 分析,采样难度较高的提示,并构建难度逐渐增加的训练课程。此外,在训练过程中动态过滤掉零优势的提示,并构建包含多种能力的混合提示训练批次,这些措施在数学、推理和编码方面为模型带来了显著的性能提升。最后,从多种系统指令中采样对于确保模型在推理和编码任务中保持指令遵循能力至关重要,这使得模型能够在多种任务中表现出色。

|

||||

|

||||

为两万亿参数的模型扩展强化学习(RL)也是一项巨大的挑战,这迫使 Meta 不得不重新设计并改进底层的强化学习基础设施,以应对前所未有的规模。

|

||||

|

||||

Meta 对混合专家(MoE)并行化的设计进行了优化,以提升速度,从而加快迭代过程。此外,他们还开发了一个完全异步的在线强化学习训练框架,增强了灵活性。与现有的分布式训练框架相比,后者为了将所有模型加载到内存中而牺牲了计算内存,Meta 的新基础设施能够灵活地将不同模型分配到不同的 GPU 上,并根据计算速度在多个模型之间平衡资源。这一创新使得训练效率相比上一代提升了约 10 倍。

|

||||

|

||||

Llama 4 Scout 和 Llama 4 Maverick 现已开放下载,地址:

|

||||

|

||||

- llama.com:https://www.llama.com/llama-downloads/

|

||||

- Hugging Face 地址:https://huggingface.co/meta-llama

|

||||

|

||||

_参考链接:https://ai.meta.com/blog/llama-4-multimodal-intelligence/_

|

||||

|

||||

> 来源:机器之心

|

||||

@@ -0,0 +1,40 @@

|

||||

## Shopify 新标准:将 AI 融入日常工作,已是基本要求

|

||||

|

||||

今天 Shopify CEO Tobi Lütke 的一封被曝光的内部邮件很流行,Tobi 要把拥抱 AI 变成 Shopify 的文化基因,不仅是要求所有公司员工学习 AI,还需要在日常工作中应用 AI,甚至将 AI 的应用计入了绩效考核,**部门若想申请更多招聘名额和资源,需先证明他们的工作不能被 AI 替代**;同时 AI 必须是“完成任务原型阶段”(GSD Prototype phase)的核心工具,也就是说以前可能需要人工去制作原型,现在都要尽可能使用 AI 来完成。

|

||||

|

||||

> **背景说明:** 这是 Shopify 的一份内部备忘录。因为发现它正在被泄露,并且(很可能)会被断章取义地传播,所以我选择在这里公开分享。

|

||||

|

||||

**正文:**

|

||||

|

||||

团队伙伴们:

|

||||

|

||||

我们正迈入一个激动人心的时代,一个有望诞生比历史上任何时期都更多商家和创业者的时代。我们常说要“拉平复杂曲线”,让更多人能选择创业作为自己的事业。但在创业的每一步,都充满了需要技巧、判断和知识的决策。如今,有人工智能(AI)一路相伴,并且越来越多地不仅提供咨询建议,甚至能直接为我们的商家完成具体工作——这绝对是一个令人震撼的、阶跃式的巨大变革。

|

||||

|

||||

我们在 Shopify 的核心任务,就是确保我们的软件平台是无可争议的最佳“画布”,让未来的卓越企业能在这上面尽情挥洒、蓬勃发展。要做到这一点,我们就必须让团队始终站在最前沿,掌握并运用所有最顶尖的工具,从而帮助我们的商家取得他们过去甚至无法想象的成功。为此,我们自己必须绝对领先。

|

||||

|

||||

**将 AI 融入日常工作(Reflexive AI usage),现已成为 Shopify 的基本要求**

|

||||

|

||||

也许你早已习惯使用 AI,觉得这份备忘录有点多余。若是如此,那说明你已经将 AI 当作了你的思维伙伴、深度研究员、批判性顾问、私人导师,或是编程助手。我自己就一直在用,但即便如此,我仍感觉自己只是触及了皮毛。这是我职业生涯中所见过的、对工作方式影响最快、最剧烈的转变。我对它的热情也毫不掩饰:你们在我的周度视频、播客、全体会议,以及……峰会上都听我谈论过 AI!去年夏天,我甚至 使用 AI 智能体(agents)来准备我的演讲稿,并分享了这一过程。我这样做,是想号召和邀请每一个人都去动手尝试 AI,打消任何关于“AI 是否真的在各个层面都至关重要”的疑虑或困惑。许多伙伴响应了号召,而我们所有尝试过的人,都对 AI 能够增强我们的技能、提升我们的技艺、弥补我们不足的强大新能力和工具感到无比惊叹。

|

||||

|

||||

到目前为止,我们学到的重要一点是:**高效运用 AI 是一项需要通过大量实践来刻意培养的技能。** 它和我们以往使用的任何工具都太不一样了。之前号召大家去“尝试”是对的,但那更像是一个建议,力度还不够。这就是我今天想要改变的。我们还发现,与大多数工具不同,AI 扮演着“放大器”的角色。我们很幸运能与许多优秀的同事共事,他们能创造出以往认为不可能达到的 10 倍价值。这是我最喜欢这家公司的地方。而更令人惊奇的是,我们第一次看到,工具本身也具备了 10 倍的潜力。我亲眼看到许多人用一种近乎本能且极其聪明的方式运用 AI,去 tackling 那些我们以前甚至不会考虑去碰的、看似不可能完成的任务,最终完成了相当于过去 100 倍的工作量。

|

||||

|

||||

几年前,在我的《关于领导力》(On Leadership) 备忘录中,我引用《爱丽丝梦游仙境》的故事,将 Shopify 比作一场“红皇后赛跑”——你必须不停奔跑,才能保持在原地。在一个每年增长 20-40% 的公司里,你每年至少也需要提升同样的比率,才能仅仅保住自己的位置。这对我适用,对其他每一个人也同样适用。

|

||||

|

||||

这听起来可能令人生畏,但考虑到我们现在拥有的 AI 工具的特性,这对我来说甚至不再显得那么野心勃勃了。同时,这也正是我们的顶尖人才告诉我们他们所渴望的那种环境:**大家一起学习,周围都是同样在个人成长道路上不断前行的人,共同致力于解决有价值、有意义且富有挑战性的难题**——这恰恰是 Shopify 创立之初就旨在提供的环境。这既代表着机遇,也代表着要求,与我们“持续学习”(Be a Constant Learner)和“拥抱变化”(Thrive on Change)的核心价值观深度契合。这些不仅仅是口号,而是成为这个世界级团队一员的基本期望。这就是我们创始人想要的,也是我们所构建的。

|

||||

|

||||

## 这意味着什么?

|

||||

|

||||

1. **有效运用 AI 现已成为 Shopify 每个人的基本期望。** 它如今是适用于所有岗位的工具,并且只会越来越重要。坦白说,我不认为在你的专业领域里,你可以选择不去学习如何应用 AI;你可以试试看,但我想实话实说,我看不出这在今天行得通,明天就更不用说了。**停滞不前几乎是必然的,而停滞就是温水煮青蛙式的失败。如果你不向上攀登,那你就在向下滑落。**

|

||||

2. **AI 必须是你 GSD(Get Stuff Done,搞定事情)项目原型阶段的核心。** 任何 GSD 项目的原型设计阶段,都应该以 AI 探索为主导。原型设计的目的是学习和创造信息。AI 能极大地加速这个过程。你可以在远比过去短得多的时间内,学会制作出能让其他团队成员看到、使用并进行讨论的东西。

|

||||

3. **我们将在绩效评估和同事互评问卷中加入关于 AI 使用的问题。** 学会高效使用 AI 是一项不易掌握的技能。我的感觉是,很多人在写了一个提示词(prompt)却没有立刻得到理想结果后就放弃了。学习如何提问、如何提供上下文信息非常重要,而让同事就此提供反馈将会非常有价值。

|

||||

4. **学习是自主的,但要分享你学到的东西。** 你可以使用尽可能多的前沿 AI 工具。我们已经有了运行多年的 [chat.shopify.io](http://chat.shopify.io/)。开发者们有 [proxy](https://proxy.shopify.ai/)、Copilot、Cursor、Claude code 等等,都已经预先配置好,随时可用。我们将作为一个团队共同学习和适应。在试验新的 AI 能力时,我们会互相分享成功经验(Ws)和失败教训(Ls!)。我们会在月度业务回顾和产品开发周期中专门安排时间讨论 AI 整合。Slack 和内部知识库(Vault)上有很多地方,大家会分享自己琢磨出来的提示词,比如 `#revenue-ai-use-cases` 和 `#ai-centaurs` 频道。

|

||||

5. **在申请增加人手和资源之前,团队必须先说明为什么无法利用 AI 来完成目标。** 试想一下:如果自主运行的 AI 智能体(autonomous AI agents)已经是团队的一员,这个领域会是什么样子?这个问题能引发非常有趣的讨论和项目构想。

|

||||

6. **“每个人”就是指“每一个人”。** 这条规则适用于我们所有人——包括我和高管团队。

|

||||

|

||||

## 前进之路

|

||||

|

||||

AI 将彻底改变 Shopify,改变我们的工作方式,乃至我们生活的方方面面。我们对此全力以赴!我想不出还有比在这里更能亲身参与这场真正史无前例变革的地方了。你不仅能获得前排看戏的座位,更是身处一个全公司都在共同学习、共同推动进步的环境之中。

|

||||

|

||||

我们的工作,是去探索在一个 AI 无处不在的世界里,创业会是什么样子。我希望我们能把这件事做到极致。要实现这个目标,我需要每个人的帮助。我已经规划了今年主题中大量的 AI 项目——我们的路线图是清晰的,我们的产品将更好地契合我们的使命。**要取得成功,我们需要的是我们所有人运用自身技艺的集体智慧和雄心,再乘以 AI 的力量,最终造福我们的商家。**

|

||||

|

||||

> 来源:宝玉的分享

|

||||

@@ -0,0 +1,113 @@

|

||||

## 《聪明的机器,复杂的人心》,斯坦福 AI 报告 2025 年版的 12 个信号

|

||||

|

||||

斯坦福出了最新的 AI 报告,我们一起来看一下核心思想,或者会给我们新的启示...如果你对 AI 感兴趣、但不想啃上百页的英文报告,这篇总结可以帮你 10 分钟看懂[《斯坦福 AI 指数 2025》](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=%E3%80%8A%E6%96%AF%E5%9D%A6%E7%A6%8FAI%E6%8C%87%E6%95%B02025%E3%80%8B&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiLjgIrmlq_lnabnpo9BSeaMh-aVsDIwMjXjgIsiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYyNTk2MTEsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.pl0UeMjJWmqivQ7JjQuJmyoVs_98vo1X7YIW9e5pM40&zhida_source=entity)。

|

||||

|

||||

|

||||

|

||||

## 一句话:

|

||||

|

||||

AI 从“未来技术”彻底变成了“当下系统”。它不仅影响工作和生活,还在重塑教育、治理、信任乃至能源结构。

|

||||

|

||||

### 01 | AI,不再是“遥远未来”的科技词

|

||||

|

||||

斯坦福刚发布的《2025 年 AI 指数报告》用一连串令人咋舌的数据告诉我们:AI 不只是“有用”,它正成为社会结构的一部分。

|

||||

|

||||

比如,美国在 2024 年对 AI 的私人投资达到 1091 亿美元,是中国的近 12 倍。而 AI 驱动的医疗设备,仅 2023 年一年,美国 FDA 就批准了 223 种。这不是趋势,这是浪潮。

|

||||

|

||||

### 02 |从写代码到看病,AI 表现越来越像“专家”

|

||||

|

||||

这一年,AI 在很多能力测试中“超神”了。比如,在国际数学奥林匹克模拟考试中,[OpenAI](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=OpenAI&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJPcGVuQUkiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYyNTk2MTEsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.fkknh4I7lJdmxNLdhyBk77f8Rf7BJjUWe-uqc0FHIHM&zhida_source=entity)的新模型得了 74.4% 的高分,而[GPT-4](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=GPT-4&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJHUFQtNCIsInpoaWRhX3NvdXJjZSI6ImVudGl0eSIsImNvbnRlbnRfaWQiOjI1NjI1OTYxMSwiY29udGVudF90eXBlIjoiQXJ0aWNsZSIsIm1hdGNoX29yZGVyIjoxLCJ6ZF90b2tlbiI6bnVsbH0.I8Pq3WOlL4fSBzMZGp6fdhZrkQgN-N_fpFsU8k9imjA&zhida_source=entity)o 只有 9.3%。甚至还有 AI 在编程任务中比专业程序员更快更准。

|

||||

|

||||

医学领域也不例外。GPT-4 在多个临床诊断任务中超过了人类医生,包括癌症识别和高危病人预警——听起来有点让人后背发凉对吧?但研究还发现,人机协作效果更好,这可能才是未来的常态。

|

||||

|

||||

### 03 |便宜、快、全球可用——AI 的“平民化”时代来了

|

||||

|

||||

过去,运行一个像 GPT-3.5 那样的模型,每处理 100 万个词,要花 20 美元;现在,最新的开源模型只要 7 美分,整整便宜了 280 多倍!

|

||||

|

||||

也就是说,越来越多的小公司、初创团队,甚至学生个人,也有机会用上高性能 AI。这种“民主化”的技术扩散,不仅降低了门槛,也加快了全球 AI 竞赛的节奏。

|

||||

|

||||

但你有没有想过:当 AI“谁都能用”的那天来临,我们是否也该重新思考“谁来负责”?

|

||||

|

||||

### 04 |“高质量模型”越来越多,AI 的天花板在哪里?

|

||||

|

||||

2024 年,全球有 90% 的先进 AI 模型来自企业。你没看错,不是大学实验室,不是国家研究院,而是 OpenAI、Google、Meta 这些科技巨头。学术界则在产出“最有影响力”的研究文章方面依然独占鳌头。

|

||||

|

||||

这背后是疯狂的资金投入,也是令人侧目的“卷”。AI 模型每 5 个月就要翻倍地扩展计算规模,数据量每 8 个月翻一轮。说得俗点:这是用电、用钱、用数据堆出来的“超级聪明脑”。

|

||||

|

||||

问题来了:模型越来越强,谁来设定边界?谁来负责用它的人?

|

||||

|

||||

---

|

||||

|

||||

### 05 |开源模型崛起:从“吊车尾”到“直逼头部玩家”

|

||||

|

||||

去年的报告还在说:开源 AI 落后于封闭模型。可今年,差距就缩小到不到 2%。这意味着,哪怕你不是大厂工程师,也有可能调教出一个性能媲美 GPT-4 的小模型。

|

||||

|

||||

而这件事最打动我的,是一种“权力的再分配”:技术不再被少数人掌控。开源不仅意味着人人可用,更可能是一种透明、审慎且民主的科技实践。

|

||||

|

||||

当然,问题也随之而来:谁来审核这些模型?一旦被滥用,怎么办?

|

||||

|

||||

---

|

||||

|

||||

### 06 |“AI 事故”正在增多,但“责任”仍然模糊

|

||||

|

||||

2024 年被记录在案的 AI 相关事故达到 233 起,比上一年增长了 56%。而且,几乎没有统一的“责任认定机制”。

|

||||

|

||||

你会发现一个吊诡的现象:企业一边在大谈“负责任的 AI”,一边却很少真正在模型发布前做安全测试。新的[RAI](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=RAI&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJSQUkiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYyNTk2MTEsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.p1coxHdQjho0ARBQTx50O-KonlYsHXuzIdyys1bkk54&zhida_source=entity)(负责任 AI)评估标准虽然不断推出,比如[HELM Safety](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=HELM+Safety&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJIRUxNIFNhZmV0eSIsInpoaWRhX3NvdXJjZSI6ImVudGl0eSIsImNvbnRlbnRfaWQiOjI1NjI1OTYxMSwiY29udGVudF90eXBlIjoiQXJ0aWNsZSIsIm1hdGNoX29yZGVyIjoxLCJ6ZF90b2tlbiI6bnVsbH0.Y_uyAnzspswEoQeNFxdLgaDiTchoBgDjcVn6L4JmsKc&zhida_source=entity)和[FACTS](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=FACTS&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJGQUNUUyIsInpoaWRhX3NvdXJjZSI6ImVudGl0eSIsImNvbnRlbnRfaWQiOjI1NjI1OTYxMSwiY29udGVudF90eXBlIjoiQXJ0aWNsZSIsIm1hdGNoX29yZGVyIjoxLCJ6ZF90b2tlbiI6bnVsbH0.x9Q7ZyW5fc0IHGiLARVRToXHT7zpKXl7mNI-hgsQwY4&zhida_source=entity),但使用它们的机构寥寥无几。

|

||||

|

||||

是不是听起来有点像小时候老师说“安全第一”,可我们却从没上过一节真正的安全教育课?

|

||||

|

||||

### 07 | AI+ 科学:诺奖得主都开始站台了

|

||||

|

||||

过去一年,AI 在科学界可谓风光无限:不仅两个诺贝尔奖都颁给了 AI 相关研究者(一个是神经网络理论,一个是蛋白质折叠预测),OpenAI 还推出了能“做实验”的 AI 助手。

|

||||

|

||||

科学家用 AI 筛药、预测森林火灾,甚至连蛋白质数据库都增长了数倍。医学上,AI 生成的“合成数据”也被用来保护隐私、改善预测、加速药物研发。

|

||||

|

||||

听起来很炫对吧?但我总觉得这背后有种不安——如果 AI 变成实验室的“新老板”,我们是否还保有足够的判断力?

|

||||

|

||||

---

|

||||

|

||||

### 08 | AI 教育大飞越,也暴露了巨大“认知缺口”

|

||||

|

||||

全球已经有 2/3 的国家将计算机科学教育纳入中小学课程。但你知道吗?在非洲,很多学校连稳定供电都没有;在美国,尽管 81% 的 CS 老师认为应该教 AI,真正有信心教的却不到一半。

|

||||

|

||||

这不是“AI 教得够不够”,而是“人有没有准备好”的问题。我们花了几十年建立的教育体系,似乎被 AI 轻轻一推就乱了阵脚。

|

||||

|

||||

教育的反应,总是比技术慢半拍。而这一拍,很可能决定了一代人的“信息权”。

|

||||

|

||||

---

|

||||

|

||||

### 09 |普通人对 AI 的感受,远比你以为的复杂

|

||||

|

||||

斯坦福的报告统计了 26 个国家对 AI 的态度:中国、印尼、泰国的乐观比例超过 77%,而美加英这些科技强国,竟然只有三成多的民众觉得 AI 是“利大于弊”。

|

||||

|

||||

这不是谁更聪明,而是谁更担心失控。发达国家看多了深度伪造、数据泄露,也更敏感“透明与公平”;而发展中国家更关注“能不能用上”,看重效率与机会。

|

||||

|

||||

AI 就像水银:你掌握得越多,越容易察觉它的流动不受控制。

|

||||

|

||||

### 10 |当 AI 比你“还像人”,我们该如何自处?

|

||||

|

||||

AI 已经在多项任务中超过人类,但讽刺的是,它在最基础的“复杂推理”上却屡屡出错。像 PlanBench 这种逻辑题,AI 依旧常常“翻车”。

|

||||

|

||||

为什么?或许因为 AI 并没有“理解”,它只是在预测。它能背诵千本书,但不一定能解决一个现实生活的“多选题”。

|

||||

|

||||

所以问题来了:**当 AI 越来越像人,我们会不会反而失去对“人”的珍惜?**

|

||||

|

||||

### 11 | AI 治理:各国都在“加快立规”,但方向各异

|

||||

|

||||

2024 年,全球共有 75 个国家在立法中提到 AI,比上一年增长 21.3%。美国联邦出台了 59 条 AI 相关法规,比 2023 年翻了一倍;中国、法国、沙特、印度都分别斥巨资建立国家 AI 基础设施。

|

||||

|

||||

但问题在于:这些法规和策略,彼此之间缺乏统一标准。比如对“深度伪造”的定义、AI 透明度的要求、训练数据的合规性……都五花八门。

|

||||

|

||||

就像各国都在建高速公路,却没人商量“靠右开还是靠左开”。

|

||||

|

||||

---

|

||||

|

||||

### 12 |能源焦虑浮出水面:AI 越来越“烧电”,环保压力爆表

|

||||

|

||||

你可能想不到,训练 GPT-4 这种大型模型,碳排放是 5884 吨——相当于一个美国人 300 年的排放量。

|

||||

|

||||

而 2024 年发布的[Llama 3.1](https://zhida.zhihu.com/search?content_id=256259611&content_type=Article&match_order=1&q=Llama+3.1&zd_token=eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJpc3MiOiJ6aGlkYV9zZXJ2ZXIiLCJleHAiOjE3NDQ1NDYwODUsInEiOiJMbGFtYSAzLjEiLCJ6aGlkYV9zb3VyY2UiOiJlbnRpdHkiLCJjb250ZW50X2lkIjoyNTYyNTk2MTEsImNvbnRlbnRfdHlwZSI6IkFydGljbGUiLCJtYXRjaF9vcmRlciI6MSwiemRfdG9rZW4iOm51bGx9.f2GW6PO52YLfKCYZrZEiOjz8UAlDyhudyHOsTOt9VE8&zhida_source=entity)(405B 参数)排放更是高达 8930 吨!这一趋势正在引起全球科技公司的“能源恐慌”:微软甚至宣布重启废弃核电站来供电;谷歌、亚马逊也在抢购清洁能源项目。

|

||||

|

||||

AI 技术虽然“轻盈灵巧”,但背后可能是巨大的能源账单。**当 AI 越来越“绿色难保”,我们是否也要重新思考:进步的代价究竟该由谁来买单?**

|

||||

|

||||

> 来源:知乎

|

||||

@@ -0,0 +1,121 @@

|

||||

## 一张照片生成连贯全片!Runway Gen4 深夜发布,终于捅破 AI 视频多年的天花板

|

||||

|

||||

|

||||

|

||||

「深度思考」成为模型的标配,Manus 这样会干活的 Agent 也开始介入我们的工作流,GPT-4o 的生图功能让每个人都能作出媲美专业的的风格。

|

||||

|

||||

今天凌晨,Runway 的新版本 Gen-4 又试图解决 AI 视频的一个关键难题,让 AI 视频更靠近电影级。

|

||||

|

||||

这一切都只发生在短短的 2 个多月内,很难想象今年 AI 会发展到什么程度,或许今年将会是 GPT-3.5 后真正的 AI 爆发年。

|

||||

|

||||

这是一个导演酝酿了十余年却始终未能用 AI 实现的故事。

|

||||

|

||||

在此之前,要用 AI 打造这部视频,需攻克一系列难题:角色形象的连贯性、情感表达的细腻度、物理效果的真实感、叙事的连续性,以及整体风格的统一性。

|

||||

|

||||

直到老牌 AI 视频生成巨头最新模型 Runway Gen-4 的到来,这款号称全球首款实现「世界一致性」的模型横空出世,意味着用户可以创建具有一致环境、物体、位置和角色的连贯世界,才让导演的梦想照进现实。

|

||||

|

||||

现在 Runway Gen-4 已向所有付费用户和企业客户开放。Runway 团队还透露,用于角色、位置和物体一致性的场景参考功能即将推出。

|

||||

|

||||

官网显示,Gen-4 的核心亮点包括:

|

||||

|

||||

世界一致性:能在多个场景中保持人物、场景和物体的一致性,无需额外精调。

|

||||

|

||||

参考图能力:仅凭一张参考图,即可在不同光线和场景中生成一致的角色或物体。

|

||||

|

||||

场景覆盖:从任意角度重建和捕捉场景,只需提供参考图和描述。

|

||||

|

||||

物理效果:模拟真实世界物理规律,呈现逼真的光照、阴影和动态效果。

|

||||

|

||||

视频质量:具备极强的提示理解能力和世界构建能力。

|

||||

|

||||

生成式视觉特效:提供快速、可控的视频特效,可与实拍和传统特效无缝融合。

|

||||

|

||||

|

||||

|

||||

Runway 联合创始人兼 CEO Cristóbal Valenzuela Barrera 在 X 平台发文称:

|

||||

|

||||

**我们新一代用于媒体生成与世界一致性的 AI 模型系列来了。欢迎 Gen-4 的到来。这个模型非常特别,我们从零开始完全为一个目标打造它:讲述精彩的故事。**

|

||||

|

||||

如开篇所说,Gen-4 的最大亮点在于实现了「世界一致性」——能够在多个场景中精准生成人物、场景和物体,并保持其视觉特征的一致性。

|

||||

|

||||

用户只需设定好整体风格和视觉效果,模型就能在保持每一帧独特风格、氛围和电影质感的同时,维持连贯的世界环境。而这一切无需精调或额外训练。

|

||||

|

||||

通过结合视觉参考和文字指令,Gen-4 能够生成风格、主题、场景高度一致的图像和视频,大幅简化了专业内容创作的流程,用户现在可以制作 5 秒和 10 秒的 720p 高清视频片段。

|

||||

|

||||

为了展现 Gen-4 的潜力,Runway 团队精心打造了一系列短片。

|

||||

|

||||

开场镜头设定了《The Lonely Little Flame》整个短片的基调、感觉和氛围。在其中一个场景中,有一只臭鼬在寻找什么东西。借助 Gen 4,创作者可以直接指导主体穿越场景。

|

||||

|

||||

他们为臭鼬设定了两个关键标记点,精确控制其移动路径——先移动到场景一侧,再折返回来,成功营造出「寻找」的动态感。

|

||||

|

||||

|

||||

|

||||

「就像所有伟大的动画一样,你可以在角色设计和场景移动中看到丰富的表现力,」团队成员解释道,「同一角色在不同场景、不同光照条件下保持一致性,同时能够表现不同的情绪和动作。」

|

||||

|

||||

为了制作这个片段,Runway 团队的一名成员在几个小时内生成了几百个单独的视频片段,然后将它们编辑成一个连贯的片段。音效是另外添加的。

|

||||

|

||||

在接受彭博社的采访时,Runway 联合创始人兼 CEO Cristóbal Valenzuela Barrera 表示,整个过程花了几天时间。

|

||||

|

||||

传统的视觉特效制作往往需要耗费大量时间进行建模、渲染和后期调整,Runway Gen-4 引入生成式视觉特效(GVFX)技术,能够通过 AI 驱动的生成能力,大幅缩短了这一过程。

|

||||

|

||||

GVFX 的技术核心在于其高效性和适应性。

|

||||

|

||||

用户只需提供简单的视觉参考或文字描述,例如角色的动作、场景的氛围或特定的特效需求,Gen-4 便能在短时间内生成高质量的视频片段。

|

||||

|

||||

|

||||

|

||||

一个具体的应用案例是 Runway 团队在演示中展示的「木制玩具」场景。

|

||||

|

||||

Runway 团队成员拿出一个木制玩具,用手机拍摄照片后导入 Gen-4 作为参考,同时上传了此前拍摄的纽约街景作为背景。通过一句简单描述:「木制玩具靠在纽约街道的人行道旁」,Gen-4 迅速生成了四张图像。

|

||||

|

||||

挑选其中一张,挑选一张,并为画面添加了行人从玩具前走过的动画效果。「你可以将这个玩具放在任何地方——山脉中、沙漠里,基本上你想做什么都可以。」

|

||||

|

||||

|

||||

|

||||

《牛群》是一部扣人心弦短片,讲述了一名年轻男子在夜晚被追赶穿越一片牛群的故事。仅凭 Gen-4 和几张简单的图像参考,Runway 团队构建了角色的每个镜头以及雾气弥漫的牛群场景。

|

||||

|

||||

与此同时,Runway 还运用了 Act-One 技术,进一步增强了画面的表现力与连贯性。

|

||||

|

||||

在这部短片中,制作团队特别强调了两大技术亮点:在牛的眼睛中可以看到人物的倒影,以及火焰在草地上蔓延的逼真物理效果。

|

||||

|

||||

这个案例展现了 Gen-4 如何利用一致的角色、物体和环境贯穿多个场景。创作者可以从一个精心设计的角色入手,构建氛围与外观,再生成全新图像,并为不同镜头和视角提供多样变化。

|

||||

|

||||

|

||||

|

||||

Gen-4 对现实物理世界的理解达到了新高度。

|

||||

|

||||

《纽约》短片将纽约不同区域的真实照片结合动物的真实照片,清晰地展示了 Gen-4 对物理、动物重量、它们如何在表面移动以及与环境互动方式的理解。

|

||||

|

||||

|

||||

|

||||

复杂的创意作品往往从一个简单的构想开始。

|

||||

|

||||

视频创作的过程也能像滚雪球一样逐渐壮大,Runway 团队以一个音乐视频为例,最初只是一张普普通通的猴子图像,最终发展成一部内容丰富、节奏紧凑的完整音乐视频。

|

||||

|

||||

Runway CEO 去年曾做出过一个重要论断,「**AI 正在成为像电力或互联网一样的基础设施。在今天称自己为 AI 公司,就像在 2024 年称自己为互联网公司一样。这没有意义,因为人人都在用 —— 每家公司都使用互联网;每家公司都将使用 AI。**」

|

||||

|

||||

正如电力革命不是关于发电厂,而是关于电灯、电视和电冰箱如何改变生活。在他看来,Runway 不是一家 AI 公司,而是一家媒体和娱乐公司。

|

||||

|

||||

Runway 此前已为美剧《大卫王朝》(House of David)生成影视场景,以及为 Puma 制作广告等。

|

||||

|

||||

影视行业一直是 AI 视频生成工具攻坚的重要一环。去年 9 月,Runway 与著名电影制作公司狮门影业(Lionsgate)达成合作,这是首个大型电影公司与 AI 视频模型供应商直接签订的协议。

|

||||

|

||||

Runway 将利用狮门影业超过两万部影视作品的资料库,包括《饥饿游戏》等知名影片,构建一个定制的 AI 视频制作和编辑模型。该模型将应用于故事板制作、背景创建和特效制作。

|

||||

|

||||

一支好的钢笔不会让作家思考墨水流动的物理原理,优秀的 AI 创作工具也不应让导演分心于算法细节。

|

||||

|

||||

|

||||

|

||||

Valenzuela 也指出,公司在训练其模型时,更多地参考了电影行业的术语,而不是过去的方式,目的是让使用该模型的电影制作人在编写提示时能够更加自然。

|

||||

|

||||

我们后续将带来 Gen-4 具体的实测,但无论此次实际效果如何,一个不争的趋势是,生成 AI 视频生成工具正在颠覆我们所知的电影和电视行业。

|

||||

|

||||

梦工场的联合创始人杰弗里·卡森伯格甚至表示,AI 可能会消灭动画电影 90% 的岗位。

|

||||

|

||||

传统动画制作流程中的许多环节——中间帧绘制、背景设计、着色润色——可能被 AI 大幅简化或取代。但与此同时,新的专业岗位正在涌现,AI 提示工程师、视觉开发总监、AI-人类协作编导等角色未来也将出现在制作名单中。

|

||||

|

||||

能够渲染视频,实现基础生成功能——这是当前 AI 视频技术的普遍水平,而在 Runway Gen-4 此次的宣传中,**则强调 AI 能够创作真实故事,制作出既美观又有娱乐性,能够引起情感共鸣的内容。**

|

||||

|

||||

或许只有当工具变得足够简单,创作者才能真正关注重要的事情——讲述触动人心的故事。

|

||||

|

||||

> 来源:APPSO | 36kr

|

||||

@@ -0,0 +1,174 @@

|

||||

## 实测:阿里云百炼上线「全周期 MCP 服务」,AI 工具一站式托管

|

||||

|

||||

长话短说:

|

||||

|

||||

今天,**阿里云百炼正式上线了 MCP(Model Context Protocol)服务的完整平台能力**,覆盖从服务注册、云托管,到 Agent 调用、流程组合的全生命周期。

|

||||

|

||||

|

||||

|

||||

https://bailian.console.aliyun.com/

|

||||

|

||||

很不错!这事儿算是一个转变:**工具调用,不再是模型厂的「私有功能」**,而是被抽象为一种通用能力,并具备了完整的产品形态。

|

||||

|

||||

> 换句话说

|

||||

>

|

||||

> 百炼把 MCP Client 和 MCP Server 封在了一起,放在了 MAAS 上

|

||||

|

||||

于是,第一时间我上手试了试,本文也会顺着讲清楚三件事:

|

||||

|

||||

1. 1\. 这套 MCP 服务,能做什么?

|

||||

2. 2\. 怎么用?

|

||||

3. 3\. 和 Plugin 有什么区别?

|

||||

|

||||

---

|

||||

|

||||

## 01 | MCP 能干啥

|

||||

|

||||

这里我测了两个典型的 Agent 例子,分别是「导航推荐助手」和「网页抓取助手」。

|

||||

|

||||

|

||||

|

||||

在百炼上,可以通过多种方式,构建 Agent

|

||||

|

||||

### 单 MCP 调用:高德地图 + AI 导游

|

||||

|

||||

这是一个简单的智能体应用,目标是:**根据用户的旅行目的地,生成当天的城市游推荐方案,并串联天气、位置、美食和导航任务。**

|

||||

|

||||

整个过程没有写代码,只是在百炼广场上开通高德地图(Amap Maps)的 MCP 服务,然后在「创建智能体应用」后,拉取这个 MCP 服务。

|

||||

|

||||

下面的视频是原速,可以感受下:

|

||||

|

||||

输入一个城市,比如“西安”,Agent 会自动:

|

||||

|

||||

1. 1\. 查询当天西安天气

|

||||

2. 2\. 基于定位列出附近的景点、餐饮店

|

||||

3. 3\. 安排出行路径(如骑行/地铁)

|

||||

4. 4\. 给出推荐行程描述和地图跳转链接

|

||||

|

||||

整个任务链由 Agent 自动执行,所有服务来自百炼托管的 MCP 接口,无需我们部署服务器、写 API 代码或解析参数文档。

|

||||

|

||||

---

|

||||

|

||||

### 多 MCP 调用:网页抓取 + 数据生成

|

||||

|

||||

这是一个稍微复杂的 Case,通过构建工作流,让 AI 帮我取抓取网页,然后进行页面提取,最后保存在 Notion 里。

|

||||

|

||||

从流程上来说,就是

|

||||

|

||||

1. 1\. 大模型识别对话中的 URL

|

||||

2. 2\. 通过 Firecrawl 抓取这个页面的信息

|

||||

3. 3\. 通过大模型对信息进行总结

|

||||

4. 4\. 将总结后的信息,上传到 Notion

|

||||

|

||||

这一套工具链同样通过 MCP 服务构建,串联了「Firecrawl」、大模型本身的处理,以及「Notion」等多个内容,全部可复用、可组合,也不依赖特定模型。

|

||||

|

||||

---

|

||||

|

||||

## 02 |百炼上的 MCP 怎么用?

|

||||

|

||||

在百炼 MCP 平台上,开发者可以通过两种方式使用 MCP 服务。

|

||||

|

||||

地址在这里:https://bailian.console.aliyun.com/?tab=app#/mcp-manage

|

||||

|

||||

### 第一种:直接用官方托管服务(选服务)

|

||||

|

||||

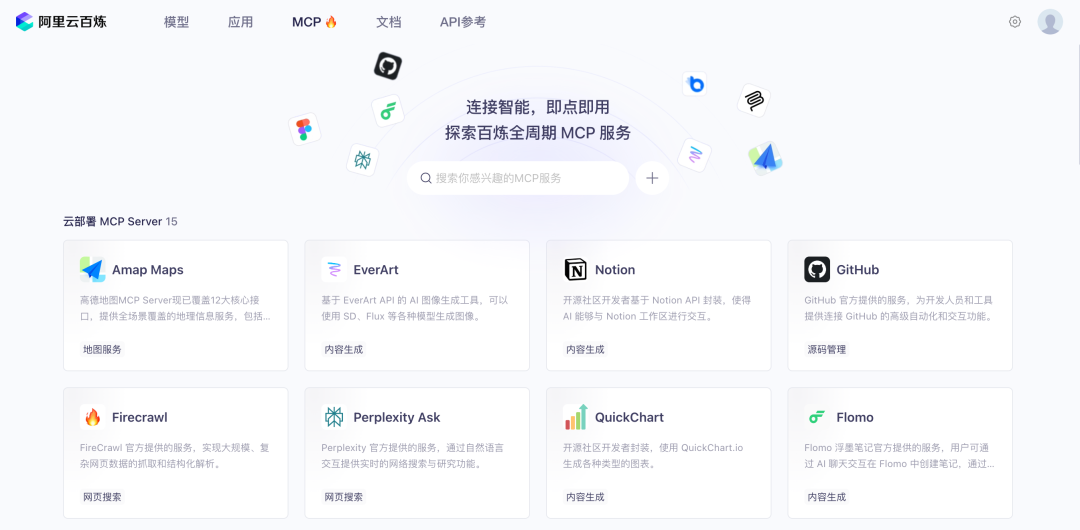

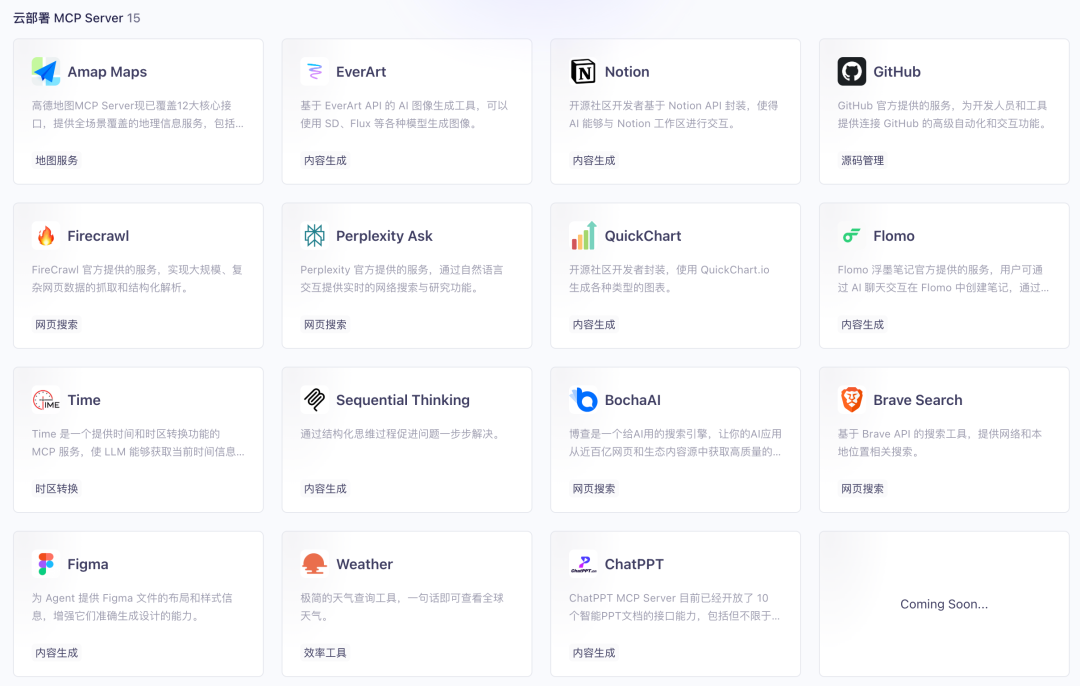

目前,百炼已经上线了 15 款 MCP 的云服务,并提供了 61 款社区 MCP 的介绍,更多的还在路上。

|

||||

|

||||

|

||||

|

||||

以上服务已部署,更多服务在路上

|

||||

|

||||

|

||||

|

||||

这些都是社区 MCP

|

||||

|

||||

这种方式适合绝大多数场景,几乎“零门槛”:

|

||||

|

||||

1. 1\. 打开 MCP 服务广场

|

||||

2. 2\. 找到你需要的服务(如高德、GitHub、Notion)

|

||||

3. 3\. 点开通,填写 API key(如有)

|

||||

4. 4\. 就能在 Agent 或流程中直接调用

|

||||

|

||||

服务由百炼托管在函数计算上,调用即加载、通过 API 按量计费。

|

||||

|

||||

上面测试的高德导航、网页抓取等场景,都是走这一套流程。开发者不需要管部署,不需要写 Glue Code,调用非常稳定,尤其适合原型验证和组合式 Agent 设计。

|

||||

|

||||

> 据知情人士透露

|

||||

>

|

||||

> 百炼 MCP 服务将是阿里 AI 商业化重要落棋。

|

||||

>

|

||||

> 未来,阿里的服务,以及更多的三方应用,都将逐步上线到百炼,来满足任意场景 Agent 的开发需求。

|

||||

|

||||

---

|

||||

|

||||

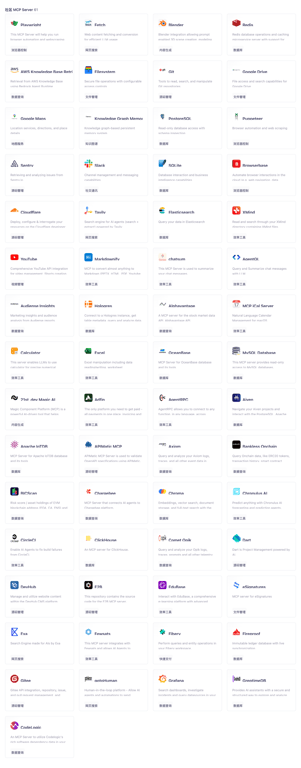

### 第二种:自建服务(注册服务)

|

||||

|

||||

如果你有自己的 API,或者需要引入社区里的 MCP server(比如从 GitHub 上 clone 的开源项目),也可以走“自建部署”的路径:

|

||||

|

||||

1. 1\. 打开“注册服务”界面

|

||||

2. 2\. 贴一下 `npx` 安装 或 Python 脚本(Python 暂还是灰的)

|

||||

3. 3\. 系统会自动创建一个函数计算实例来托管你的服务

|

||||

4. 4\. 注册成功后,该服务就能作为 MCP 工具被调用

|

||||

|

||||

|

||||

|

||||

bailian.console.aliyun.com/?tab=app#/mcp-manage/create

|

||||

|

||||

这条路径稍微偏“开发者向”,但整个过程比传统的服务器部署方式要简单得多:

|

||||

|

||||

- • 不需要自己买机器

|

||||

- • 不需要配置负载均衡或权限系统

|

||||

- • 可以通过文本配置定义 schema,自动生成模型调用示例

|

||||

|

||||

比较适合企业开发者将内部服务 MCP 化,或技术团队接入外部服务做统一封装。一句话总结就是:

|

||||

|

||||

> 以前做一个“插件”要写代码、跑服务、调结构,现在开个服务就是点几下配置。

|

||||

|

||||

---

|

||||

|

||||

## 03 | MCP 和 Plugin 的区别

|

||||

|

||||

我相信,很多人还会有个反应:**这不就是 Plugin?**

|

||||

|

||||

对此,我也特意和百炼的朋友聊了这个问题,得到的回答很明确:

|

||||

|

||||

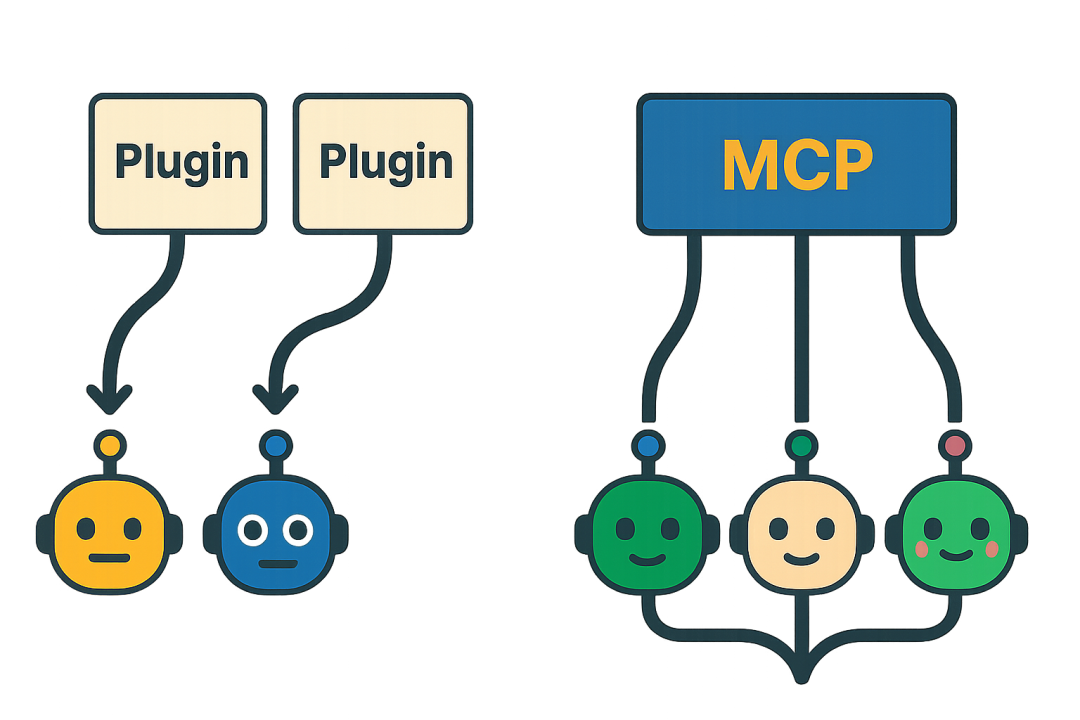

> Plugin 是为某个模型写的私有接口描述;MCP 是跨模型、跨平台可复用的通用协议。

|

||||

|

||||

差别主要体现在三个层面:

|

||||

|

||||

### 协议开放性

|

||||

|

||||

Plugin 是各厂商其自己模型设计的,无法直接复用到其他模型平台。而 MCP 的目标是**让所有模型理解同一种“服务语言”**。无论 Claude、GPT、百炼自有模型,理论上都能读懂相同的 MCP 接口描述,并做出合理调度。

|

||||

|

||||

|

||||

|

||||

MCP 和 Plugin 的区别 be like

|

||||

|

||||

### 服务部署方式

|

||||

|

||||

Plugin 开发者需要自己部署服务,并管理调用、安全、负载等细节。MCP 在百炼的实现中,**服务由平台托管**,开发者只需提供逻辑,其他都交由平台自动完成(如函数计算、鉴权转发等)。

|

||||

|

||||

### 调用范式

|

||||

|

||||

Plugin 更像是“硬编码调用”:定义好 schema,模型识别后调用一次函数。MCP 支持的是**多步调度、多工具组合**,更适合 Agent 执行复杂任务时使用。

|

||||

|

||||

---

|

||||

|

||||

> 在我看来

|

||||

>

|

||||

> MCP 是对 Plugin/Function Calling/Tool Using 再封装了一轮,这样迁移环境的时候,节省了一部分调配的功夫。

|

||||

|

||||

---

|

||||

|

||||

## 写在最后:从工程对接,到能力平台

|

||||

|

||||

**在 MCP 之前,让 AI 调用外部工具,更像是一项繁琐的工程任务**,你需要写描述、调接口、配参数、部署服务等等...**现在,这些正在被重新定义为一种标准化的、平台化的能力**。

|

||||

|

||||

在我看来,这是一种焦点的转移:

|

||||

|

||||

- • **过去,重心在“人”**:工具主要服务于开发者,AI 需要被动适应。

|

||||

- • **现在,重心在“AI”**:服务被设计成易于 AI 理解和使用,主动拥抱模型。

|

||||

|

||||

非常有趣。

|

||||

|

||||

> 来源:赛博禅心

|

||||

@@ -0,0 +1,51 @@

|

||||

## 正式挑战谷歌!OpenAI 上线 ChatGPT 搜索功能

|

||||

|

||||

如果说今年 7 月推出 SearchGPT 搜索功能原型还是在试探池子的深浅,那么今天,OpenAI 就真正开始挺进搜索领域,在 ChatGPT 中全面上线搜索功能,正式挑战搜索引擎一哥[谷歌](https://stock.finance.sina.com.cn/usstock/quotes/GOOG.html)(155.37, \-5.69, \-3.53%),也向谷歌的老对手——OpenAI 自家“金主”[微软](https://stock.finance.sina.com.cn/usstock/quotes/MSFT.html)(381.35, \-9.14, \-2.34%) 发起挑战。

|

||||

|

||||

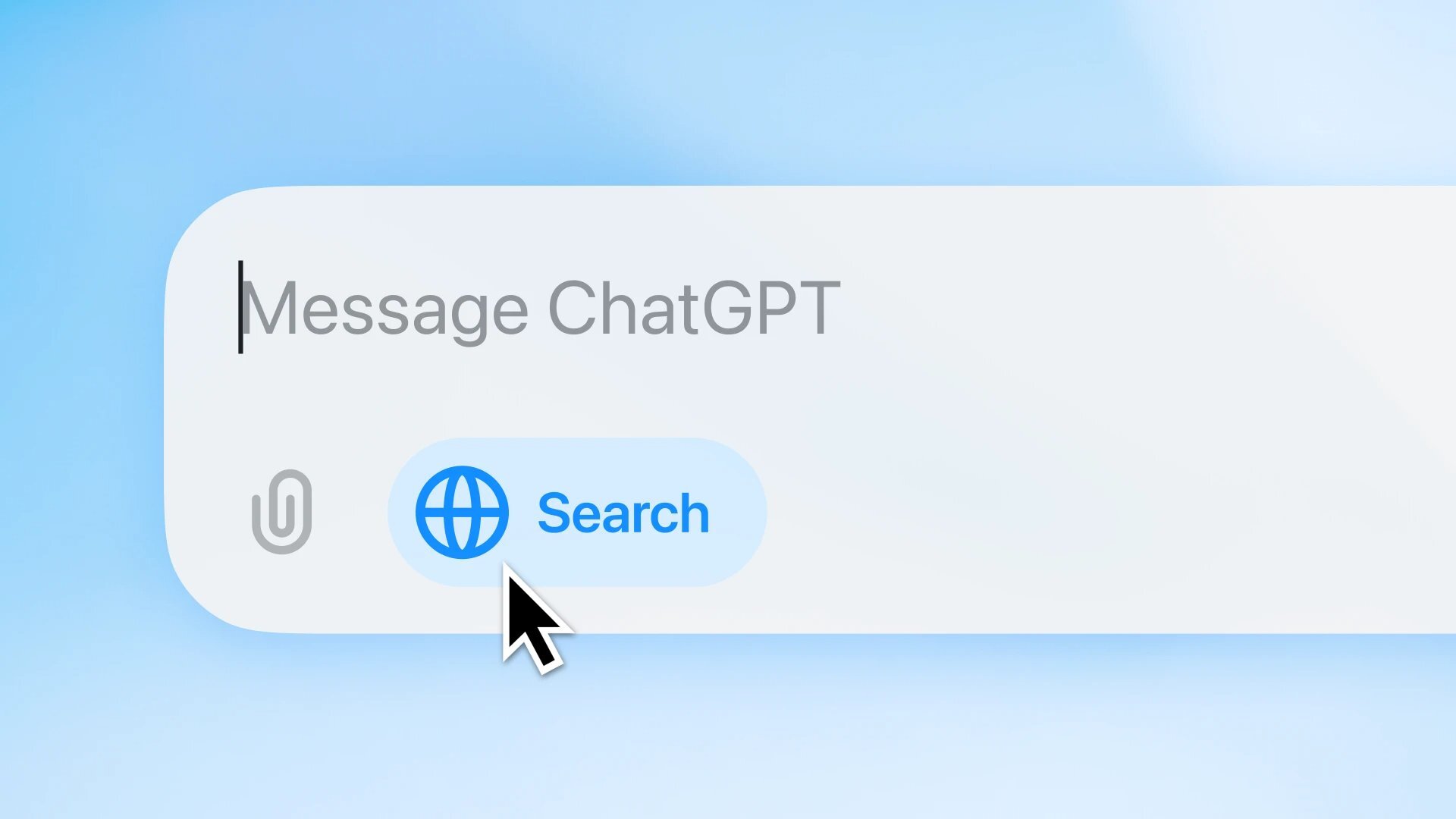

美东时间 10 月 31 日周四,ChatGPT 在官网宣布,ChatGPT 从当天开始新增搜索功能 ChatGPT search,用户无需另外通过搜索引擎寻找答案,在使用 ChatGPT 时就可以快速、及时地获得答案,并附上相关网络资源的链接,ChatGPT 将根据用户的询问选择搜索网络,用户也可以通过单击网络搜索图标 Search,手动选择搜索。

|

||||

|

||||

|

||||

|

||||

未来几个月内面向所有免费用户 模型为 GPT-4o 微调版本

|

||||

|

||||

OpenAI 在 ChatGPT 的网站提供搜索功能,也在 ChatGPT 的台式机和手机 App 中上线,从周四起,适用于两个付费版 ChatGPT Plus 和 Team 的用户,以及 OpenAI 搜索功能原型 SearchGPT 等待名单中的用户。企业版和教育版 ChatGPT Enterprise 和 Edu 的用户将在未来几周内可以使用新功能,OpenAI 将在未来几个月内向所有免费用户推出。

|

||||

|

||||

新功能采用的搜索模型是 OpenAI 旗舰 AI 模型 GPT-4o 的微调版本,使用新型的合成数据生成技术进行后训练,包括从 OpenAI 今年 9 月推出的推理模型 o1-preview 中提取输出。ChatGPT 的搜索功能利用第三方搜索供应商以及合作伙伴直接提供的内容,提供用户正在寻找的信息。

|

||||

|

||||

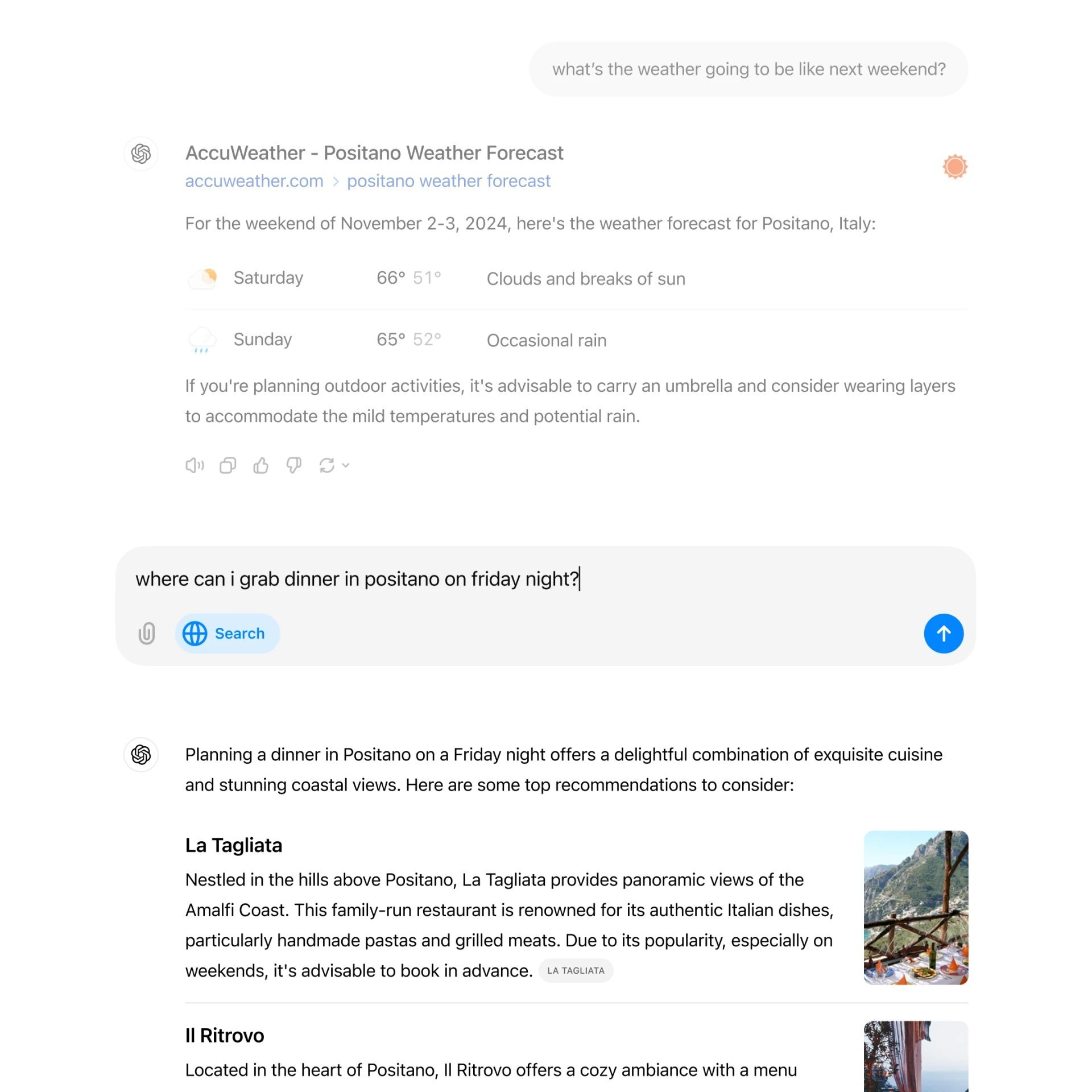

提供天气、体育比赛、股票、地图等信息 聊天时得到搜索信息提供来源侧边栏

|

||||

|

||||

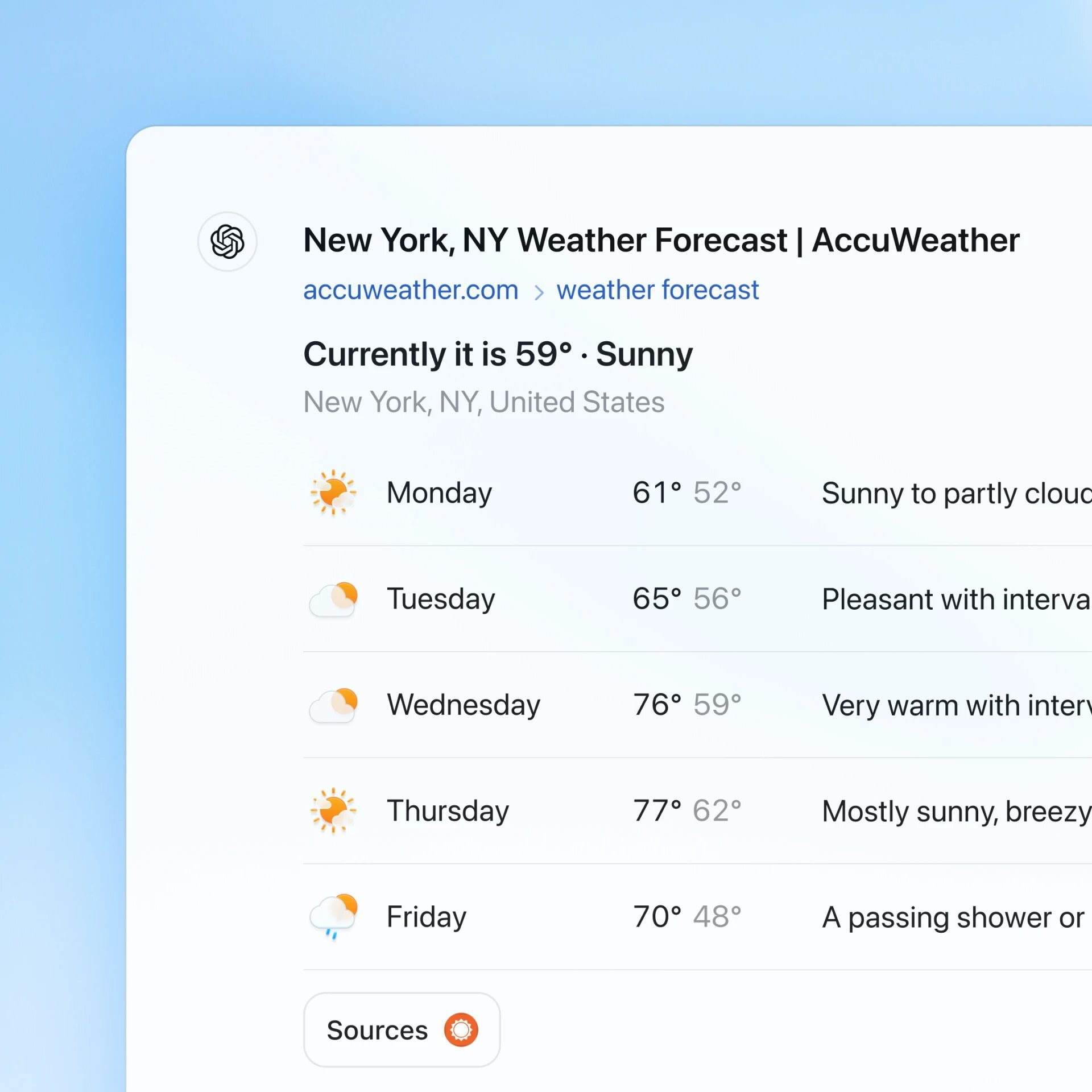

OpenAI 介绍,通常用户可能需要多次搜索才能挖掘到想要的信息,现在可以在和 ChatGPT 聊天时,以更自然的对话方式提出问题,ChatGPT 可以选择使用网络上的信息回复,并且可以深入研究后续的问题,ChatGPT 将考虑聊天的完整上下文,提供更好的答案。

|

||||

|

||||

|

||||

|

||||

OpenAI 展示,ChatGPT 的搜索功能提供了几个大的分类天气、股票、体育、新闻和地图,能提供最新的体育比赛得分、股票价格、新闻、天气等信息,由实时的网络搜索以及与新闻和数据提供商的合作提供支持。

|

||||

|

||||

天气方面,ChatGPT 可以提供气象网站中纽约市从周一到周五的天气信息。

|

||||

|

||||

|

||||

|

||||

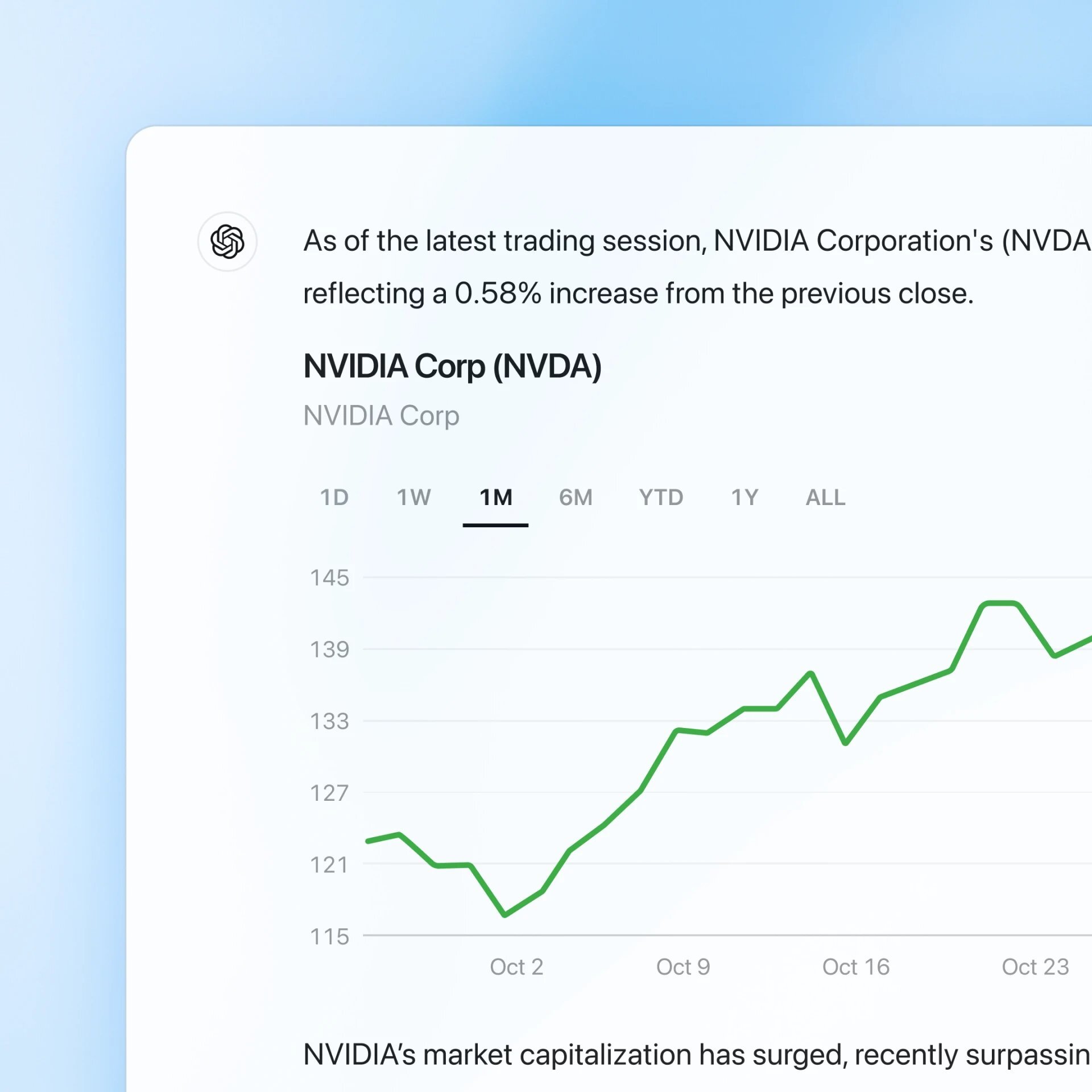

股票方面,提供比如英伟达这只个股日内和长线的股价走势图,总结英伟达当前交易日的交易价较上个交易日收盘涨跌多少。

|

||||

|

||||

|

||||

|

||||

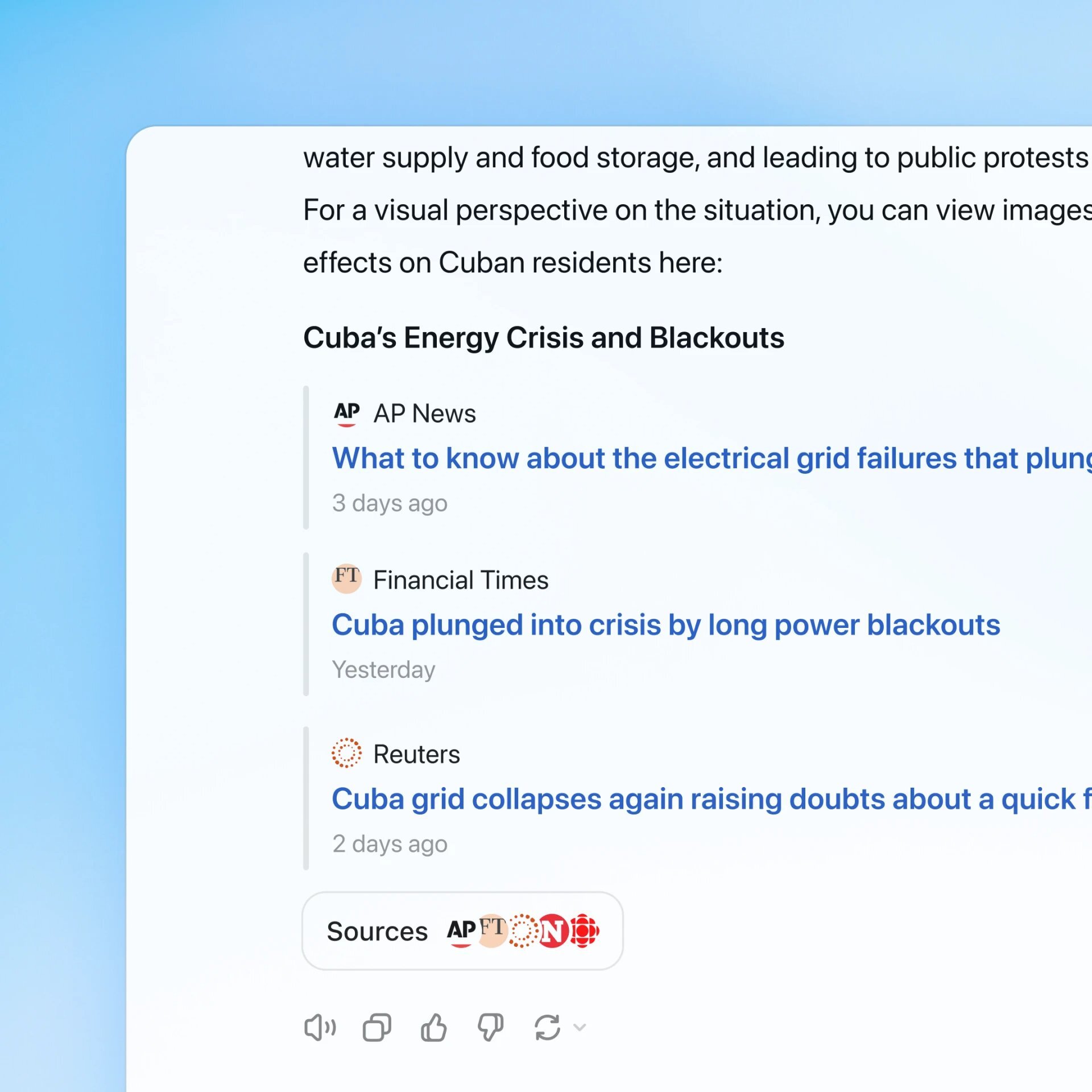

新闻方面,如果搜索古巴能源危机和停电相关的新闻,可以看到美联社、金融时报、路透这类主流新闻媒体的报道标题,并提供来源。

|

||||

|

||||

|

||||

|

||||

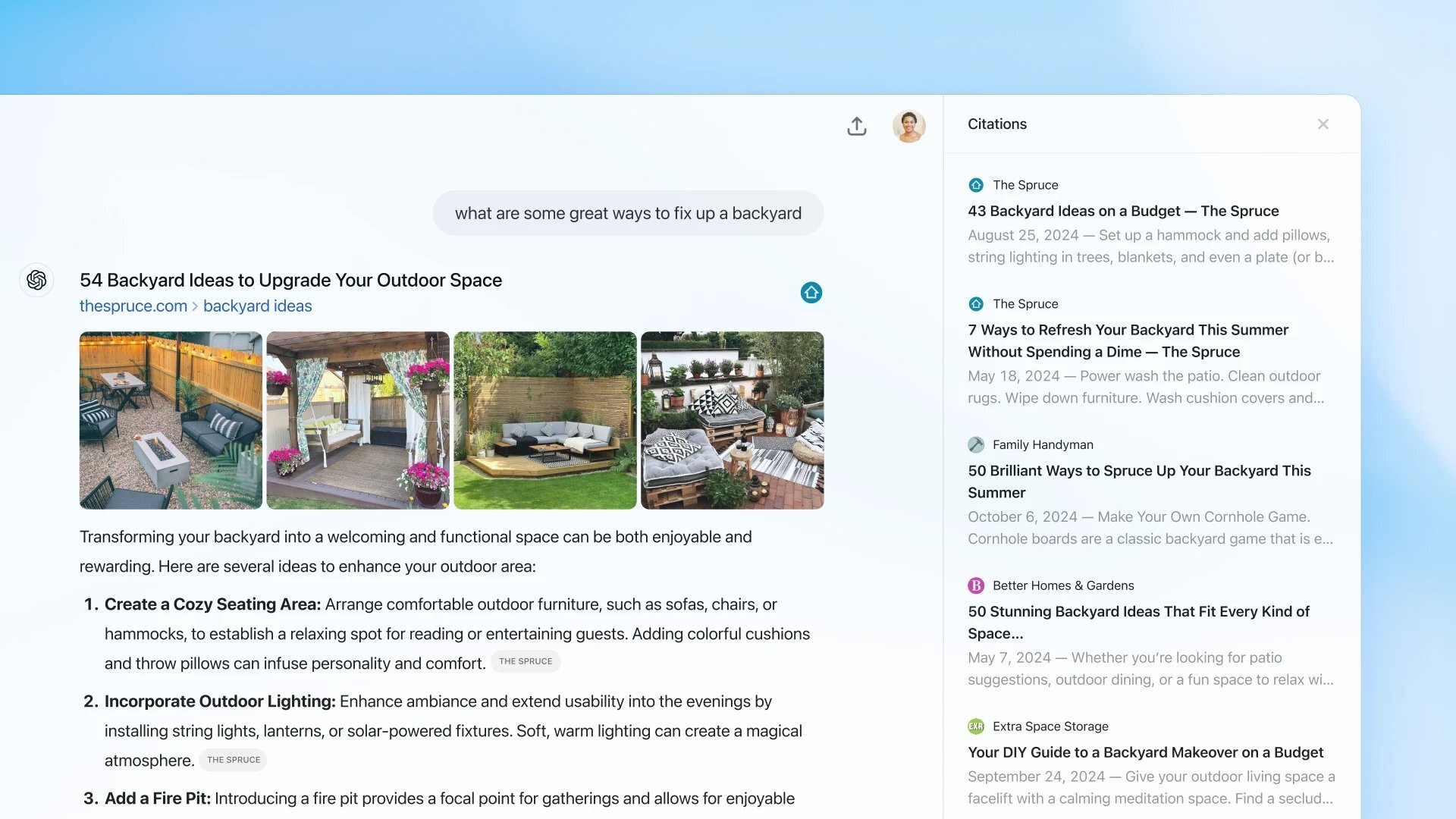

OpenAI 称,拥有新功能的 ChatGPT 可以在聊天中包含新闻报道和博客文章等来源的链接,让用户可以了解更多信息。点击 ChatGPT 回复下方的来源按钮 Source,用户就可打开包含参考资料的侧边栏。

|

||||

|

||||

|

||||

|

||||

在内容合作方面,OpenAI 介绍,与新闻行业进行了广泛合作,并认真听取了全球出版商合作伙伴的反馈,列出了 14 家搜索功能的合作伙伴,包括[](https://stock.finance.sina.com.cn/usstock/quotes/NWS.html)[新闻集团](https://stock.finance.sina.com.cn/usstock/quotes/NWSA.html)(25.59, \-0.59, \-2.25%)(29.58, \-0.62, \-2.05%)、时代周刊、康泰纳仕、美联社、路透社、金融时报、Axel Springer、Dotdash Meredith、大西洋月刊、GEDI、Hearst、Vox Media 以及法国媒体 Le Monde、西班牙媒体 Prisa(El País)。

|

||||

|

||||

OpenAI 称,任何网站或出版商都可以选择出现在 ChatGPT 搜索中。如果想分享反馈,可以给 OpenAI 发电邮联系。

|

||||

|

||||

OpenAI 在社交媒体 X 官宣推出搜索功能的帖子引发热议,有一条高赞评论将谷歌的搜索页面和 Chat GPT 的搜索截图对比,有高赞评论称,这就是谷歌和 AI 模型支持的新兴搜索工具 Perplexity 的结合,有评论称,Perplexity 和谷歌的 CEO 现在要瞪眼了。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

> 来源:硬 AI

|

||||

@@ -0,0 +1,21 @@

|

||||

## 马云现身阿里云发声!谈科技人员责任:让 AI 更懂人类

|

||||

|

||||

新京报贝壳财经讯(记者程子姣)马云再度现身,公开分享了他对科技、人才、责任的看法。4 月 10 日,阿里云新财年启动会在杭州云谷园区举行,马云到场发表演讲。新京报贝壳财经记者了解到,马云现场围绕人工智能话题分享了自己的看法。

|

||||

|

||||

“高科技绝不仅是征服星辰大海,更应该呵护人间烟火。”马云认为,科技人员的责任,不是让 AI(人工智能)取代人类,而是让 AI 更懂人类、更好地服务人类。

|

||||

|

||||

根据多位网友公开分享的图片和视频,马云身穿白色文化衫现身杭州云谷园区,衣服印有“阿里云 15 周年纪念日”字样,同时马云还佩戴了阿里巴巴新版工牌,工牌上印有马云的花名“风清扬”。视频中,马云与现场多位阿里巴巴员工打招呼、互动。

|

||||

|

||||

今年 2 月,在 2025 财年第三财季财报公布的同时,阿里巴巴也向外展示了在 AI 方面的野心。站在新技术周期的起点,AI 显然有望成为阿里巴巴面向未来的新增长引擎。彼时,阿里巴巴集团 CEO(首席执行官)吴泳铭在业绩会上表示,该季度阿里巴巴核心业务增长重新加速。过去一年多来,阿里巴巴坚持以“AI 驱动”为战略重心,持续投入 AI 基础设施建设,该季度收获显著成效。

|

||||

|

||||

吴泳铭谈到,展望未来,由 AI 推动的云智能集团收入增速还会持续提升,阿里巴巴将继续执行聚焦电商和云计算的战略,持续投入以推动长期增长。

|

||||

|

||||

在阿里云新财年启动会上,马云也谈到,阿里云的资源和技术人才,既是发展云计算和 AI 的信心所在,更是责任所在,“科技的意义是要让人类活得更好,活得更有意义,是让所有的普通人从中受益”。阿里 2025 财年第三财季财报显示,阿里云业务收入同比增长 13%,重回双位数增长轨道。其中,AI 相关产品收入连续六个季度实现三位数增长。

|

||||

|

||||

吴泳铭在 2025 财年第三财季业绩会上谈到“未来三年在云和 AI 的基础设施投入预计将超越过去十年的总和。”他还明确了阿里巴巴将继续专注的三大业务类型:国内外电商业务、AI+ 云计算的科技业务和互联网平台产品。未来三年,阿里巴巴将围绕 AI 这个战略核心,在 AI 基础设施、基础模型平台及 AI 原生应用、现有业务的 AI 转型等三方面加大投入。这也揭示了,重回牌桌的阿里巴巴正经历从零售主导向 AI 创新的战略转型。

|

||||

|

||||

值得注意的是,人工智能商业之外,马云还首次公开谈到“善良科技”。马云表示:“科技要给每一个普通人的生活带来变革,让每一个人有尊严,希望我们所有人,阿里同事们,大家一起持续努力,把这个世界带入到一个善良的高科技时代。”

|

||||

|

||||

马云说,“我们不是去追求让机器像人,而是让机器去理解人类,像人类一样去思考,做人类做不到的事情。”他表示,未来不是让 AI 取代人类,而是应该让 AI 解放人类,更懂人类,服务好人类。

|

||||

|

||||

> 来源:贝壳财经

|

||||

@@ -44,6 +44,28 @@

|

||||

|

||||

## Deepseek行业资讯

|

||||

|

||||

[Cursor 迎来了强大的对手,Augment Code 实测](Deepseek行业资讯/2025-04/Cursor%20迎来了强大的对手,Augment%20Code%20实测.md)

|

||||

|

||||

[一张照片生成连贯全片!Runway Gen4 深夜发布,终于捅破 AI 视频多年的天花板](Deepseek行业资讯/2025-04/一张照片生成连贯全片!Runway%20Gen4%20深夜发布,终于捅破%20AI%20视频多年的天花板.md)

|

||||

|

||||

[AI 生态的 USB 接口?阿里、腾讯全面支持 MCP](Deepseek行业资讯/2025-04/AI%20生态的%20USB%20接口?阿里、腾讯全面支持%20MCP.md)

|

||||

|

||||

[5 分钟直出 46 页论文!谷歌 Deep Research 完爆 OpenAI,最强 Gemini 2.5 加持](Deepseek行业资讯/2025-04/5%20分钟直出%2046%20页论文!谷歌%20Deep%20Research%20完爆%20OpenAI,最强%20Gemini%202.5%20加持.md)

|

||||

|

||||

[Shopify 新标准:将 AI 融入日常工作,已是基本要求](Deepseek行业资讯/2025-04/Shopify%20新标准:将%20AI%20融入日常工作,已是基本要求.md)

|

||||

|

||||

[《聪明的机器,复杂的人心》,斯坦福 AI 报告 2025 年版的 12 个信号](Deepseek行业资讯/2025-04/《聪明的机器,复杂的人心》,斯坦福%20AI%20报告%202025%20年版的%2012%20个信号.md)

|

||||

|

||||

[实测:阿里云百炼上线「全周期 MCP 服务」,AI 工具一站式托管](Deepseek行业资讯/2025-04/实测:阿里云百炼上线「全周期%20MCP%20服务」,AI%20工具一站式托管.md)

|

||||

|

||||

[正式挑战谷歌!OpenAI 上线 ChatGPT 搜索功能](Deepseek行业资讯/2025-04/正式挑战谷歌!OpenAI%20上线%20ChatGPT%20搜索功能.md)

|

||||

|

||||

[Meta 深夜开源 Llama 4!首次采用 MoE,惊人千万 token 上下文,竞技场超越 DeepSeek](Deepseek行业资讯/2025-04/Meta%20深夜开源%20Llama%204!首次采用%20MoE,惊人千万%20token%20上下文,竞技场超越%20DeepSeek.md)

|

||||

|

||||

[马云现身阿里云发声!谈科技人员责任:让 AI 更懂人类](Deepseek行业资讯/2025-04/马云现身阿里云发声!谈科技人员责任:让%20AI%20更懂人类.md)

|

||||

|

||||

[Gemini 2.5 Pro 实测:或将成为最实用的推理模型](Deepseek行业资讯/2025-04/Gemini%202.5%20Pro%20实测:或将成为最实用的推理模型.md)

|

||||

|

||||

[阿里秘密研发新模型将发布,影响力指标成最重要考核](Deepseek行业资讯/2025-04/阿里秘密研发新模型将发布,影响力指标成最重要考核.md)

|

||||

|

||||

[有史以来最大力度!苹果进军医疗,计划明年推出AI医生 - 华尔街见闻](Deepseek行业资讯/2025-04/有史以来最大力度!苹果进军医疗,计划明年推出AI医生%20-%20华尔街见闻.md)

|

||||

|

||||

Reference in New Issue

Block a user